3.1、将messages日志添加到elasticsearch集群

4.1、将 Apache 服务器的日志(访问的、错误的)添加到 Elasticsearch 并通过 Kibana 显示

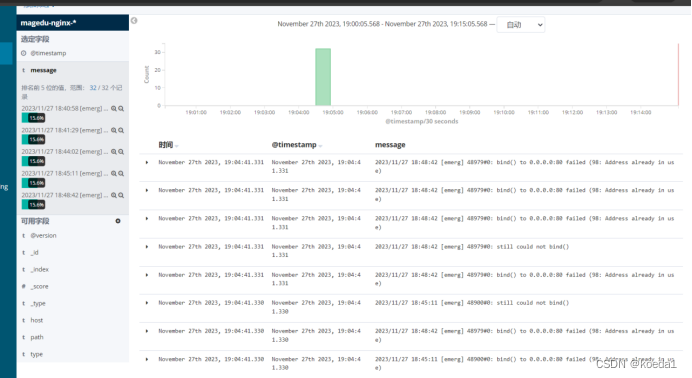

4.2、nginx日志添加到elasticsearch集群,并用kiabana分析

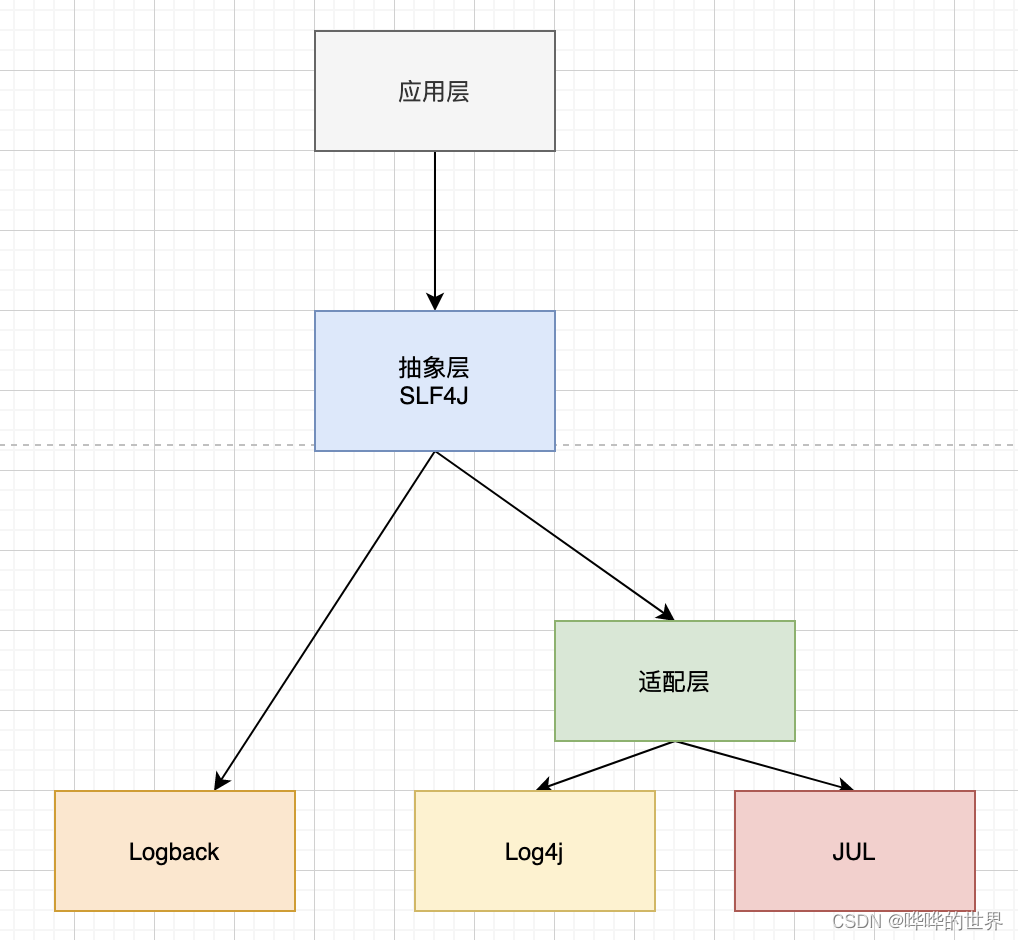

一、ELK概述

1、ELK概念:

ELK是一套完整的日志集中处理方案,由三个开源的软件的简称组成

E:ElasticSearch 简称ES,是一个开源的,分布式的存储检索引擎(索引型的非关系数据库)。作用就是存储日志。由java代码开发,基于Lucene结构开发的一套全文检索引擎。拥有一个web接口。用户可以通过浏览器的形式和ES组件进行通信。

作用:存储,允许全文搜索结构化搜索(索引点),索引和搜索容量可以支持大容量的日志数据。也可以搜索其他不同类型的文档

K:kiabana 图形化界面。可以更好的分析存储在ES上的日志数据。提供了一个图形化的界面,来浏览ES上的日志数据。汇总、分析、搜索

L:Logstash 数据收集引擎,支持动态的(实时的)从各种服务应用收集日志资源,还可以对收集到的日志数据进行过滤、分析,还可以丰富收集到的日志数据,统一格式等等操作。然后把数据同步到ES存储引擎上。RUBY语言编写,运行在java虚拟机上的一个强大的数据处理工具。数据传输,格式化处理,格式化输出。主要作用就是处理日志

2、其他数据收集工具:

fliebeat:轻量级的开源的,日志收集工具。收集的速度较快,但是没有数据分析和过滤的能力,一般是结合logstash一块使用

3、ELK工作流程图:

1、在所有需要搜集日志的服务器上部署logstash,由logstash收集日志,将日志格式化并输出到elasticsearch集群中

2、elasticsearch对格式化后的日志进行索引和存储

3、kiabana从elasticsearch集群中查询数据生成图表,并进行前端数据的展示

4、ELK 的工作原理:

1、在所有需要收集日志的服务器上部署Logstash;或者先将日志进行集中化管理在日志服务器上,在日志服务器上部署 Logstash。

2、Logstash 收集日志,将日志格式化并输出到 Elasticsearch 群集中。

3、Elasticsearch 对格式化后的数据进行索引和存储。

4、Kibana 从 ES 群集中查询数据生成图表,并进行前端数据的展示。

总结:logstash作为日志搜集器,从数据源采集数据,并对数据进行过滤,格式化处理,

然后交由Elasticsearch存储,kibana对日志进行可视化处理。

5、日志系统的特征:

总结:ELK的作用,当我们管理一个打大集群时,需要分析和定位的日志就会很多,每一台服务器分别取分析,将会耗时耗力。所以我们应运而生了一个集中的统一的日志管理系统和分析系统。极大的提高了定位问题的效率

二、实验部署:

两台ES:

ES1:20.0.0.21

ES2:20.0.0.22

logstash和kiabana部署在一台机器上:20.0.0.23(最好给4核8G)

1、ELK Elasticsearch 集群部署

java –version #如果没有安装,yum –y install java

OpenJDK Runtime Environment (build 1.8.0_131-b12)

OpenJDK 64-Bit Server VM (build 25.131-b12, mixed mode)

(1)安装elasticsearch—rpm包

#上传elasticsearch-6.7.2.rpm到/opt目录下

rpm –ivh elasticsearch-6.7.2.rpm

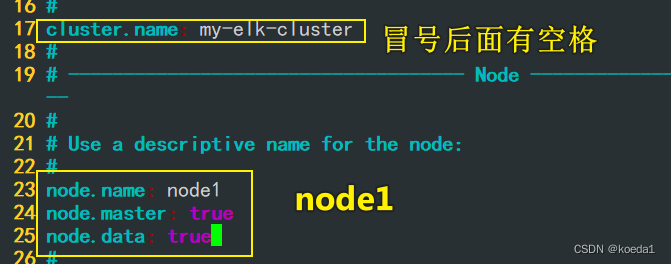

cp /etc/elasticsearch/elasticsearch.yml /etc/elasticsearch/elasticsearch.yml.bak

vim /etc/elasticsearch/elasticsearch.yml

–23–取消注释,指定节点名字:Node1节点为node1,Node2节点为node2

node.master: true #是否master节点,false为否

node.data: true #是否数据节点,false为否

path.data: /var/lib/elasticsearch

path.logs: /var/log/elasticsearch

–43–取消注释,

http.port: 9200 #指定es集群提供外部访问的接口

transport.tcp.port: 9300 #指定es集群内部通信接口

discovery.zen.ping.unicast.hosts: [“192.168.233.12:9300”, “192.168.233.13:9300”]

grep -v “^#” /etc/elasticsearch/elasticsearch.yml

systemctl start elasticsearch.service

systemctl enable elasticsearch.service

tail -f /var/log/elasticsearch/my–elk–cluster.log

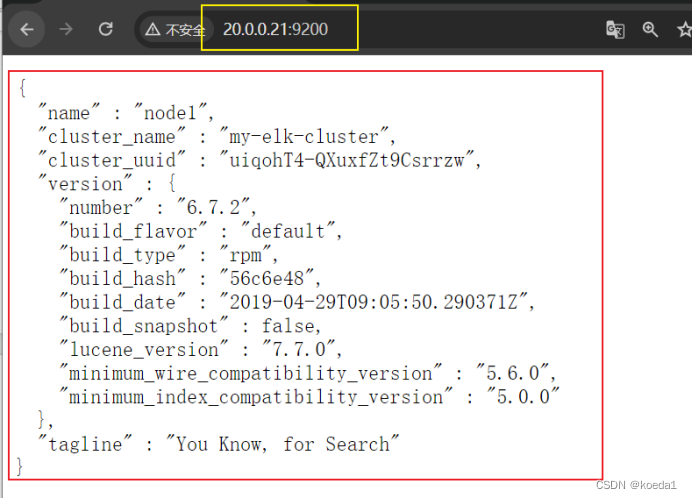

浏览器访问

http://20.0.0.21:9200

http://20.0.0.22:9200

浏览器访问

http://20.0.0.21:9200/_cluster/health?pretty

http://20.0.0.22:9200/_cluster/health?pretty

查看群集的健康情况,可以看到 status 值为 green(绿色), 表示节点健康运行。

浏览器访问 http://20.0.0.21:9200/_cluster/state?pretty 检查群集状态信息。

#使用上述方式查看群集的状态对用户并不友好,可以通过安装 Elasticsearch-head 插件,可以更方便地管理群集。

2、安装 Elasticsearch-head 插件

Elasticsearch 在 5.0 版本后,Elasticsearch-head 插件需要作为独立服务进行安装,

安装 Elasticsearch-head 需要提前安装好依赖软件 node 和 phantomjs。

node:是一个基于 Chrome V8 引擎的 JavaScript 运行环境。

phantomjs:是一个基于 webkit 的JavaScriptAPI,可以理解为一个隐形的浏览器,

#上传软件包 node-v8.2.1.tar.gz 到/opt

yum install gcc gcc-c++ make -y

#上传软件包 phantomjs-2.1.1-linux-x86_64.tar.bz2 到

tar jxvf phantomjs-2.1.1-linux-x86_64.tar.bz2

cd /opt/phantomjs-2.1.1-linux-x86_64/bin

(3)安装 Elasticsearch-head 数据可视化工具

#上传软件包 elasticsearch-head-master.zip 到/opt

unzip elasticsearch-head-master.zip

npm config set registry http://registry.npm.taobao.org/

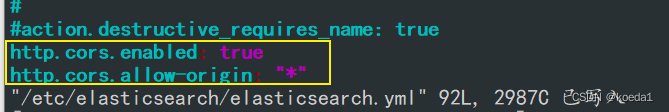

vim /etc/elasticsearch/elasticsearch.yml

……

http.cors.enabled: true #开启跨域访问支持,默认为 false

http.cors.allow–origin: “*” #指定跨域访问允许的域名地址为所有

systemctl restart elasticsearch

#必须在解压后的 elasticsearch-head 目录下启动服务,进程会读取该目录下的 gruntfile.js 文件,否则可能启动失败。

cd /opt/elasticsearch-head-master

#elasticsearch-head 监听的端口是 9100

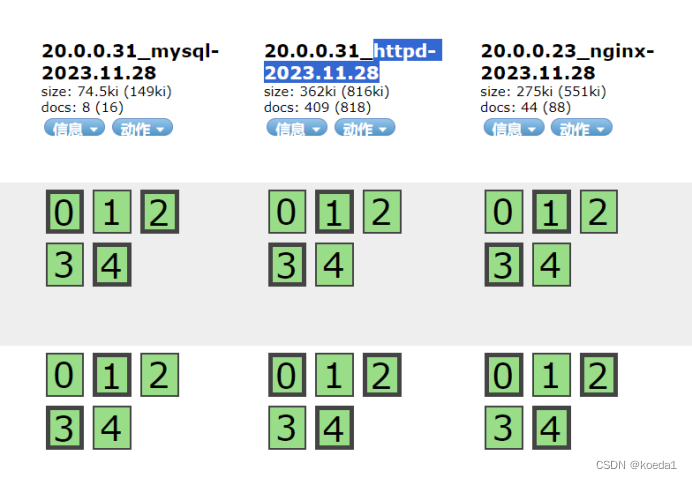

(6)通过 Elasticsearch-head 查看 Elasticsearch 信息

通过浏览器访问 http://20.0.0.21:9100/ 地址并连接群集。如果看到群集健康值为 green 绿色,代表群集很健康。

9200是ES数据库的访问端口

#通过命令插入一个测试索引,索引为 index–demo,类型为 test。

curl -X PUT ‘localhost:9200/index-demo/test/1?pretty&pretty’ -H ‘content-Type: application/json‘ -d ‘{“user“:”zhangsan”,”mesg“:”hello world”}’

删除:

curl -X DELETE ‘localhost:9200/index-demo/test/1?pretty&pretty’ -H ‘content-Type: application/json‘ -d ‘{“user“:”zhangsan”,”mesg“:”hello world”}’

浏览器访问 http://192.168.233.12:9100/ 查看索引信息,可以看见索引默认被分片5个,并且有一个副本。

点击“数据浏览”,会发现在node1上创建的索引为 index-demo,类型为 test 的相关信息。

Elasticsearch 的可视化工具中,以索引分区(Shard)为单位,

可能采用不同的标识颜色来表示它们的状态。黑色的边框通常表示主分片(Primary Shard)。

在 Elasticsearch 中,索引被分成多个分区,这些分区称为分片。

每个索引可能包含一个或多个主分片以及它们的副本。主分片是数据的主要存储,

3、ELK Logstash 部署

(在非ES节点上操作)

Logstash 一般部署在需要监控其日志的服务器。在本案例中,Logstash 部署在 Apache 服务器上,

用于收集 Apache 服务器的日志信息并发送到 Elasticsearch。

hostnamectl set-hostname apache

3.安装Java环境

yum -y install java

4.安装logstash

#上传软件包 logstash-6.7.2.rpm 到/opt目录下

systemctl start logstash.service

systemctl enable logstash.service

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

#可以指定logstash的工作目录,默认为:/etc/logstash/conf.d

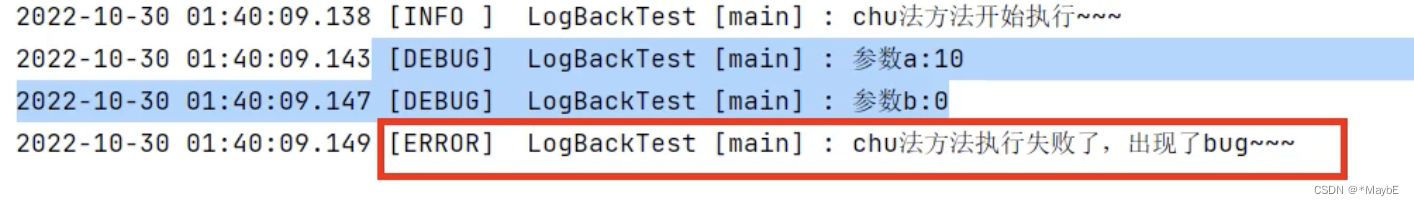

测试 Logstash

-f:通过这个选项可以指定 Logstash 的配置文件,根据配置文件配置 Logstash 的输入和输出流。

该字符串可以被当作 Logstash 的配置(如果是空,则默认使用 stdin 作为输入,stdout 作为输出)。

logstash -e ‘input { stdin{} } output { stdout{} }’

所有的键盘命令行输出,转化为标准输出(rubydebug的模式,6.0之后logstash的默认输出模式就是rubydebug格式的标准输出)

#使用 rubydebug 输出详细格式显示,codec 为一种编解码器

logstash -e ‘input { stdin{} } output { stdout{ codec=>rubydebug } }’

#使用 Logstash 将信息写入 Elasticsearch 中

logstash -e ‘input { stdin{} } output { elasticsearch { hosts=>[“20.0.0.21:9200″,”20.0.0.22:9200”] } }’ —path.data /opt/test1

6.0之后logstash自带的输出格式rubydebug,自动的把输出格式定义为统一格式的标准输出

Logstash 配置文件基本由三部分组成:input、output 以及 filter(可选,根据需要选择使用)。

表示数据处理层,包括对数据进行格式化处理、数据类型转换、数据过滤等,支持正则表达式

grok 对若干个大文本字段进行再分割成一些小字段 (?<字段名>正则表达式) 字段名: 正则表达式匹配到的内容

表示将Logstash收集的数据经由过滤器处理之后输出到Elasticsearch。

elasticsearch stdout

#格式如下:

input {…}

filter {…}

output {…}

input {

file { path =>”/var/log/messages” type =>”syslog“}

file { path =>”/var/log/httpd/access.log” type =>”apache“}

}

可以指定logstash的工作目录,默认为:/etc/logstash/conf.d

运行配置

logstash -f /opt/log/system.conf —path.data /opt/test1 &

logstash -f:指定配置文件

—path.data /opt/test1 &:指定数据工作目录/opt/test1

3.1、将messages日志添加到elasticsearch集群

修改 Logstash 配置文件,让其收集系统日志/var/log/messages,并将其输出到 elasticsearch 中。

chmod +r /var/log/messages #让 Logstash 可以读取日志

cd /etc/logstash/conf.d/

logstash -f system.conf —path.data /opt/test1 &

浏览器访问 http://20.0.0.21:9100/ 查看索引信息

4、ELK Kiabana 部署

(logstash节点上部署)

1.安装 Kiabana

#上传软件包 kibana-6.7.2-x86_64.rpm 到/opt目录

cd /opt

rpm -ivh kibana-6.7.2-x86_64.rpm

2.设置 Kibana 的主配置文件

–2–取消注释,Kiabana 服务的默认监听端口为5601

server.port: 5601

–7–取消注释,设置 Kiabana 的监听地址,0.0.0.0代表所有地址

–28–取消注释,配置es服务器的ip,如果是集群则配置该集群中master节点的ip

elasticsearch.url: [“http://192.168.80.12:9200″,”http://192.168.80.13:9200”]

–37–取消注释,设置在 elasticsearch 中添加.kibana索引

kibana.index: “.kibana”

–96–取消注释,配置kibana的日志文件路径(需手动创建),不然默认是messages里记录日志

logging.dest: /var/log/kibana.log

i18n.locale: “zh-CN”

3.创建日志文件,启动 Kibana 服务

touch /var/log/kibana.log

chown kibana:kibana /var/log/kibana.log

systemctl start kibana.service

systemctl enable kibana.service

4.验证 Kibana

浏览器访问 http://20.0.0.23:5601

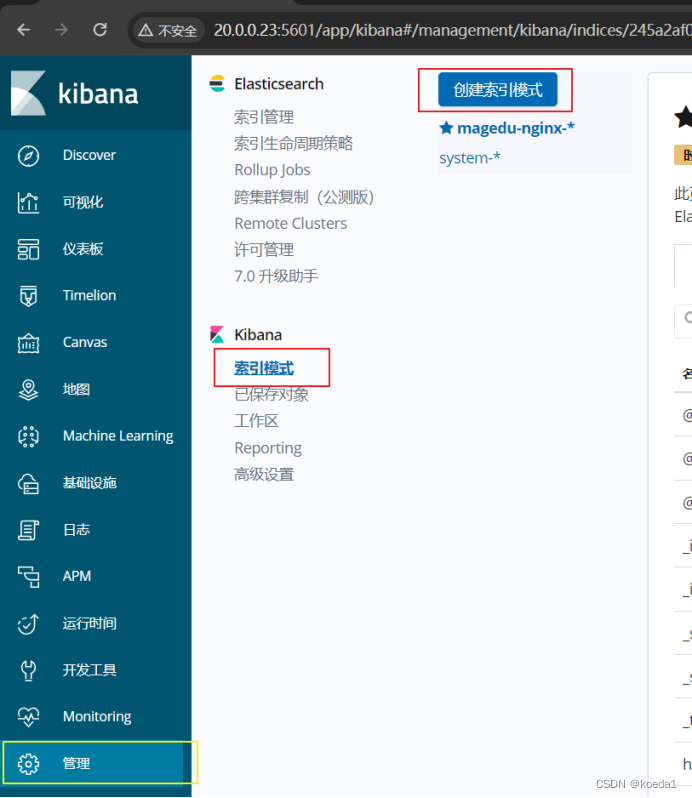

Management -> Index Pattern -> Create index pattern

Index pattern 输入:system-* #在索引名中输入之前配置的 Output 前缀“system”

Next step -> Time Filter field name 选择 @timestamp -> Create index pattern

数据展示可以分类显示,在“Available Fields”中的“host”,然后单击 “add”按钮,可以看到按照“host”筛选后的结果

4.1、将 Apache 服务器的日志(访问的、错误的)添加到 Elasticsearch 并通过 Kibana 显示

vim /etc/logstash/conf.d/apache_log.conf

input {

file{

path => “/etc/httpd/logs/access_log”

}

file{

path => “/etc/httpd/logs/error_log”

}

}

output {

elasticsearch {

hosts => [“20.0.0.21:9200″,”20.0.0.22:9200”]

index => “apache_access-%{+YYYY.MM.dd}”

}

}

if [type] == “error” {

elasticsearch {

hosts => [“20.0.0.21:9200″,”20.0.0.22:9200”]

index => “apache_error-%{+YYYY.MM.dd}”

}

}

}

cd /etc/logstash/conf.d/

/usr/share/logstash/bin/logstash -f apache_log.conf

浏览器访问 http://20.0.0.23:9100 查看索引是否创建

浏览器访问 http://20.0.0.23:5601 登录 Kibana

单击“Index Pattern -> Create Index Pattern”按钮添加索引, 在索引名中输入之前配置的 Output 前缀 apache_access-*,并单击“Create”按钮。在用相同的方法添加 apache_error-*索引。

选择“Discover”选项卡,在中间下拉列表中选择刚添加的 apache_access-* 、apache_error-* 索引, 可以查看相应的图表及日志信息。

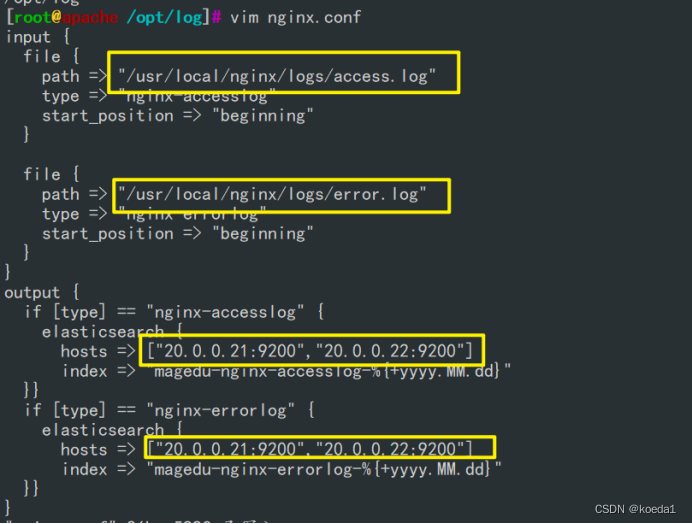

4.2、nginx日志添加到elasticsearch集群,并用kiabana分析

1.修改nginx的配置文件,以json格式存放到/var/log/nginx/access.log文件中

log_format access_json ‘{“@timestamp“:”$time_iso8601″,’

‘”responsetime“:$request_time,’

‘”upstreamtime“:”$upstream_response_time”,’

‘”upstreamhost”:”$upstream_addr“,’

‘”http_host”:”$host”,’

‘”domain“:”$host”,’

‘”xff”:”$http_x_forwarded_for”,’

‘”tcp_xff”:”$proxy_protocol_addr“,’

‘”http_user_agent“:”$http_user_agent“,’

access_log /usr/local/nginx/logs/access.log access_json;

重启logstash服务

登录elasticsearch,查看nginx-accesslog nginx–errorlog索引,能正常查看到

登录kibana,创建nginx-accesslog和nginx–errorlog数据视图,正常查看日志

三、性能调优参数

1、ES性能调优

……

DefaultLimitNPROC=32000

DefaultLimitNOFILE=65536:

这是指定一个用户会话(session)的默认最大文件描述符数量的限制。

文件描述符是一个用于标识打开文件或其他 I/O 资源的整数。在这里,设置为 65536,

DefaultLimitNPROC=32000:

这是指定一个用户会话的默认最大进程数量的限制。进程是正在运行的程序的实例。

这里设置为 32000,表示一个用户会话可以拥有的最大进程数为 32000。

这是指定一个用户会话的默认锁定内存的限制。锁定内存是指将内存保留在物理内存中,

防止被交换到磁盘。”infinity” 表示没有内存锁定的限制,用户会话可以锁定任意数量的内存。

由于ES构建基于lucene, 而lucene设计强大之处在于lucene能够很好的利用操作系统内存来缓存索引数据,

以提供快速的查询性能。lucene的索引文件segements是存储在单文件中的,并且不可变,对于OS来说,

能够很友好地将索引文件保持在cache中,以便快速访问;因此,我们很有必要将一半的物理内存留给lucene ;

另一半的物理内存留给ES(JVM heap )。所以, 在ES内存设置方面,可以遵循以下原则:

1.当机器内存小于64G时,遵循通用的原则,50%给ES,50%留给操作系统,供lucene使用

2.当机器内存大于64G时,遵循原则:建议分配给ES分配 4~32G 的内存即可,其它内存留给操作系统,供lucene使用

#一个进程可以拥有的最大内存映射区域数,参考数据(分配 2g/262144,4g/4194304,8g/8388608)

vm.max_map_count 参数用于限制一个进程可以拥有的最大内存映射区域数。

允许进程直接读取或写入文件,而无需进行常规的文件 I/O 操作。

Elasticsearch 和 Lucene 等搜索引擎: 这些引擎使用内存映射来加速索引和搜索操作。

数据库系统: 一些数据库系统使用内存映射来管理数据文件,以加速读写操作。

科学计算和大数据处理: 在某些科学计算和大数据处理应用中,内存映射可以用于高效地处理大型数据集。

sysctl -p

sysctl -a | grep vm.max_map_count

总结:

ELK:

es:存储数据,索引型的数据库

logstash:收集日志,然后按照标准化格式发送给ES(rubydebug的格式)

2、logstash性能调优

logstash启动是在jvm虚拟机上启动的,启动一次至少占500M内存

logstash的工作线程,默认值就是cpu数,4核给2, 8核 给4 给一半即可

一次性能够批量处理检索事件的大小默认125。性能好可以给 200

查询更新的延迟。50毫秒,可以自行调整。生产中15 、10。看机器性能

四、filebeat+ELK

filebeat日志收集工具和logstash相同

1、概述

1.1、优点:

filebeat是一个轻量级的日志收集工具,所使用的系统资源比logstash部署和启动时使用的资源要小的多

filebeat可以运行在非java环境。他可以代替logstash在非Java环境上收集日志

1.2、缺点:

filebeat无法实现数据的过滤,一般是结合logstash的数据过滤功能一块使用

1.3、工作流程图:

2、实验

架构:

ES节点两个:

node1:20.0.0.21

node2:20.0.0.22

日志节点(logstash、kibana、filebeat):20.0.0.23

1.安装 Filebeat

#上传软件包 filebeat-6.7.2-linux-x86_64.tar.gz 到/opt目录

tar zxvf filebeat-6.7.2-linux-x86_64.tar.gz

mv filebeat-6.7.2-linux-x86_64/ /usr/local/filebeat

yum install ntpdate -y

2.设置 filebeat 的主配置文件

cd /usr/local/filebeat

filebeat.inputs:

– type: log

– /usr/local/nginx/logs/access.log

– /usr/local/nginx/logs/error.log

log_type: nginx

from: 20.0.0.23

因为filebeat只能收集日志,不能过滤日志,所以需要先发给logstash过滤处理日志,再由logstash发送给elasticsearch。这里不直接发送给elasticsearch

Logstash output

配置logsatsh

input {

beats { port => “5044” }

}

elasticsearch {

hosts => [“20.0.0.21:9200″,”20.0.0.22:9200”]

index =>”%{[fields][service_name]}-%{+YYYY.MM.dd}”

}

}

stdout {

}

}

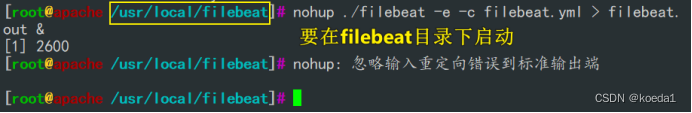

启动 filebeat:

nohup ./filebeat -e -c filebeat.yml > filebeat.out &

-c:指定配置文件

nohup:在系统后台不挂断地运行命令,退出终端不会影响程序的运行

给所要操作的日志访问权限

chmod 777 access.log error.log

启动logstash配置:

logstash -f nginx_23.conf –path.data /opt/test1 &

filebeat 远程收集日志

filebeat和logstash不部署在同一节点上

filebeat先在节点上收集日志,在远程发送给logstash。

在节点上安装filebeat

配置filebeat文件:

Elasticsearch output(全部注释掉)

Logstash output

output.logstash:

# The Logstash hosts

hosts: [“20.0.0.23:5045”] #指定 logstash 的 IP 和端口

配置logstash(去logstash节点)

启动 filebeat(filebeat节点)

cd /usr/local/filebeat

nohup ./filebeat -e -c filebeat.yml > filebeat.out &

去logstash节点启动

logstash -f nhm.conf –path.data /opt/test2 &

logstash可以使用任意端口,只要没被占用都可以使用,推荐1024之后开始

原文地址:https://blog.csdn.net/koeda1/article/details/134656159

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_20344.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!