本文介绍: cross entropy 越小越好,优化起来速度更快,在pytorch中,把softmax和log打包到一起了。logistic是因为加了一个sigmoid函数,将输出预测值映射到【0,1】kl散度,两个分布重合的话,kl散度等于0,因为他们很整齐。有时候使用cross entropy==》 分类问题。softmax解决多分类问题,让大的概率值更大。有时候使用MSE损失函数,拟合。

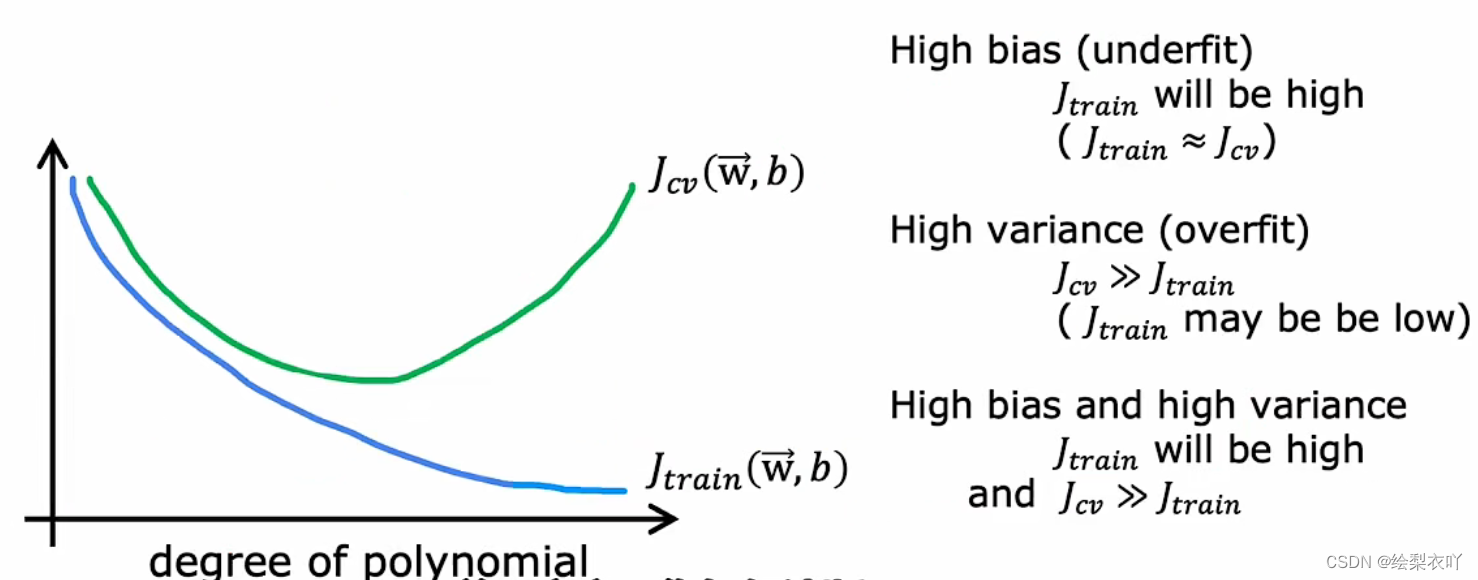

为什么不直接统计标签数和预测结果数,计算精度?

因为

为什么叫logistic回归

logistic是因为加了一个sigmoid函数,将输出预测值映射到【0,1】

有时候使用MSE损失函数,拟合

有时候使用cross entropy==》 分类问题

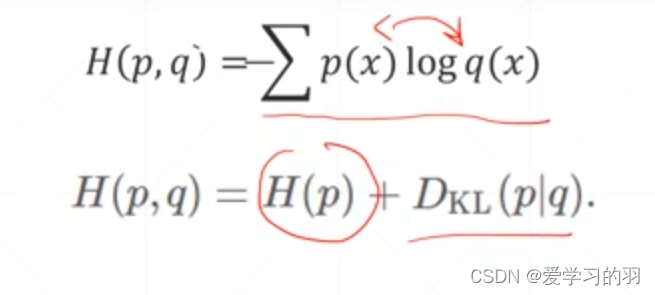

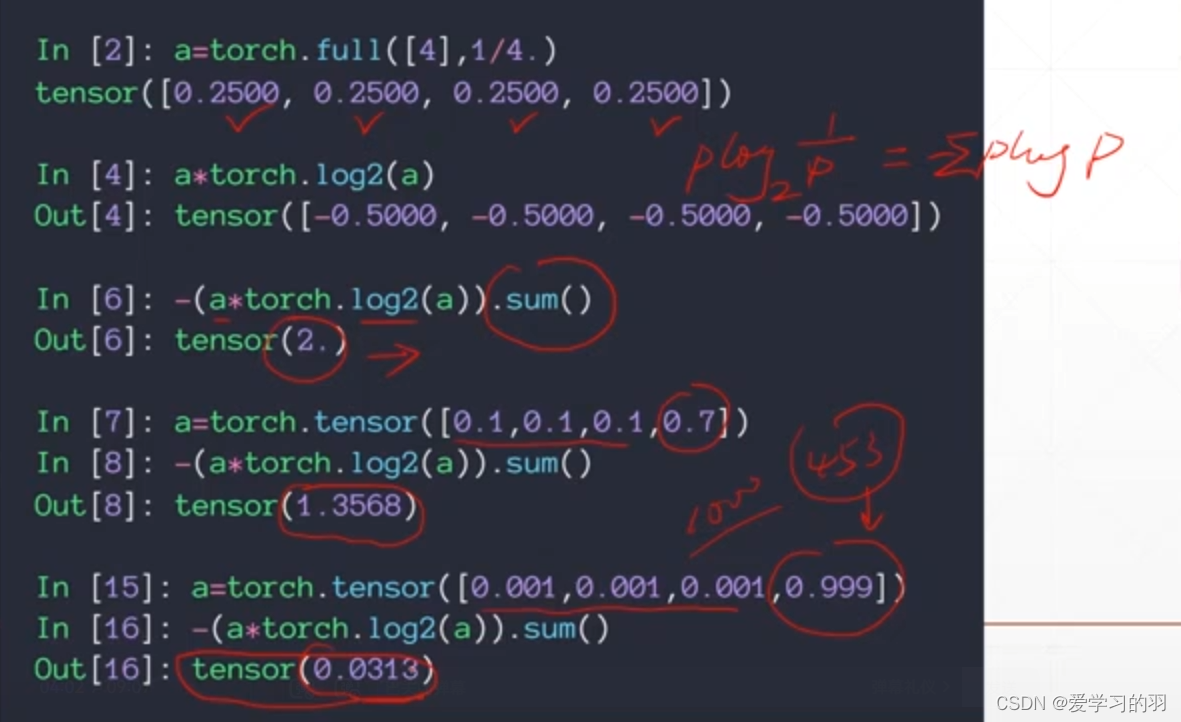

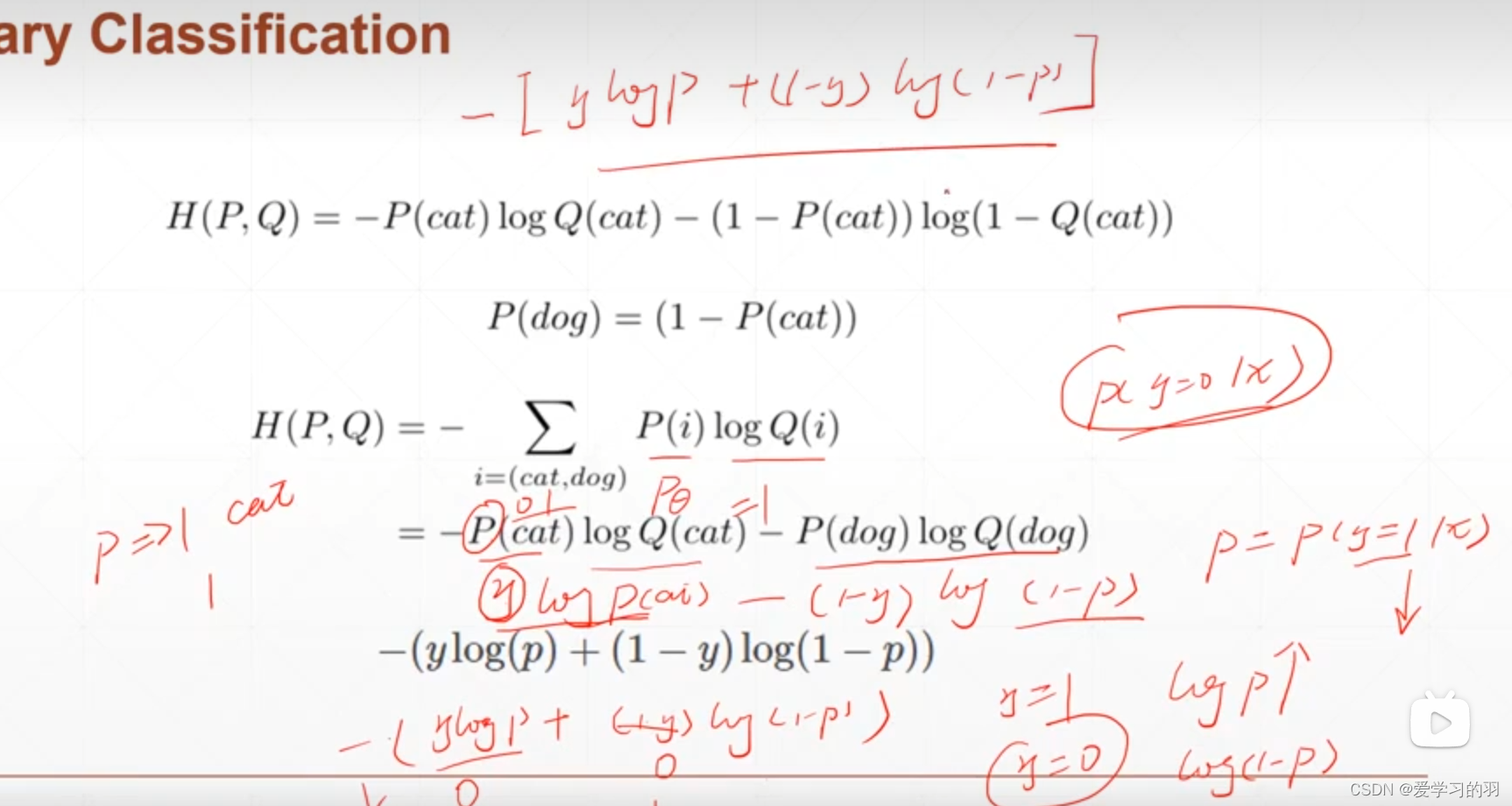

交叉熵损失详解 cross entropy

熵:不确定性,惊喜的衡量度,稳定度

二分类的公式推导

cross entropy 越小越好,优化起来速度更快,在pytorch中,把softmax和log打包到一起了

pytorch中的inplace会改变输入x的值

feature缩放

有两种方式

# 对3通道进行归一化处理 imagenet数据集上的

transforms.Normalize(mean=[0.485,0.456,0.406],

std=[0.229,0.224,0.225])

# 批归一化 最后生成通道数 28*28

x = torch.rand(100,16,784)

layer = nn.BatchNorm1d(16)

out = layer(x)

#[16] 均值

print(layer.running_mean,layer.running_mean.size())

# 方差

print(layer.running_var)

- 批归一化

原文地址:https://blog.csdn.net/qq_37437892/article/details/134626201

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_31610.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。