参考:LLMs之RAG:LangChain-Chatchat(一款中文友好的全流程本地知识库问答应用)的简介(支持 FastChat 接入的ChatGLM-2/LLaMA-2等多款主流LLMs+多款embe_一个处女座的程序猿的博客-CSDN博客

python –c “import torch; print(torch.version.cuda)” 返回是 12.1 ,驱动也无法升级,所以重新申请了阿里云的机器 重新安装

git clone https://www.modelscope.cn/Jerry0/m3e–base.git

暂时没用:git clone https://www.modelscope.cn/qwen/Qwen-7B-Chat-Int4.git

git clone https://www.modelscope.cn/qwen/Qwen-7B-Chat.git

git clone https://www.modelscope.cn/ZhipuAI/chatglm2-6b.git

git clone https://github.com/imClumsyPanda/langchain-ChatGLM.git

conda create -n pytorch python=3.8

python –c “import torch; print(torch.version.cuda)”

python -c “import torch; print(torch.cuda.is_available())”

$ pip install –r requirements.txt

pip install –r requirements_api.txt

pip install -r requirements_webui.txt

# 默认依赖包括基本运行环境(FAISS向量库)。如果要使用 milvus/pg_vector 等向量库,请将 requirements.txt 中相应依赖取消注释再安装。

ls -l /usr/local | grep cuda conda install pytorch torchvision torchaudio pytorch-cuda=11.8 -c pytorch -c nvidia

git clone –b v1.0.8 https://github.com/Dao-AILab/flash–attention

cd flash–attention && pip install .

root@dsw-160253-6c99d7f67c-z4jjw:/mnt/workspace/langchain-ChatGLM/configs# cp basic_config.py.example basic_config.py

root@dsw-160253-6c99d7f67c-z4jjw:/mnt/workspace/langchain-ChatGLM/configs# cp kb_config.py.example kb_config.py

root@dsw-160253-6c99d7f67c-z4jjw:/mnt/workspace/langchain-ChatGLM/configs# cp model_config.py.example model_config.py

root@dsw-160253-6c99d7f67c-z4jjw:/mnt/workspace/langchain-ChatGLM/configs# cp prompt_config.py.example prompt_config.py

root@dsw-160253-6c99d7f67c-z4jjw:/mnt/workspace/langchain-ChatGLM/configs# cp server_config.py.example server_config.py

6、

知识库初始化

当前项目的知识库信息存储在数据库中,在正式运行项目之前请先初始化数据库

cd ..

python init_database.py —recreate–vs

pip install typing_extensions==4.8.0

pip install —force–reinstall charset-normalizer==3.1.0

启动:

修改下 模型目录下的 config.json 文件 添加 “disable_exllama“:true,

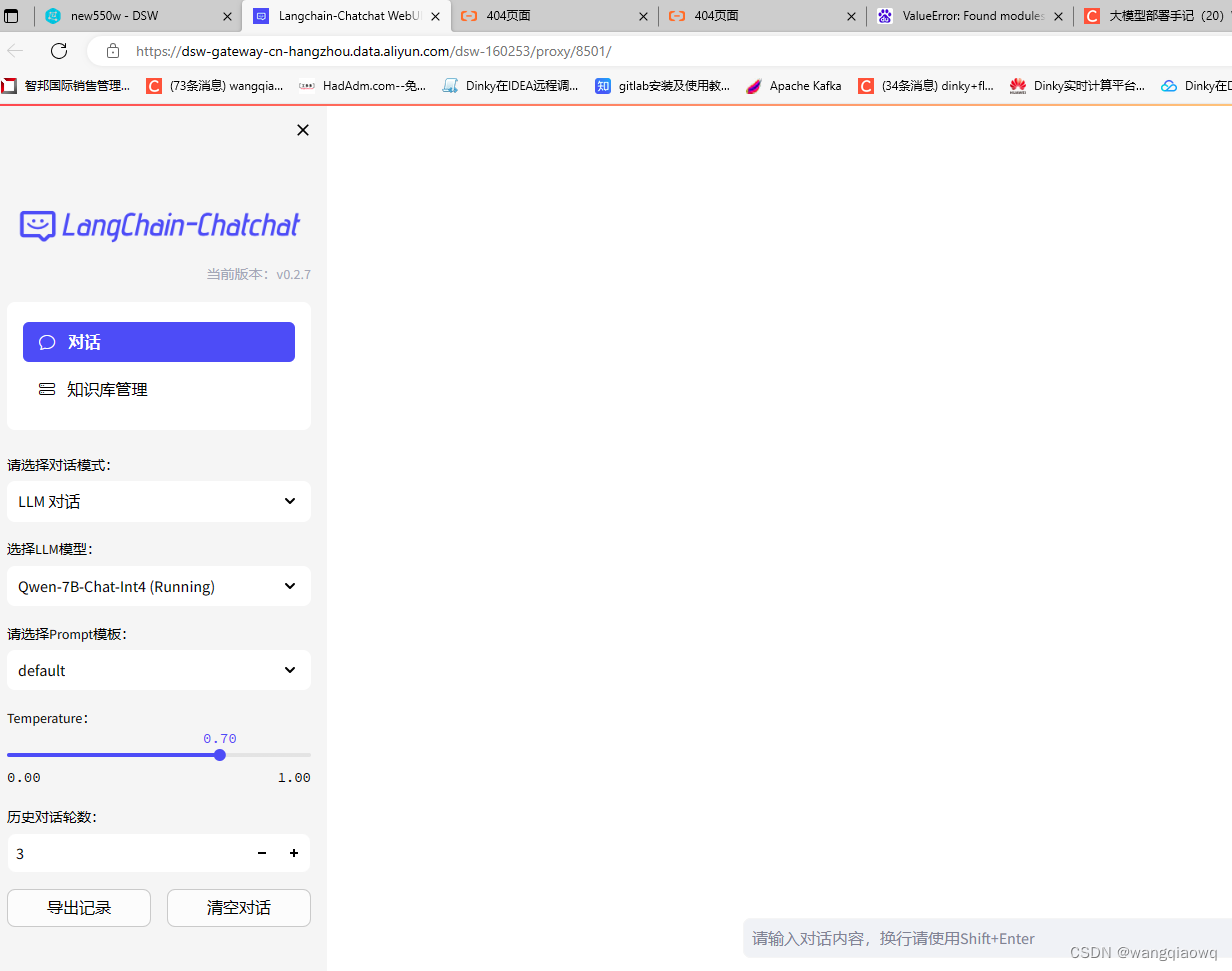

部署成功 : 备注 使用 chatglm2-6b 部署成功也可以正常对话 通义千问 暂时还没成功

原文地址:https://blog.csdn.net/wangqiaowq/article/details/134694027

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_46858.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!