系列文章目录

- pytorch学习1-数据加载以及Tensorboard可视化工具

- pytorch学习2-Transforms主要方法使用

- pytorch学习3-torchvisin和Dataloader的使用

- pytorch学习4-简易卷积实现

- pytorch学习5-最大池化层的使用

- pytorch学习6-非线性变换(ReLU和sigmoid)

- pytorch学习7-序列模型搭建

- pytorch学习8-损失函数与反向传播

- pytorch学习9-优化器学习

- pytorch学习10-网络模型的保存和加载

- pytorch学习11-完整的模型训练过程

一、优化器使用

import torch.optim

import torchvision

from torch import nn

from torch.nn import Conv2d, MaxPool2d, Sequential, Flatten, Linear

from torch.utils.data import DataLoader

dataset=torchvision.datasets.CIFAR10("data",train=False,transform=torchvision.transforms.ToTensor(),download=True)

dataloader=DataLoader(dataset,batch_size=1)

class Mynn(nn.Module):

#这是使用序列的方法:

def __init__(self):

super(Mynn,self).__init__()

self.model1=Sequential(

Conv2d(3, 32, 5, padding=2),

MaxPool2d(2),

Conv2d(32, 32, 5, padding=2),

MaxPool2d(2),

Conv2d(32, 64, 5, padding=2),

MaxPool2d(2),

Flatten(),

Linear(1024, 64),

Linear(64, 10)

)

def forward(self,x):

x=self.model1(x)

return x

mynn=Mynn()

loss=nn.CrossEntropyLoss()

optim=torch.optim.SGD(mynn.parameters(),lr=0.01)#调用SGD优化器。第一个参数是把模型的参数全输入进去

for epoch in range(20):

runing_loss=0.0

for data in dataloader:

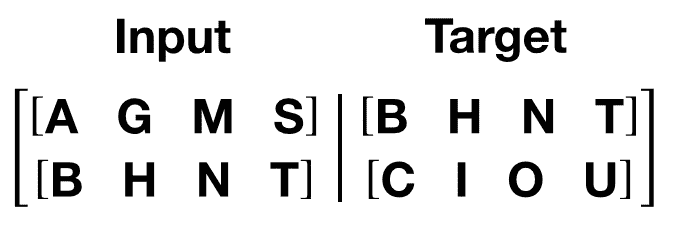

imgs,target=data

outputs=mynn(imgs)

result_loss=loss(outputs,target)

optim.zero_grad()#将上一次的梯度设置为0,这一步必须做

result_loss.backward()#反向传播,计算出模型的参数

optim.step()#进行完反向传播之后,模型的参数就计算出来了,就可以调用优化器了

runing_loss=runing_loss+result_loss

print(runing_loss)#查看每一轮的损失之和

总结

原文地址:https://blog.csdn.net/magic171/article/details/134802636

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_49248.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。