论文:https://arxiv.org/pdf/1511.06434.pdf

发表:ICLR 2016

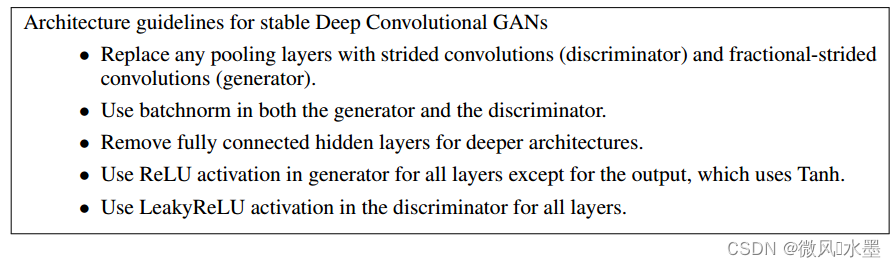

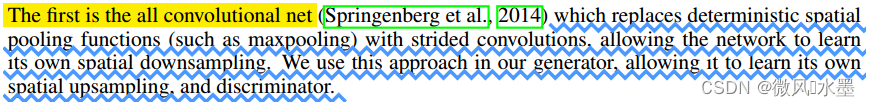

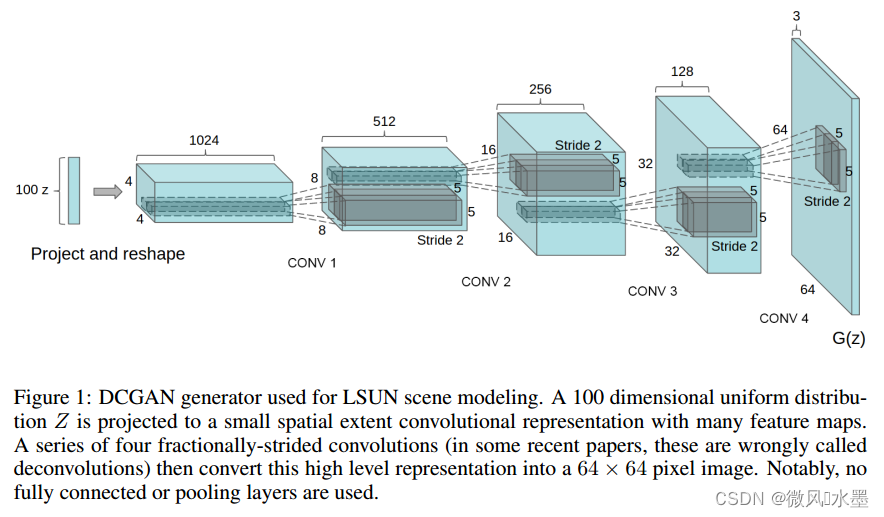

1:全卷积网络:用逐步卷积代替确定性的空间池化函数(如maxpooling),使网络学习自己的空间下采样。使用这种方法,允许它学习他自己的空间上采样和鉴别器。

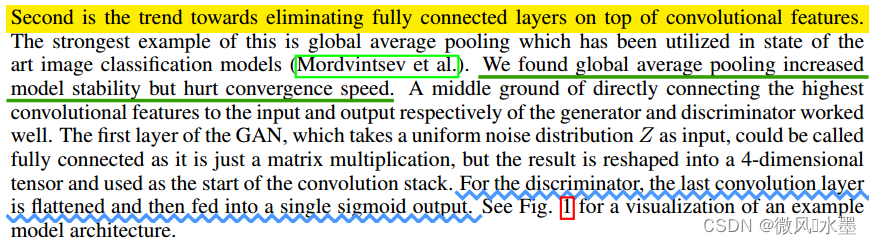

2:取消卷积特征之上的全连接层:gap平均池化层提升了模型的稳定性,但降低了收敛速度。

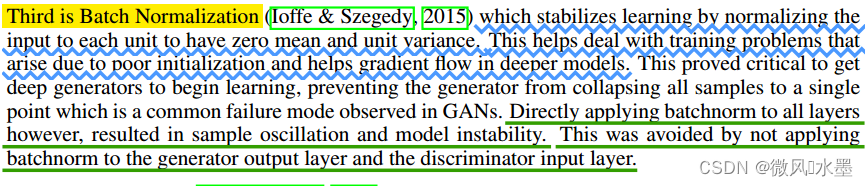

3:批量标准化:BN有助于处理由于初始化较差而出现的训练问题,并帮助深层模型中的梯度流。这证明深层生成器开始学习非常重要。直接将批处理应用于所有层面,会导致样品振荡和模型不稳定。通过不将批处理应用于生成器输出层和鉴别器输入层来避免。

生成器中除了output层使用Tanh 激活,其他层使用ReLU激活。判别器中使用leaky ReLU激活。

二、训练干货

1:除了缩放至tanh激活函数[-1,1]的范围之外,没有对训练图像进行应用预处理。

2:使用小批量随机梯度下降法(SGD)进行训练,batch size为128。

3:权重初始化都是以零为中心的正态分布初始化的,标准偏差为0.02。

4:在LeakyReLU中,斜率设置为0.2。

5:使用Adam优化器。我们发现建议的学习率为0.001太高,用0.0002来代替。此外,我们发现将动量项留在0.9的建议值导致了训练振荡和不稳定性,同时将其降低到0.5,这有助于稳定训练。

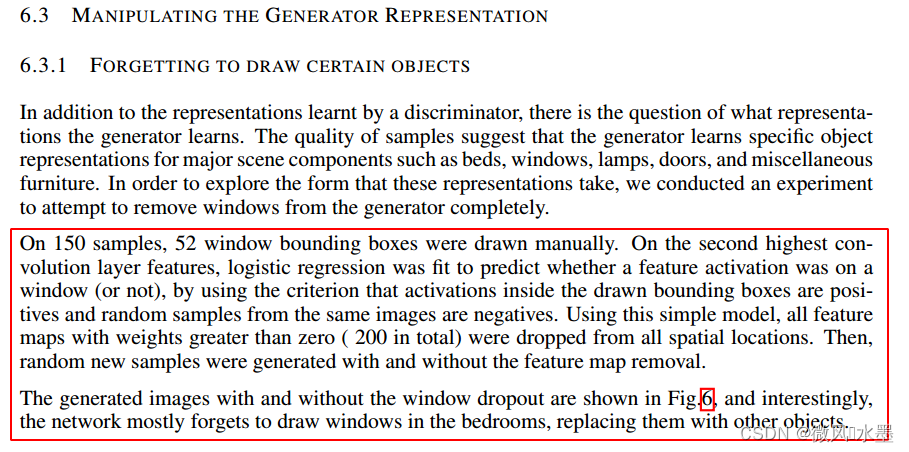

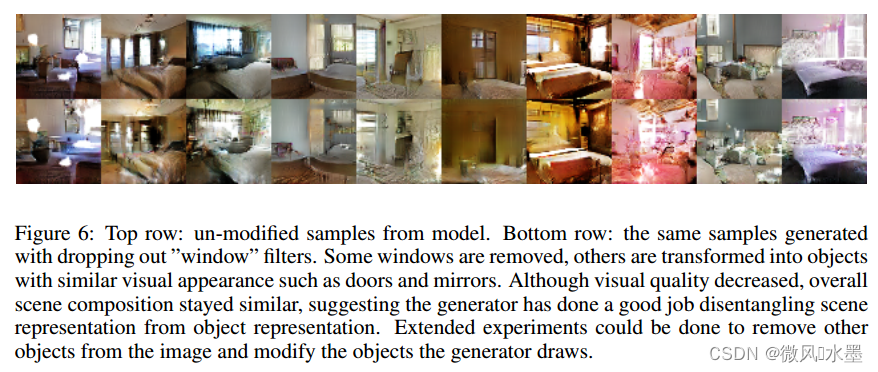

三、操纵生成表示

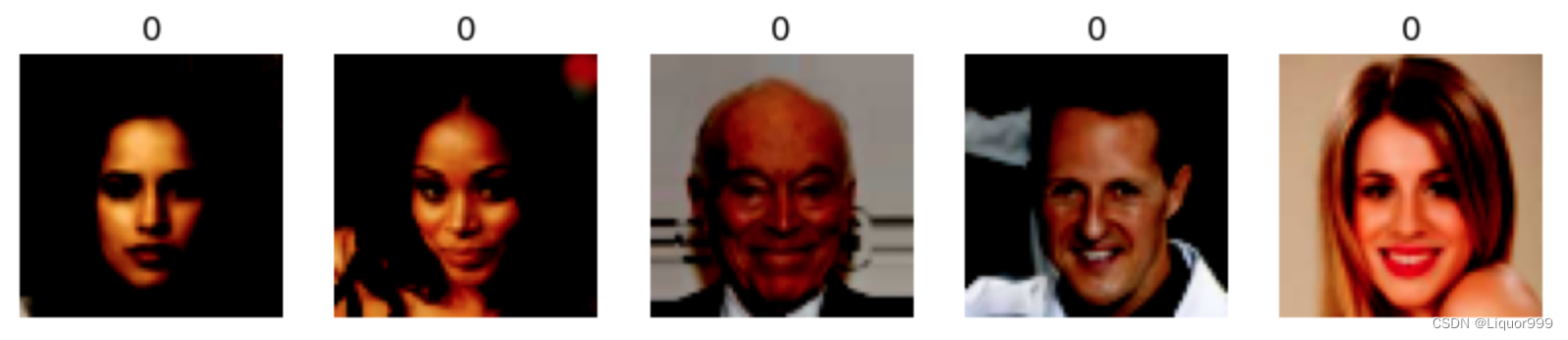

四、人脸上的尝试

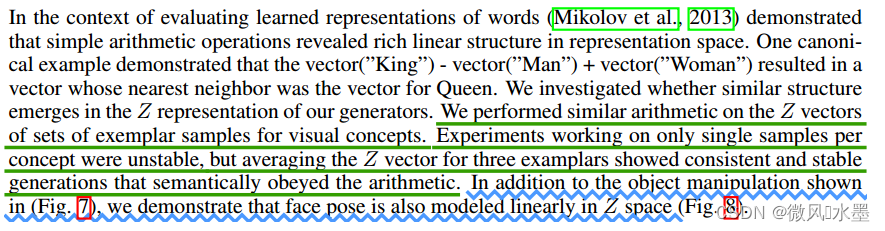

经典示例:king国王特征 - man男性特征 + women女性特征 = queen女王特征

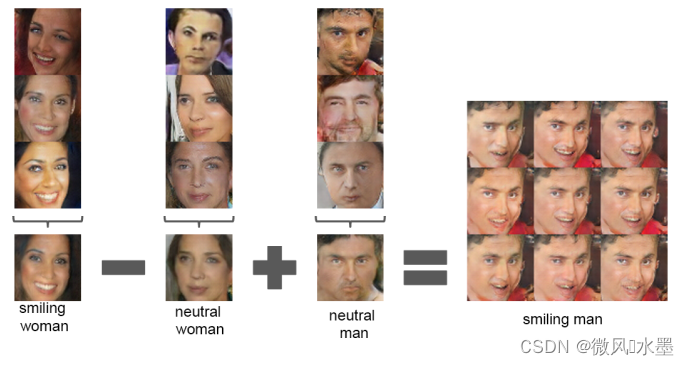

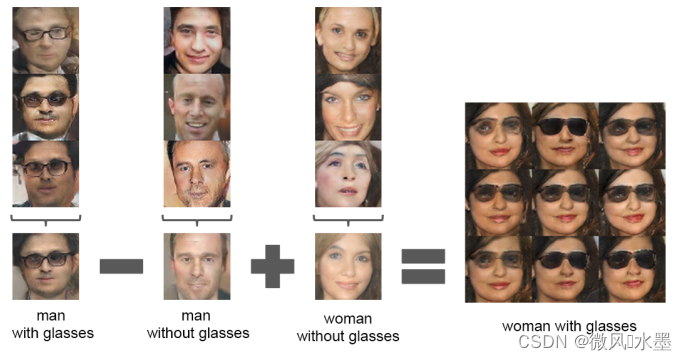

对单个样本进行实验,结果是不稳定的,但是对三个样本的Z向量进行平均,显示了在语义上服从算术是一致的和稳定的。此外,我们还证明了人脸姿态也是在Z空间中线性建模的。 (暗指人脸编辑是可行的,当然这个是16年,很早的文章了,很有启发性。后续已经有更好的方案了)

3个女性(微笑表情)的平均 – 3个女性(正常表情)的平均 + 3个男性(正常表情)的平均

= 可以生成微笑表情的男性

左边3列:

右边3列:

其他两列是通过使用比例为 +-0.25 的均匀噪声采样对Y进行操作,产生得到。

1:阅读pytorch官方指南:https://pytorch.org/tutorials/beginner/dcgan_faces_tutorial.html

2:使用pytorch官方代码:https://github.com/pytorch/tutorials/blob/main/beginner_source/dcgan_faces_tutorial.py

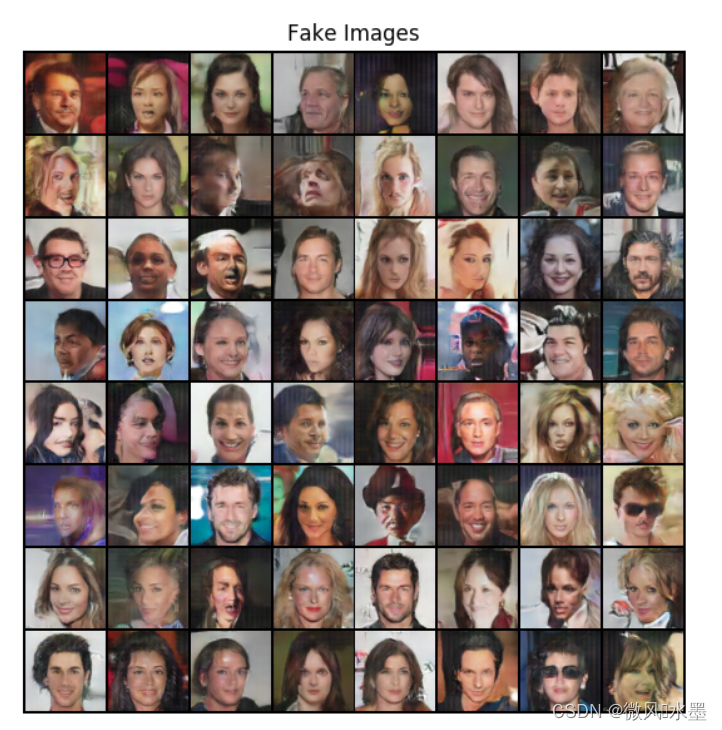

迭代了50个epoch的效果,还是比较抽象吧,但可以很好学习code。

原文地址:https://blog.csdn.net/lilai619/article/details/134660305

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_5535.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!