跨模态图像翻译:使用具有感知监督的多生成网络合成MR脑图像的CT图像

Computer Methods and Programs in Biomedicine 237 (2023) 107571

背景

贡献

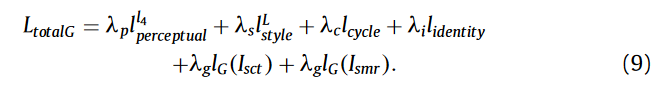

我们提出了一个跨模态生成网络。为了平衡成对MRI和CT图像的结构对齐,我们在先前工作的基础上使用了结构感知损失重建方法[21]。Johnson等人的论文[22]通过计算特征提取器输出的感知损失,增强了对目标风格的监督。在CT重建任务中,我们采用了多层ImageNet预训练的ResNet-50的感知损失。我们的工作验证了所提出的方法可以在模态转换中保持MRI图像和CT图像之间的结构一致性。

CT-MRI变换中的结构对准结构对准是跨模态图像生成的关键因素,先前的研究表明,成对的CT-MRI图像中的逐像素结构错位会导致重建失败。为了应对CT-MRI配准中结构不相似的挑战,我们提出了一种新的训练方法,该方法能够从结构不一致的CT-MRI数据集进行重建,同时保留输入域的原始组织和结构信息。我们的方法为解决临床实践中CT-MRI配准结果中的像素错位提供了一种潜在的解决方案。

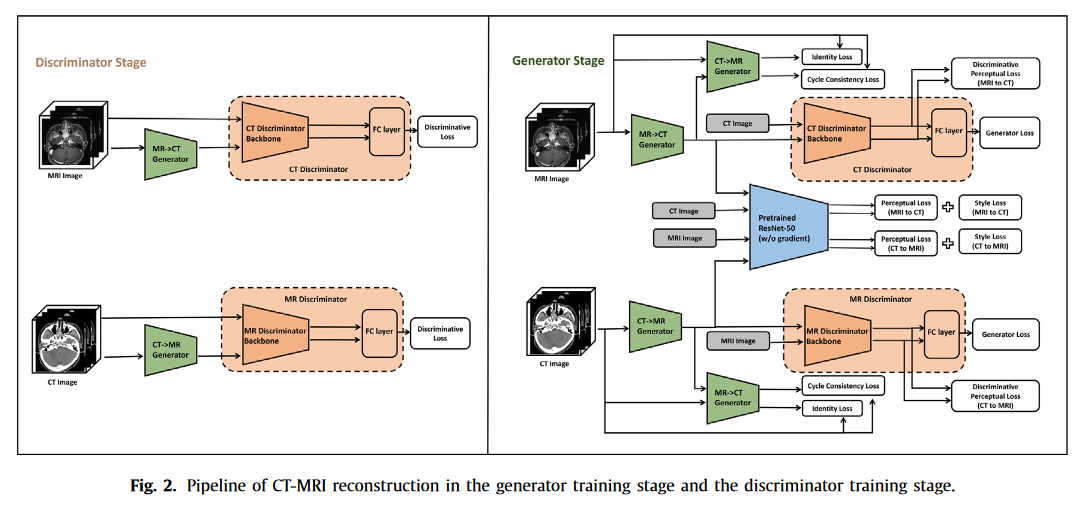

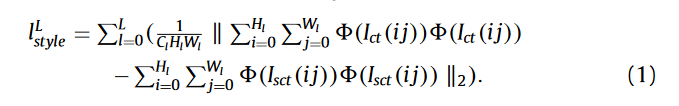

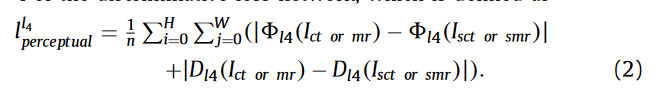

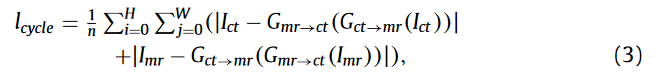

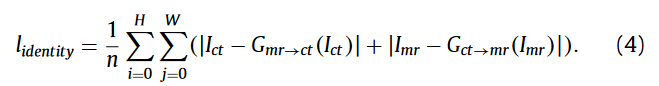

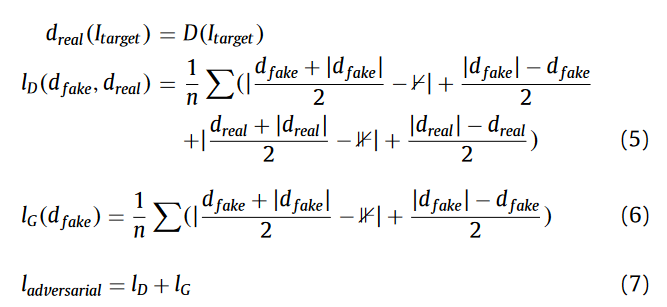

受CycleGAN和风格转移方法的启发,我们的工作提出了一个统一的三种损失(感知、CycleGAN和风格损失)目标函数,以解决跨域转换中内容重构的收敛问题。与普通的循环一致性损失相比,联合目标函数对内容重建的体素保持了更高的保真度。

[21] X. Gu, Z. Liu, J. Zhou, H. Luo, C. Che, Q. Yang, L. Liu, Y. Yang, X. Liu, H. Zheng, D. Liang, D. Luo, Z. Hu, Contrast-enhanced to noncontrast CT transformation via an adjacency content–transfer–based deep subtraction residual neural network, Phys. Med. Biol. 66 (14) (2021) 145017, doi:10.1088/1361-6560/ac0758.

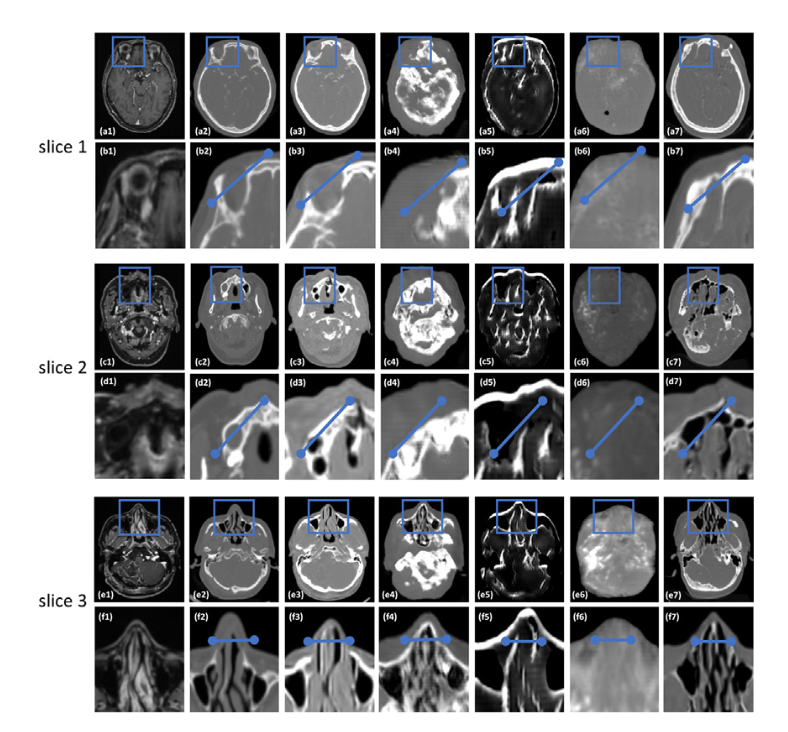

实验

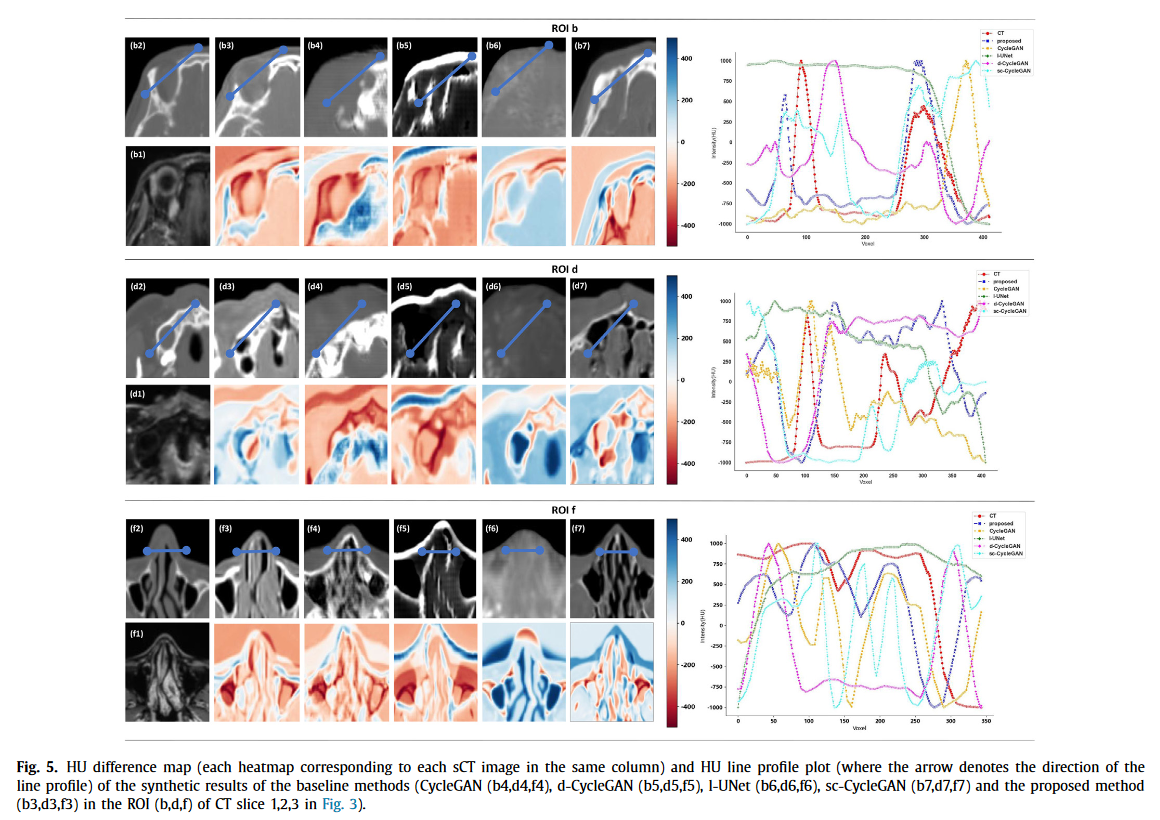

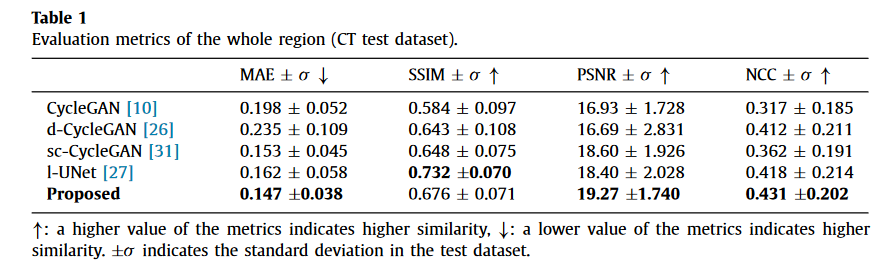

用热图图评估了配对CT图像和合成CT图像之间的结构差异,热图是通过Hounsfield单位(HU)值的强度差异计算的。因此,我们使用核密度估计(KDE)曲线在CT头部测试图像的整个区域上分析了CT图像的HU分布。我们通过对标记线中像素位置对应的HU值进行采样来评估测试图像的HU轮廓。

数据集:私有CT、MRI数据集,25例,3416对,体素大小为0.5 mm×0.5 mm×1.0 mm,使用刚性配准算法对每个患者的CT和MR图像进行刚性对齐,并将它们重新采样到相同的体素大小和视野,以形成数据集。为了避免我们提出的模型中的过拟合和数据泄露,我们将数据集划分为来自10名患者的1366个CT/MR切片的训练集和来自15名患者的2050个CT/MR切片的测试集

方法

引入了一种感知提取方法,该方法在我们之前与CT重建相关的工作中提出[21]。在这项工作中,我们实现了一个预训练的具有冻结参数的ResNet-50作为损失网络

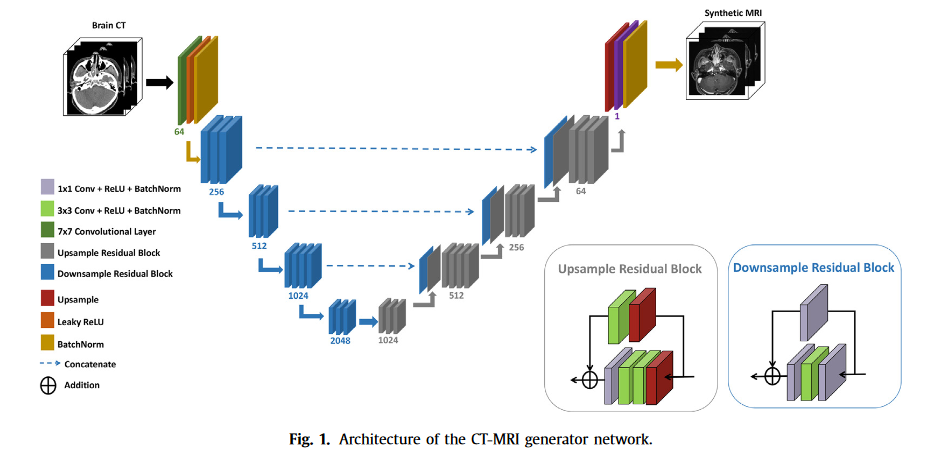

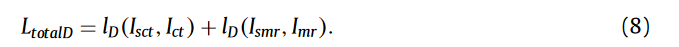

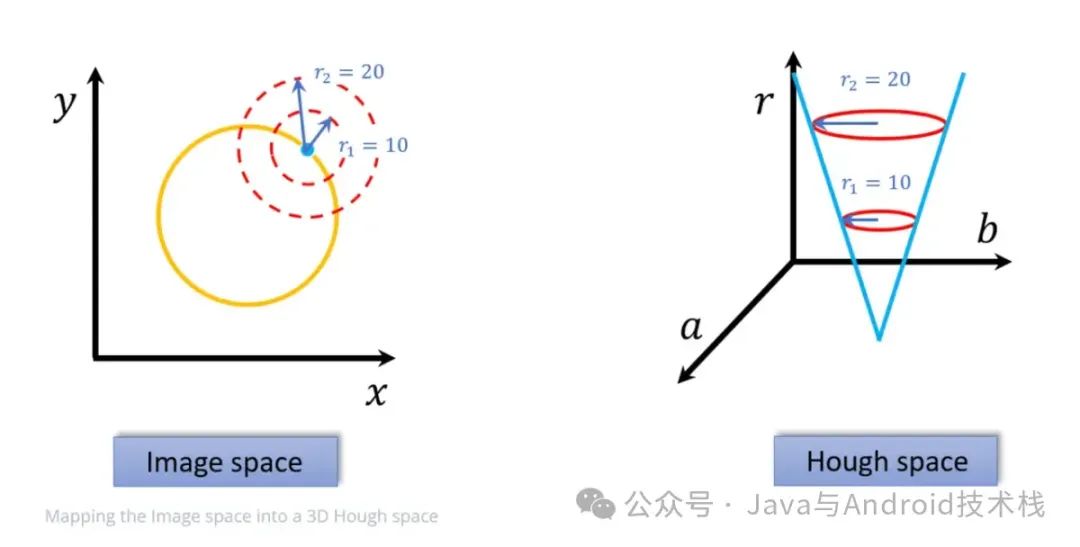

参考CycleGAN,我们提出的方法初始化用于MRI到CT转换和CT到MRI转换的两个生成器。对应于MRI到CT发生器和CT到MRI发生器,该方法构造了两个鉴别器网络来识别真实目标的模拟。此外,我们的方法利用特征提取方法来保留结构未对准的输入到目标变换中的重要结构信息。为了捕捉特征图整个区域中目标特征的一致性,我们引入了一种感知提取方法,该方法在我们之前与CT重建相关的工作中提出[21]。在这项工作中,我们实现了一个预训练的具有冻结参数的ResNet-50作为损失网络。此外,我们使用鉴别器网络的主干来提取目标域中的身份特征。这两个特征提取器都有助于生成器网络的损失计算。图1显示了生成器网络的架构,包括上采样和下采样残差块的架构。