本文介绍: 双向 编码器加上mask做完形填空超大模型无监督预训练 需要整个模型作为pretrain weight到下游任务做fintune总结个毛。

文章目录

不会写的很详细,只是为了帮助我理解在CV领域transformer的拓展

1 摘要

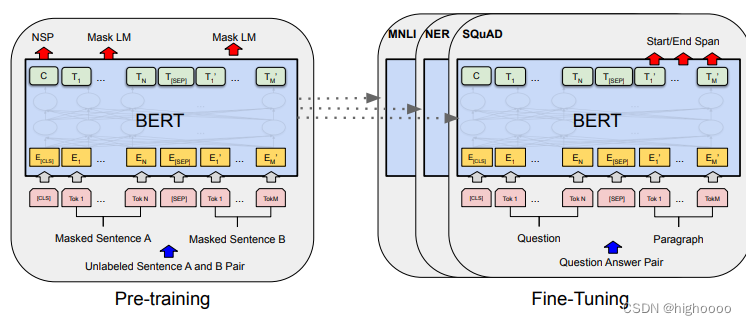

1.1 BERT – 核心

双向 编码器 加上mask做完形填空超大模型无监督预训练 需要整个模型作为pretrain weight到下游任务做fintune

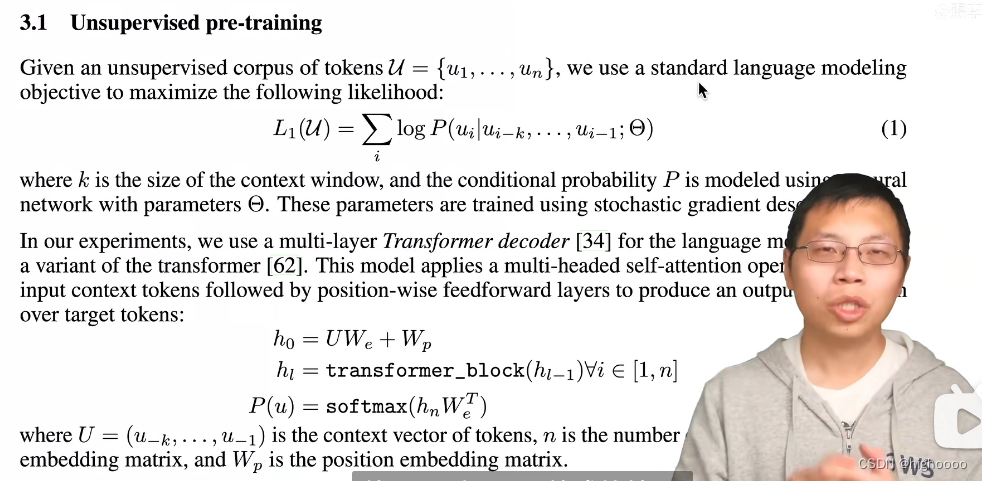

1.2 GPT – 核心

自回归 解码器 无需训练 只需Prompt

2 模型架构

2.1 概览

3 区别

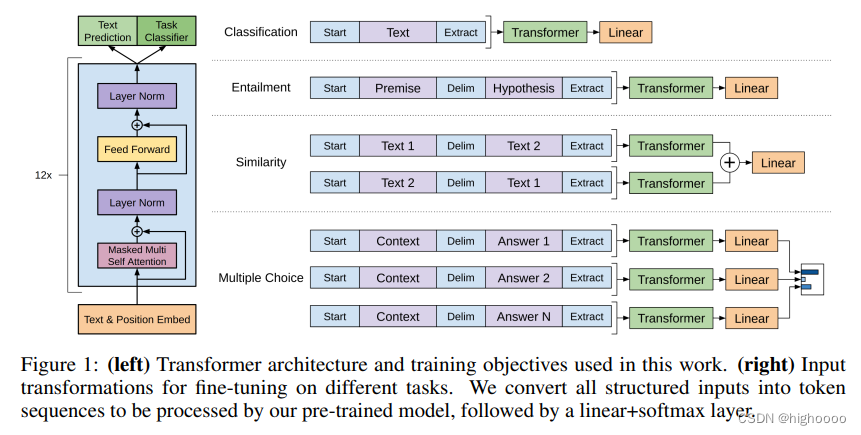

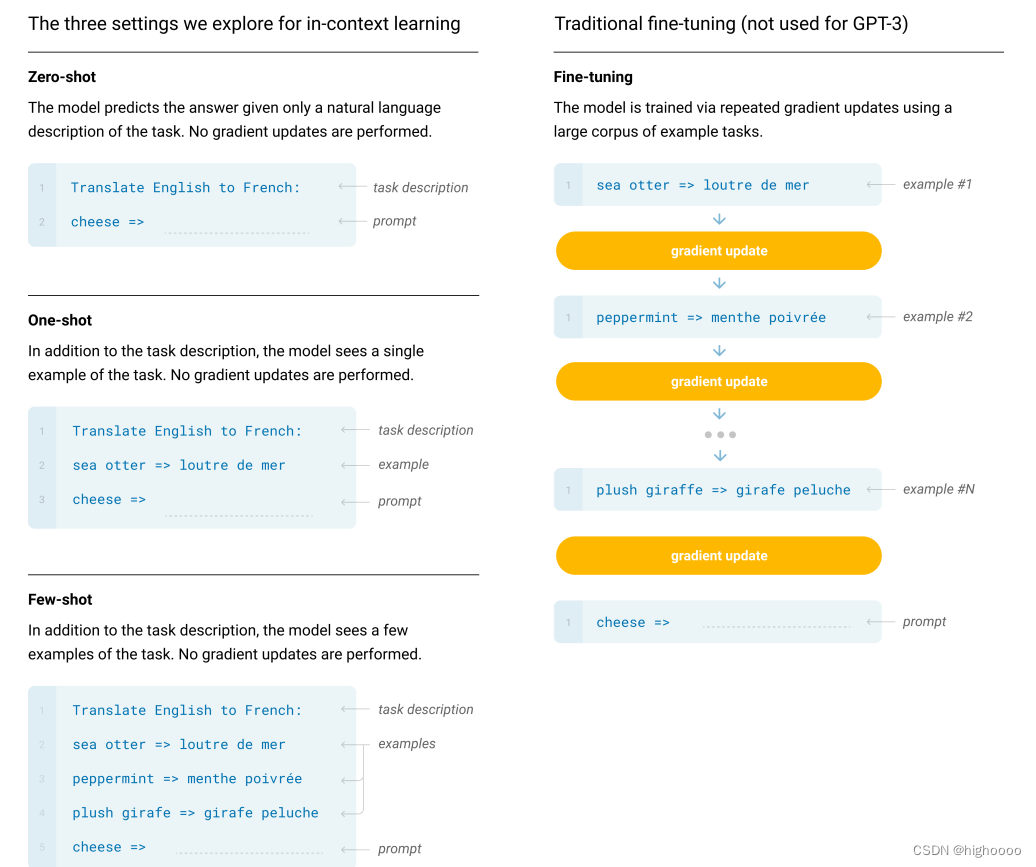

3.1 finetune和prompt

BERT需要全部参数进行训练

GPT不需要训练即可完成下游任务

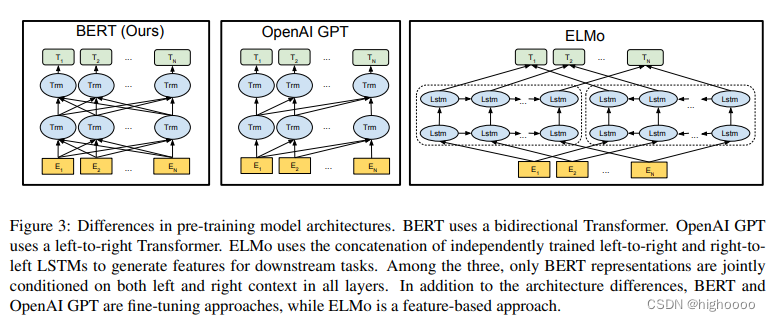

3.2 transformer及训练

BERT使用双向的编码器

GPT使用自回归的解码器

总结

总结个毛

原文地址:https://blog.csdn.net/highoooo/article/details/135487425

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_53930.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。