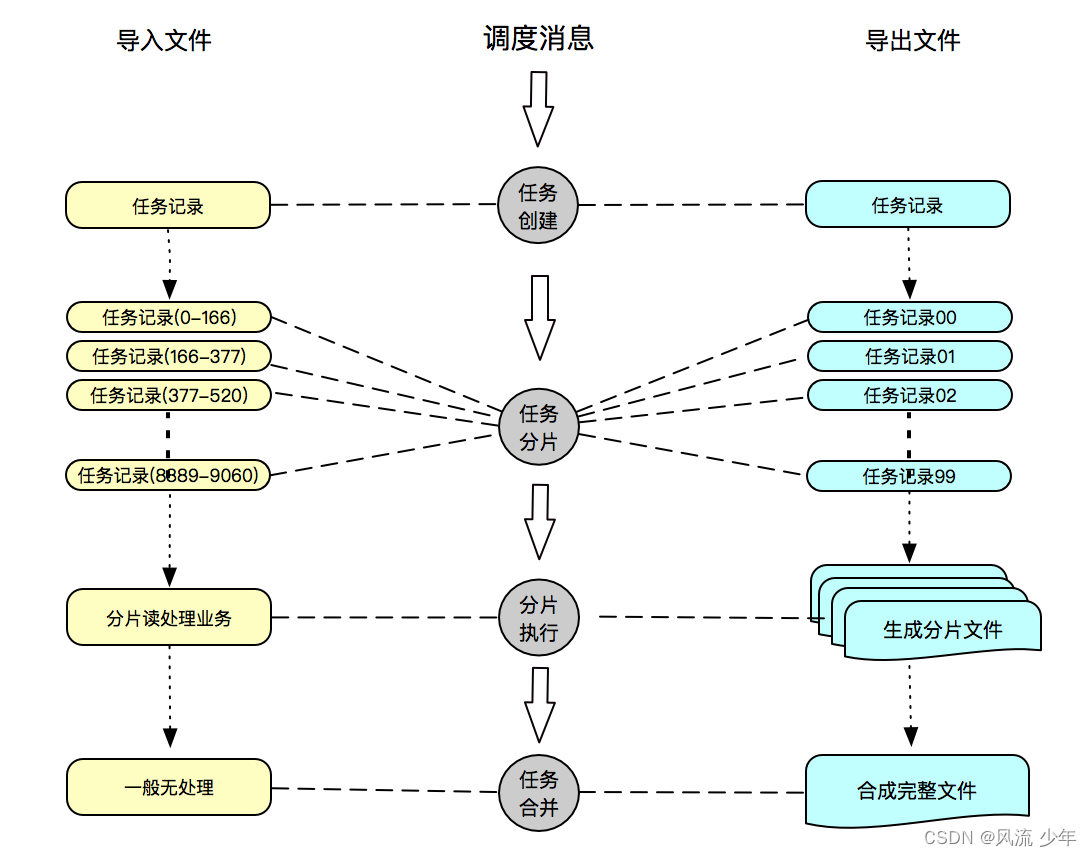

本文介绍: 文件大了单机处理就很慢, 数据库解决单机瓶颈方式是分库分表, 文件也一样需要将文件拆分,利用集群机器并发处理。一:数据量大了以后,单机解析或者生成文件的效率就很低,需要通过集群处理。二:分布式下文件处理需要分布式的文件存储。

一:简介

数据量大了以后,单机解析或者生成文件的效率就很低,需要通过集群处理:

二:分布式环境原理

文件大了单机处理就很慢, 数据库解决单机瓶颈方式是分库分表, 文件也一样需要将文件拆分,利用集群机器并发处理。

三:通信交互

使用文件异步交互和使用接口同步交互完全不同,文件交互会将请求的数据和响应的数据先写到文件中,然后将文件上传到对方的SFTP上,然后对方再去解析(相当于接口的请求参数、接口的响应结果先给对方),然后再通过实时接口通知或者定时任务触发去获取。

请求Request:先将请求参数(请求文件)上传到对方的SFTP服务器上,然后通过接口实时通知告诉对方数据已经准备好了你们可以处理了,也可以让对方在指定时间通过定时任务触发。发送文件send。响应Response:先将处理结果(响应文件)传到对方的SFTP服务器上,然后通过接口实时通知对方结果已经上传给你们了你们可以去获取了,也可以让对方在指定时间通过定时任务触发。接收文件。

四:分布式环境一般处理流程

文件切分是指按大小将数据内容分片, 这里分片到行不会在行中间断开。

-

FileSplitter splitter = FileFactory.createSplitter(config.getStorageConfig()); -

FileSlice headSlice = splitter.getHeadSlice(config); List slices = splitter.getBodySlices(config, 256); FileSlice tailSlice = splitter.getTailSlice(config);

其它

<dependency>

<groupId>org.apache.commons</groupId>

<artifactId>commons-collections4</artifactId>

<version>4.4</version>

</dependency>

public class ListUtils {

// list分片

public static <T> List<List<T>> partition(List<T> list, int size);

}

原文地址:https://blog.csdn.net/vbirdbest/article/details/134631655

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_13571.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。