提高运行效率一般采取底层使用spark引擎替换成hive引擎的方式提高效率,但替换引擎配置较为复杂考虑到兼容版本且容易出错,所以本篇将介绍使用DBeaver直接连接spark–sql快速操作hive数据库。

在spark目录下运行以下命令,创建一个SparkThirdService端口号为10016

sudo -u root ./sbin/start-thriftserver.sh

--hiveconf hive.server2.thrift.port=自定义端口号

--hiveconf hive.server2.thrift.bind.host=主机ip地址

--hiveconf spark.sql.warehouse.dir=hdfs://主机IP地址:hadoop端口/hive在hdfs下的路径目录

--master yarn

--executor-memory 4G

--conf spark.sql.shuffle.partitions=10vi /home/client-saprk-sqlsudo -u root /opt/module/spark/sbin/start-thriftserver.sh

--hiveconf hive.server2.thrift.port=10016

--hiveconf hive.server2.thrift.bind.host=192.168.10.137

--hiveconf spark.sql.warehouse.dir=hdfs://192.168.10.137:9000/user/hive/warehouse

--master yarn

--executor-memory 4G

--conf spark.sql.shuffle.partitions=10执行:

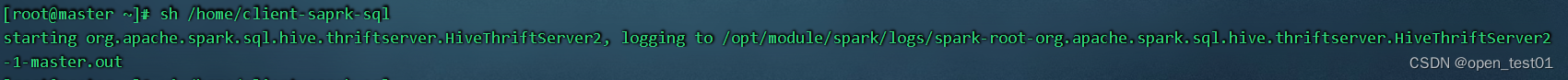

sh /home/client-saprk-sql

CREATE TABLE test_table (

id STRING,

name STRING

);

INSERT INTO test_table VALUES ('1', 'John');

INSERT INTO test_table VALUES ('2', 'Jane');

原文地址:https://blog.csdn.net/dafsq/article/details/134714394

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_18355.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!