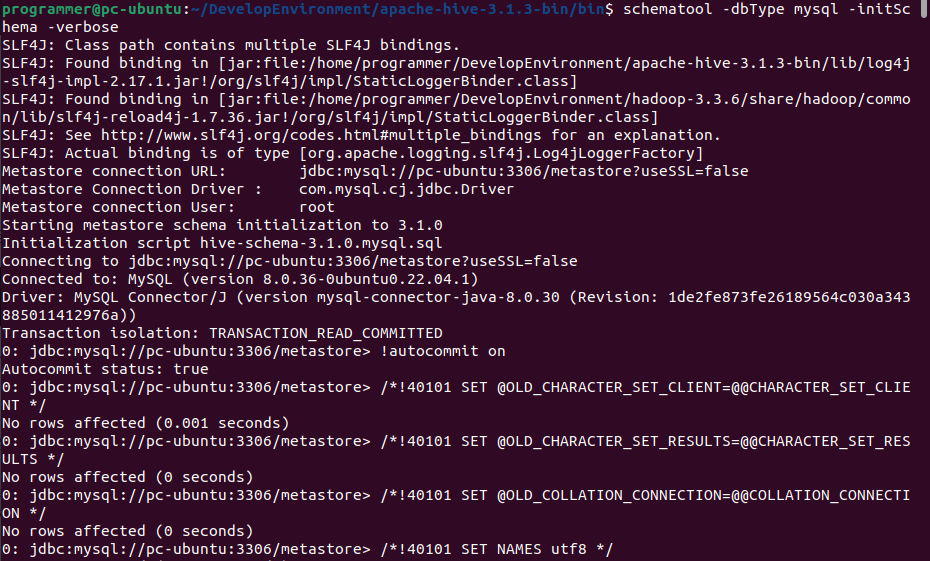

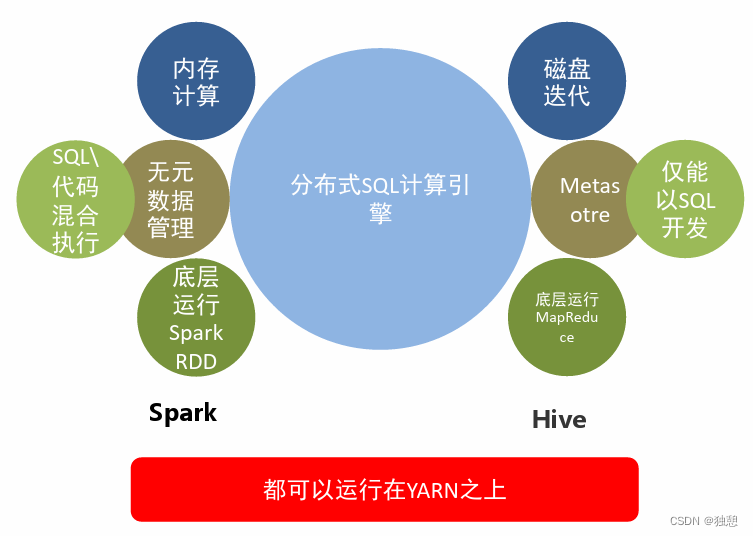

hive使用的是3.13版本,spark是3.3.3支持hadoop3.x

hive将engine从mr改成spark,通过beeline执行insert、delete时一直报错,sparkTask rpc关闭,

查看yarn是出现ClassNotFoundException: org.apache.hive.spark.client.Job。

开始以为是版本不兼容问题。spark3.3.3编译版本对应的hive是2.3.9

切换hive2.3.9依然是org.apache.hive.spark.client.Job找不到问题。

spark的jars目录存在hive–exec–core-2.3.9.jar,反复对比hive的lib目录,发现是hive-exec.jar没有core,将spark3.3.3下hive的hive-exec–core-2.3.9.jar删掉,替换成hive下的lib文件,重启spark和hive,这个错误消失了

重新执行命令,又出现找不到其他类的情况,可能是spark官方发布的hive相关包和hive发布版的有差别把。什么原因,不知道,先替换试试。替换了还不太行,引发其他问题,自己编译吧

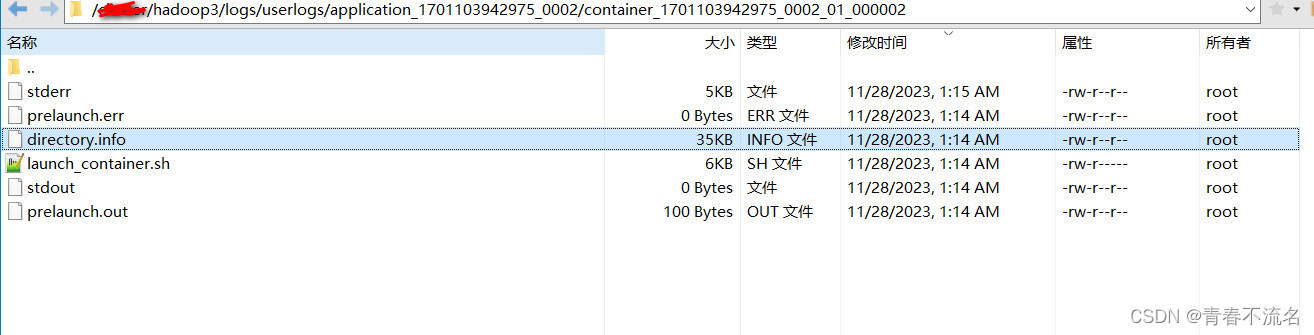

End of LogType:launch_container.sh.This log file belongs to a running container (container_1701103942975_0002_01_000001) and so may not be complete.

yarn logs –applicationId application_1701103942975_0002

原文地址:https://blog.csdn.net/TT1024167802/article/details/134658098

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_20230.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!

![[Lucene]核心类和概念介绍](http://www.7code.cn/wp-content/uploads/2023/11/ee6748cbc735e6105405f8a984d954c804b93f34bc916-Z0IqTf_fw1200.png)