kafka 3.4.1

安装 JDK

yum install –y java-1.8.0-openjdk java-1.8.0-openjdk–devel

tar -zxvf apache–zookeeper-3.5.7-bin.tar.gz

mv apache–zookeeper-3.5.7-bin /opt/zookeeper

tickTime=2000 #通信心跳时间,Zookeeper服务器与客户端心跳时间,单位毫秒

initLimit=10 #Leader和Follower初始连接时能容忍的最多心跳数(tickTime的数量),这里表示为10*2s

syncLimit=5 #Leader和Follower之间同步通信的超时时间,这里表示如果超过52s,Leader认为Follwer死掉,并从服务器列表中删除Follwer

dataDir=/opt/zookeeper/data ●修改,指定保存Zookeeper中的数据的目录,目录需要单独创建

dataLogDir=/opt/zookeeper/logs ●添加,指定存放日志的目录,目录需要单独创建

server.1=192.168.176.70:3188:3288

server.2=192.168.176.71:3188:3288

server.3=192.168.176.72:3188:3288

在每个节点的dataDir指定的目录下创建一个 myid 的文件

echo 1 > /opt/zookeeper/data/myid

echo 2 > /opt/zookeeper/data/myid

echo 3 > /opt/zookeeper/data/myid

#description:Zookeeper Service Control Script

$ZK_HOME/bin/zkServer.sh start

;;

stop)

;;

$ZK_HOME/bin/zkServer.sh restart

;;

$ZK_HOME/bin/zkServer.sh status

;;

*)

echo “Usage: $0 {start|stop|restart|status}”

chmod +x /etc/init.d/zookeeper

安装:

cd /opt/

cp server.properties server.properties.bak

改经纪人id

broker.id=0 ●21行,broker的全局唯一编号,每个broker不能重复,因此要在其他机器上配置 broker.id=1、broker.id=2

listeners=PLAINTEXT://192.168.80.10:9092 ●31行,指定监听的IP和端口,如果修改每个broker的IP需区分开来,也可保持默认配置不用修改

num.network.threads=3 #42行,broker 处理网络请求的线程数量,一般情况下不需要去修改

num.io.threads=8 #45行,用来处理磁盘IO的线程数量,数值应该大于硬盘数

socket.send.buffer.bytes=102400 #48行,发送套接字的缓冲区大小

socket.receive.buffer.bytes=102400 #51行,接收套接字的缓冲区大小

socket.request.max.bytes=104857600 #54行,请求套接字的缓冲区大小

log.dirs=/var/log/kafka #60行,kafka运行日志存放的路径,也是数据存放的路径

num.partitions=1 #65行,topic在当前broker上的默认分区个数,会被topic创建时的指定参数覆盖

num.recovery.threads.per.data.dir=1 #69行,用来恢复和清理data下数据的线程数量

log.retention.hours=168 #103行,segment文件(数据文件)保留的最长时间,单位为小时,默认为7天,超时将被删除

log.segment.bytes=1073741824 #110行,一个segment文件最大的大小,默认为 1G,超出将新建一个新的segment文件

#Kafka 以日志文件的形式维护其数据,而这些日志文件被分割成多个日志段。当一个日志段达到指定的大小时,就会创建一个新的日志段。

zookeeper.connect=192.168.176.70:2181,192.168.176.71:2181,192.168.176.72:2181

每一台配置一下

![]()

![]()

export PATH=$PATH:$KAFKA_HOME/bin

kafka-topics.sh —create —bootstrap–server 192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092 –replication-factor 2 —partitions 3 —topic cc

kafka-topics.sh —list —bootstrap–server 192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092

kafka-topics.sh —describe —bootstrap–server 192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092

kafka-console–producer.sh –broker-list 192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092 –topic cc

消费消息

kafka-console–consumer.sh —bootstrap–server 192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092 –topic cc

kafka-console–consumer.sh —bootstrap–server 192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092 –topic cc –from-beginning

创建单个主题

kafka-topics.sh —create —bootstrap–server 192.168.176.70:9092 –replication-factor 2 —partitions 3 –topic test1

修改分区数

kafka-topics.sh —bootstrap-server 192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092 —alter –topic test1 —partitions 6

删除 topic

kafka-topics.sh —delete —bootstrap-server 192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092 –topic test1

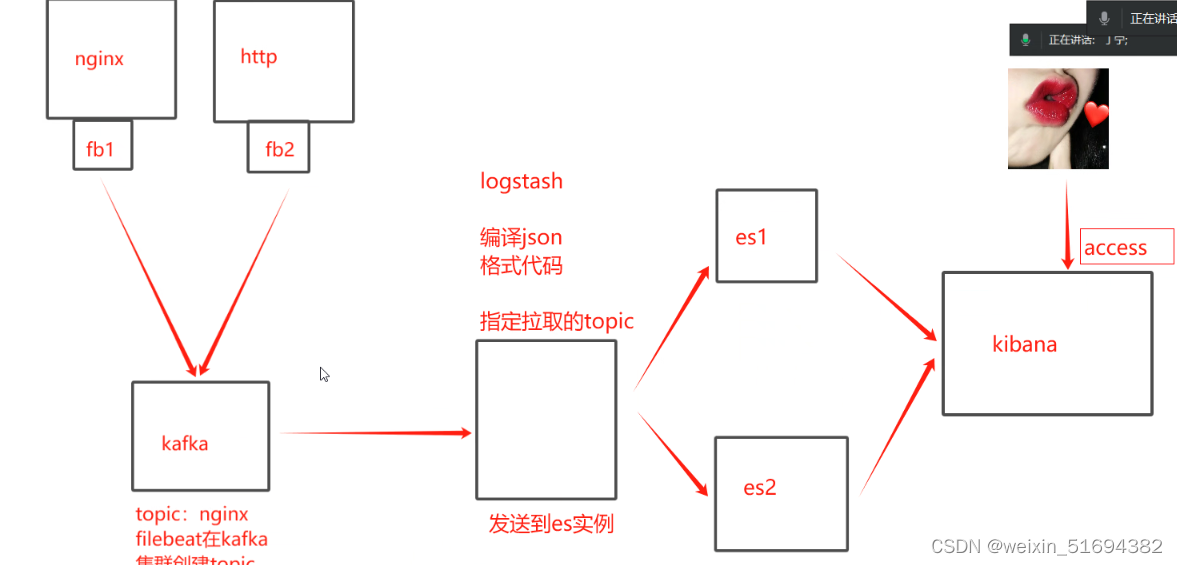

安装 Filebeat

tar zxvf filebeat-6.7.2-linux-x86_64.tar.gz

mv filebeat-6.7.2-linux-x86_64/ filebeat

#上传软件包 logstash-6.7.2.rpm 到/opt目录下

cd /opt

systemctl start logstash.service

systemctl enable logstash.service

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

或

2.部署 Filebeat

fields:

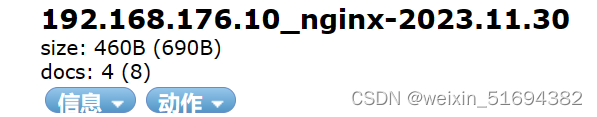

service_name: 192.168.176.10_nginx

from: 192.168.176.10

output.kafka:

hosts: [“192.168.233.70:9092″,”192.168.233.71:9092″,”192.168.233.72:9092”]

nohup ./filebeat -e -c filebeat.yml >filebeat.out &

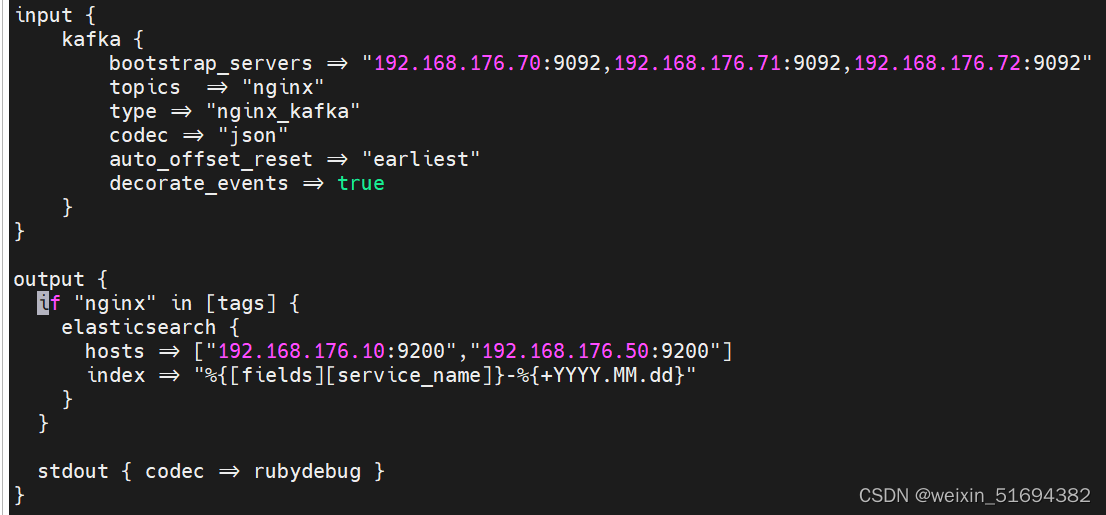

部署 ELK,在 Logstash 组件所在节点上新建一个 Logstash 配置文件

input {

kafka {

bootstrap_servers => “192.168.176.70:9092,192.168.176.71:9092,192.168.176.72:9092”

auto_offset_reset => “earliest”

}

}

output {

hosts => [“192.168.176.10:9200″,”192.168.176.50:9200”]

index => “%{[fields][service_name]}-%{+YYYY.MM.dd}”

}

}

}

logstash -f kafka.conf —path.data /opt/test1 &

安装 Filebeat

tar zxvf filebeat-6.7.2-linux-x86_64.tar.gz

mv filebeat-6.7.2-linux-x86_64/ filebeat

安装logstash

#上传软件包 logstash-6.7.2.rpm 到/opt目录下

cd /opt

rpm -ivh logstash-6.7.2.rpm

systemctl start logstash.service

systemctl enable logstash.service

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

2.部署 Filebeat

nohup ./filebeat -e -c filebeat.yml >filebeat.out &

在 Logstash 组件所在节点上新建一个 Logstash 配置文件

logstash -f kafkahttpd.conf —path.data /opt/test1 &

原文地址:https://blog.csdn.net/weixin_51694382/article/details/134739741

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_23962.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!