本文介绍: 如果我们想在手机端运行我们的深度学习模型需要怎么做呢?本文介绍了端侧深度学习模型部署流程(NCNN),在了解基本概念之后可以尝试运行NCNN官方demo实例,并根据自己需求进行改进,这样就可以在自己的手机上部署深度学习模型啦~

上一篇介绍了PyTorch模型部署流程(Onnx Runtime)的相关部署流程,再来简单的回顾一下~

深度学习模型部署介绍

模型部署指让训练好的深度学习模型在特定环境中运行的过程。模型部署会面临的难题:

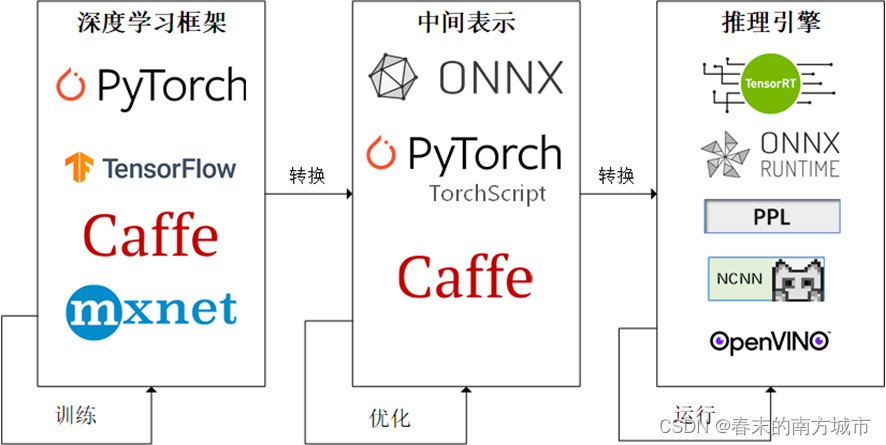

因为这些难题的存在,模型部署不能靠简单的环境配置与安装完成。目前模型部署有一条流行的流水线:

为了让模型最终能够部署到某一环境上,可以使用任意一种深度学习框架来定义网络结构,并通过训练确定网络中的参数。之后,模型的结构和参数会被转换成一种只描述网络结构的中间表示,一些针对网络结构的优化会在中间表示上进行。最后,用面向硬件的高性能编程框架(如 CUDA,OpenCL)编写,能高效执行深度学习网络中算子的推理引擎会把中间表示转换成特定的文件格式,并在对应硬件平台上高效运行模型。

那么,如果我们想在手机端运行我们的深度学习模型需要怎么做呢?接下来为大家介绍关于端侧深度学习的部署流程,大家了解了基本概念之后可以尝试运行官方demo实例,并根据自己需求进行改进,这样就可以在自己的手机上部署深度学习模型啦~

端侧深度学习模型部署流程

ONNX

NCNN

部署实践

a.模型文件转为ONNX文件

b.ONNX格式模型->端侧推理框架模型(NCNN格式)

c.在Android studio项目中使用模型文件

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。