目录

Part.01 关于HDP

Part.02 核心组件原理

Part.03 资源规划

Part.04 基础环境配置

Part.05 Yum源配置

Part.06 安装OracleJDK

Part.07 安装MySQL

Part.08 部署Ambari集群

Part.09 安装OpenLDAP

Part.10 创建集群

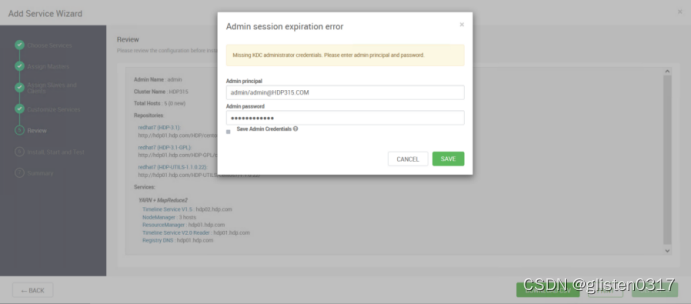

Part.11 安装Kerberos

Part.12 安装HDFS

Part.13 安装Ranger

Part.14 安装YARN+MR

Part.15 安装HIVE

Part.16 安装HBase

Part.17 安装Spark2

Part.18 安装Flink

Part.19 安装Kafka

Part.20 安装Flume

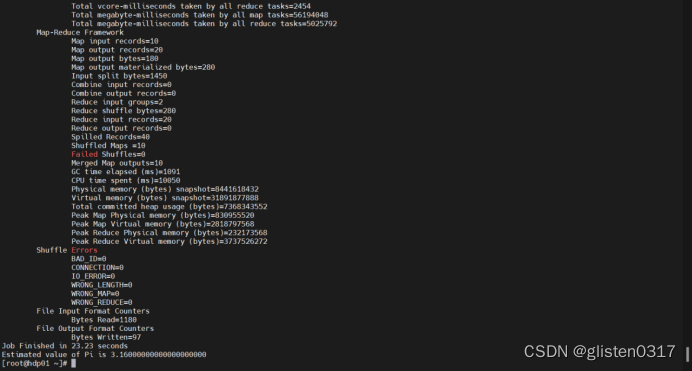

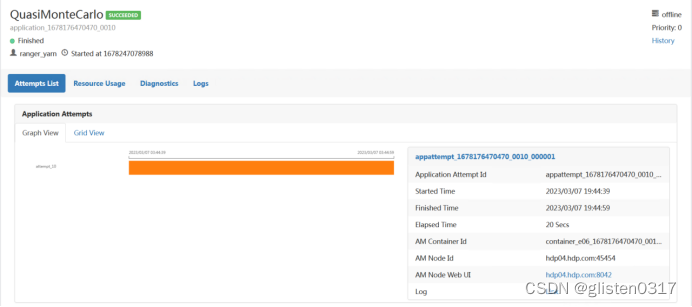

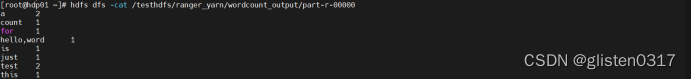

十四、安装YARN+MR

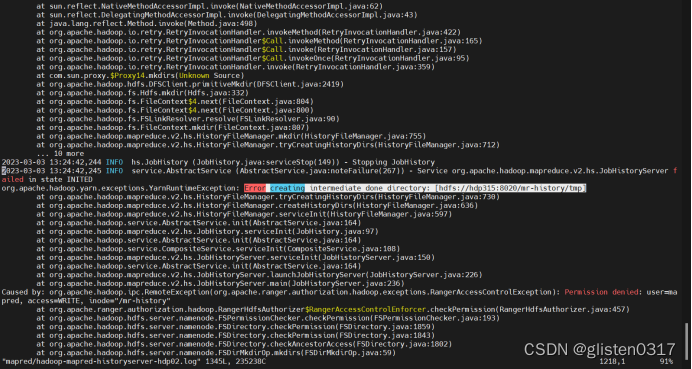

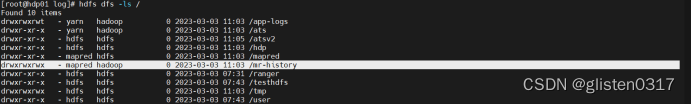

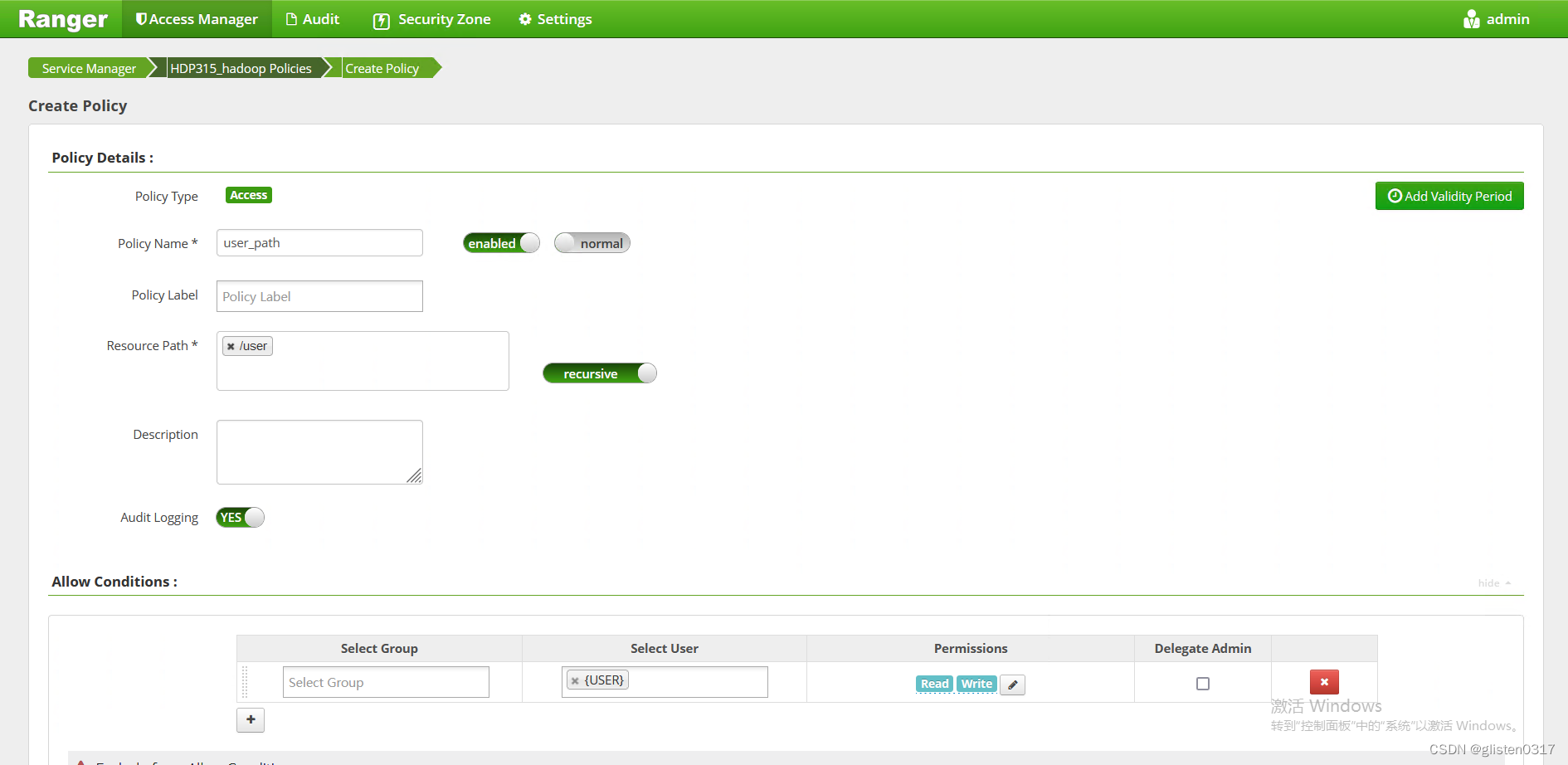

1.MR中间结果存储权限

使用Yarn提交MapReduce任务的时候,中间结果会保存在HDFS,/user/username/,如果/user目录下用户目录下不存在,则被创建,当MR执行结束之后,中间结果会被删除,目录保留。因此需要在Ranger中对/user的权限做策略。

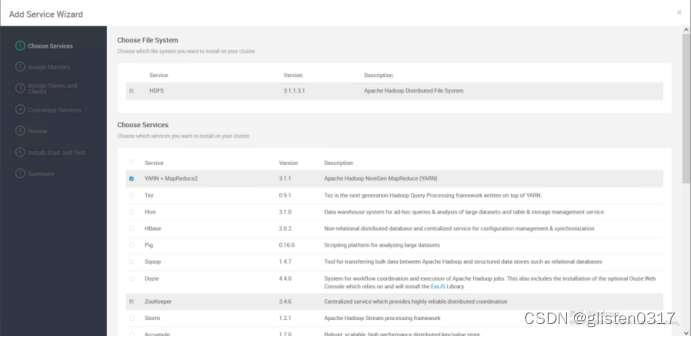

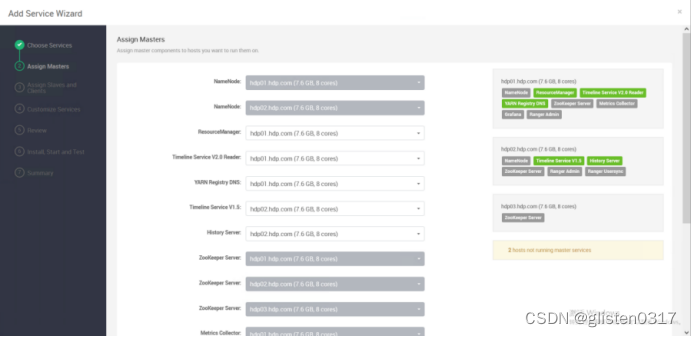

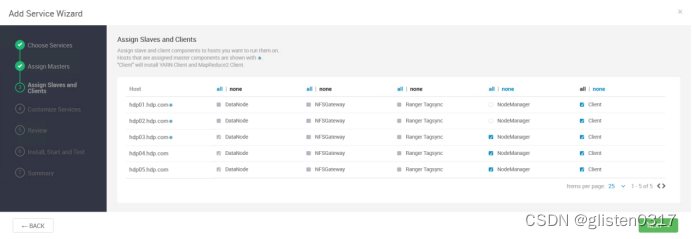

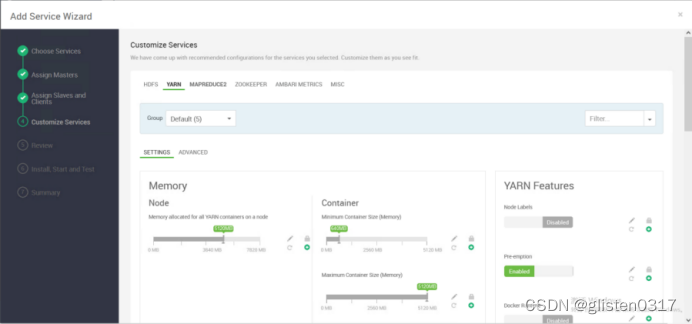

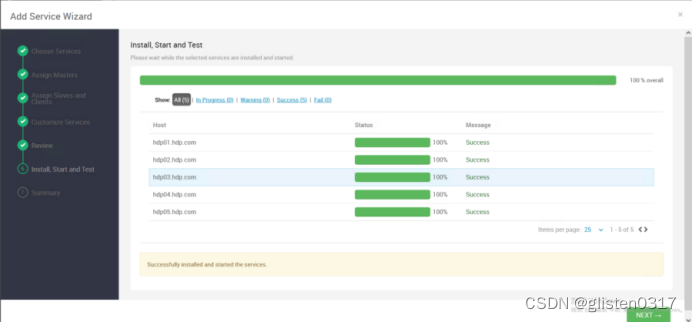

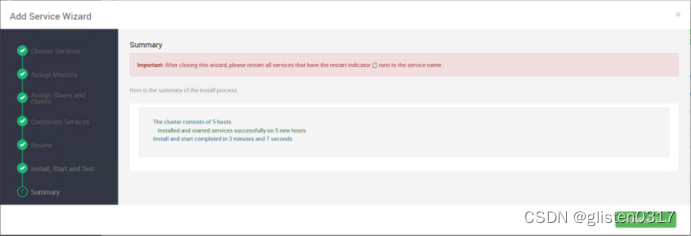

2.安装服务

YARN的部分存储路径调整:

Node Manager

YARN NodeManager Local directories:/data01/hadoop/yarn/local

YARN NodeManager Log directories:/data01/hadoop/yarn/log

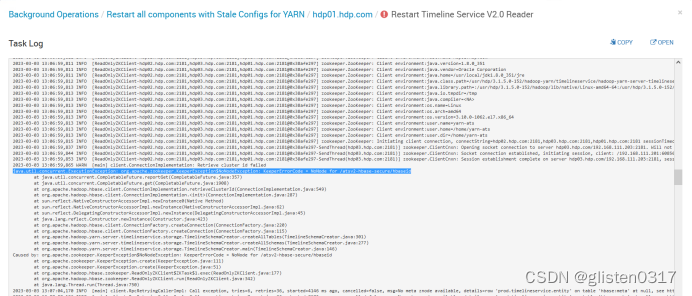

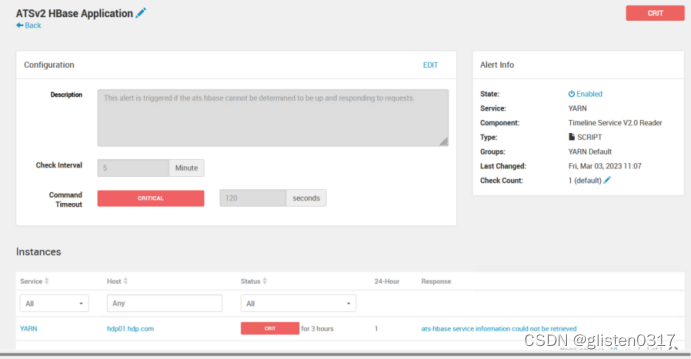

Application Timeline Server

yarn.timeline–service.leveldb–state–store.path:/data01/hadoop/yarn/timeline

yarn.timeline–service.leveldb–timeline–store.path:/data01/hadoop/yarn/timeline

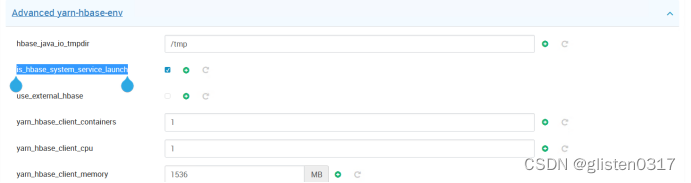

Advanced yarn–hbase–env

is_hbase_system_service_launch:true

use_external_hbase:false

YARN可使用内置的HBase数据库,也可以使用外部;使用内置时,需要is_hbase_system_service_launch设置为true

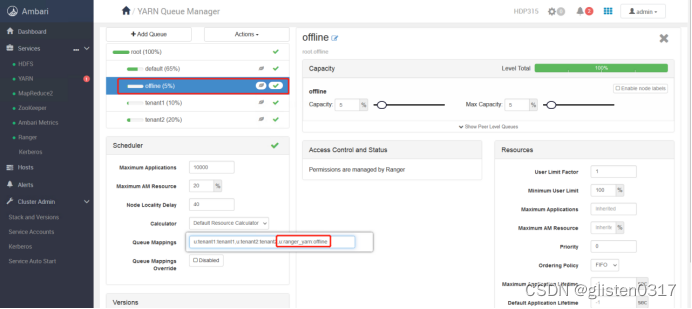

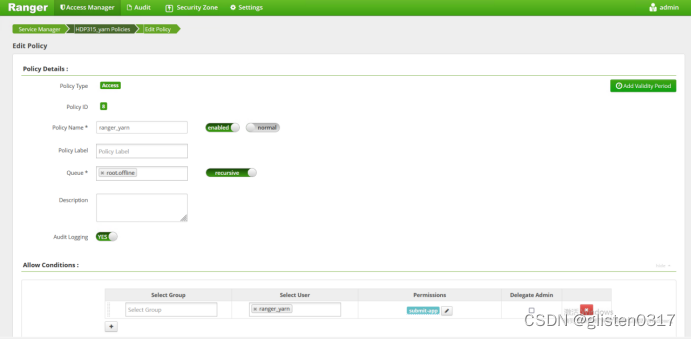

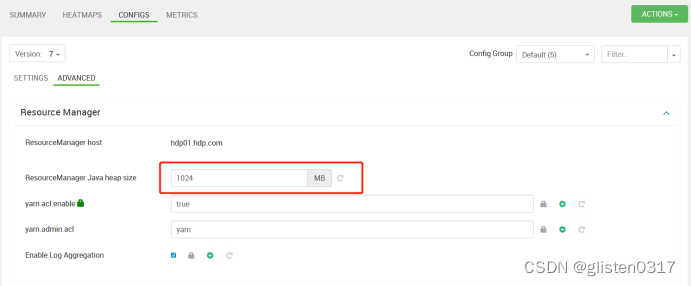

Advanced ranger–yarn–security

Add YARN Authorization:取消勾选

该选项是禁用YARN本身的ACL权限控制,YARN队列的权限控制由RANGER统一管理

注:需要先对NameNode页面的认证取消了,否则ResourceManager修改后也不生效

MAPREDUCE2的部分存储路径调整:

Advanced mapred–site

mapreduce.jobhistory.recovery.store.leveldb.path:/data01/hadoop/mapreduce/jhs

Custom mapred-site

mapred.local.dir:/data01/hadoop/mapred

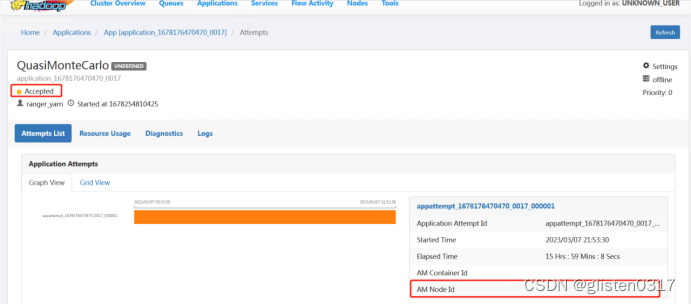

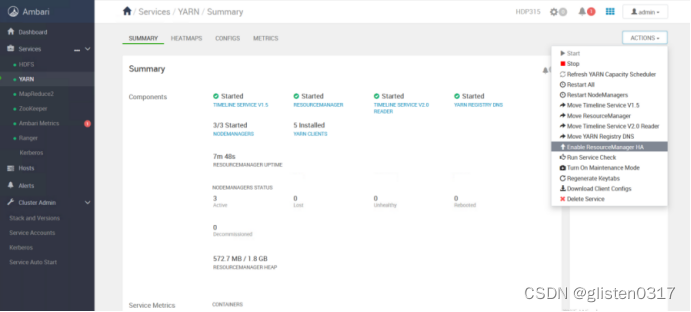

3.ResourceManager HA

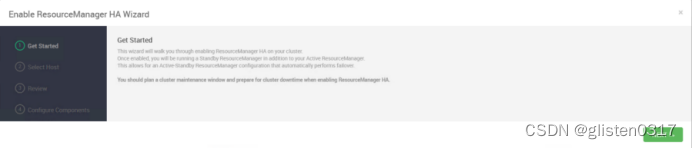

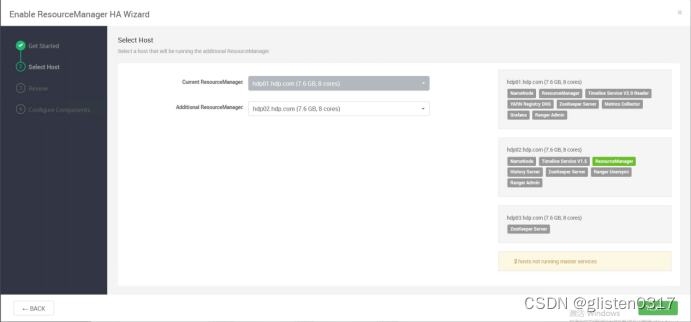

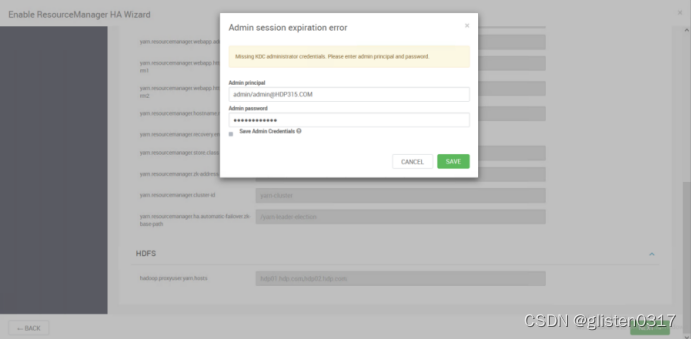

(1)启用HA

在ACTIONS->Enable ResourceManager HA中配置

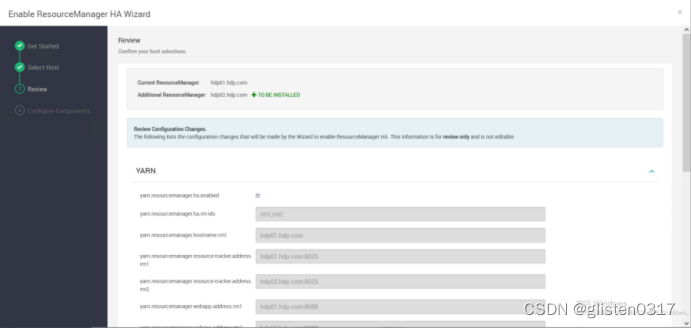

(2)确认配置文件

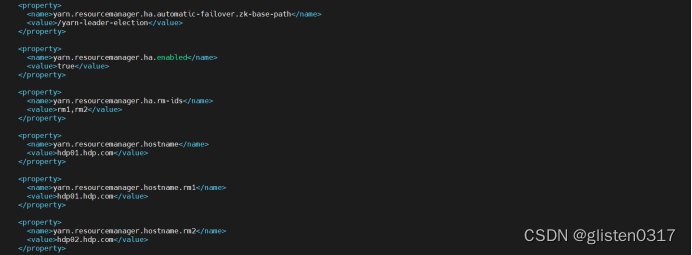

启用HA后,会在/etc/hadoop/conf/yarn-site.xml中出现如下关于HA的配置项

指定zk下对应的文件目录为/yarn-leader–election,对应的rm节点为hdp01.hdp.com和hdp02.hdp.com

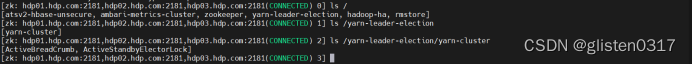

在zookeeper中查看也同样生成了对应的文件目录

(3)确认YARN、MR2配置

①CPU资源调度

目前的CPU被划分为虚拟CPU,这里的虚拟CPU是yarn自己引入的概念,因为每个服务器的CPU计算能力不一样,有的机器可能是其他机器计算能力的两倍,然后可以通过多配置几个虚拟CPU弥补差异。在yarn中,CPU的相关配置如下:

yarn.nodemanager.resource.cpu–vcores

表示该节点上YARN可使用的虚拟CPU个数,默认是8,注意,目前推荐将该值设置为与物理CPU核数数目相同。如果节点CPU核数不够8个,则需要调减小这个值,而YARN不会智能的探测节点的物理CPU总数。

yarn.scheduler.minimum-allocation–vcores

单个任务可申请的最小虚拟CPU个数,默认是1,如果一个任务申请的CPU个数少于该数,则该对应的值改为这个数。

yarn.scheduler.maximum-allocation–vcores

单个任务可申请的最多虚拟CPU个数,默认是4。这里说的cpu个数都是说的虚拟cpu,默认的是1个物理cpu=2个虚拟cpu。

②Memory资源调度

yarn一般允许用户配置每个节点上可用的物理资源,注意,这里是”可用的”,不是物理内存多少,就设置多少,因为一个服务器节点上会有若干的内存,一部分给yarn,一部分给hdfs,一部分给hbase。在yarn中,Memory相关的配置如下:

yarn.nodemanager.resource.memory–mb

设置该节点上yarn可使用的内存,默认为8G,如果节点内存资源不足8G,要减少这个值,yarn不会智能的去检测内存资源,一般这个设置yarn的可用内存资源

yarn.scheduler.minimum-allocation–mb

单个任务可申请的最小的内存大小,默认是1G,当内存不够时,会自动按照一定大小累加内存。

yarn.scheduler.maximum-allocation–mb

单个任务最大申请物理内存量,默认为8291MB

③示例

以hdp03-05(8C、8G)为例,

yarn.nodemanager.resource.cpu–vcores 虚拟core

这个参数根据自己生产服务器决定,比如服务器很富裕,那就直接1:1,设置成8,如果服务器不是很富裕,那就直接成1:2,设置成8,本次设置为16

yarn.nodemanager.resource.memory–mb 总内存

生产上一般要预留15-20%的内存,那么可用内存就是8*0.8=6.4G,本次设置为6G

yarn.scheduler.minimum-allocation–mb 单任务最小内存

如果设置成500M,那6/0.5 = 12,就是最多可以跑12个container

如果设置成1G,那6/1 = 6,就是最多可以跑6个container

本次设置为1G

yarn.scheduler.minimum-allocation-vcores 单任务最少vcore

如果设置vcore = 1,那么16/1 = 16,就是最多可以跑16个container,如果设置成这个,根据上面内存分配的情况,最多只能跑6个container,vcore有点浪费

如果设置vcore = 2,那么16/2 = 8,就是最多可以跑8个container

yarn.scheduler.maximum–allocation-vcores 单任务最多vcore

一般就设置成4个,cloudera公司做过性能测试,如果cpu大于等于5之后,cpu利用率反而不是很好(固定经验值)

yarn.scheduler.maximum–allocation–mb 单任务最大内存

这个要根据实际业务设定,如果有大任务