前言

在iphonex真机上运行,一种方法需要24ms一帧,CPU占用率85%,另一种需要17ms一帧,CPU占用率140%。下面就来详细说说。

方法一

转换思路是CVPixelBufferRef->UIImage->cv::Mat的路线。

先是CVPixelBufferRef->UIImage的方法

- (UIImage*)uiImageFromPixelBuffer:(CVPixelBufferRef)p {

CIImage* ciImage = [CIImage imageWithCVPixelBuffer : p];

CIContext* context = [CIContext contextWithOptions : @{kCIContextUseSoftwareRenderer : @(YES)}];

CGRect rect = CGRectMake(0, 0, CVPixelBufferGetWidth(p), CVPixelBufferGetHeight(p));

CGImageRef videoImage = [context createCGImage : ciImage fromRect : rect];

UIImage* image = [UIImage imageWithCGImage : videoImage];

CGImageRelease(videoImage);

return image;

}- (cv::Mat)cvMatFromUIImage:(UIImage *)image

{

CGColorSpaceRef colorSpace = CGImageGetColorSpace(image.CGImage);

CGFloat cols = image.size.width;

CGFloat rows = image.size.height;

cv::Mat cvMat(rows, cols, CV_8UC4); // 8 bits per component, 4 channels (color channels + alpha)

CGContextRef contextRef = CGBitmapContextCreate(cvMat.data, // Pointer to data

cols, // Width of bitmap

rows, // Height of bitmap

8, // Bits per component

cvMat.step[0], // Bytes per row

colorSpace, // Colorspace

kCGImageAlphaNoneSkipLast |

kCGBitmapByteOrderDefault); // Bitmap info flags

CGContextDrawImage(contextRef, CGRectMake(0, 0, cols, rows), image.CGImage);

CGContextRelease(contextRef);

return cvMat;

}方法二

转换思路是CVPixelBufferRef->YUV cv::Mat->RGB cv::Mat

先上方法

- (cv::Mat)cvMatFromPixelBuffer:(CVPixelBufferRef)p

{

CVPixelBufferLockBaseAddress(p, 0);

unsigned char *base = (unsigned char *)CVPixelBufferGetBaseAddress(p);

uint8_t *src_y = (unsigned char *)CVPixelBufferGetBaseAddressOfPlane(p, 0);

uint8_t *src_uv =(unsigned char *) CVPixelBufferGetBaseAddressOfPlane(p, 1);

int height = (int)CVPixelBufferGetHeight( p );

int width = (int)CVPixelBufferGetWidth(p);

cv::Mat yuvimg(height*3/2, width, CV_8UC1);

for(int i=0; i<height*width; i++){

*(yuvimg.data + i) = *(src_y + i);

}

int delta_h = height*3/2 - height;

for(int i=0; i<delta_h; i++){

for(int j=0; j<width; j++){

*(yuvimg.data + (height + i)*width + j) = *(src_uv + i*width + j);

}

}

//writeImage2Document("testim.jpg", yuvimg);

cv::Mat rgbimg(height, width, CV_8UC4);

cv::cvtColor(yuvimg, rgbimg, cv::COLOR_YUV2RGBA_NV21);

//CVPixelBufferRef testimg = [self getImageBufferFromMat:rgbimg];

CVPixelBufferUnlockBaseAddress( p, 0 );

return rgbimg;

}这种方法直接使用opencv来转换,速度会快一些, 但是CPU占用率高。

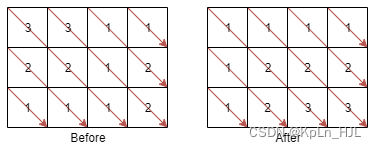

另外需要注意的是,YUV数据需要Y和UV分开写入到cv::Mat中,而不是直接获取CVPixelBufferGetBaseAddress的地址写入。我不知道为什么,直接取CVPixelBufferGetBaseAddress的地址的话,在起始地址会有一段乱码,然后导致整个画面右移。

收工~

超级好用的调试

前往应用市场

原文地址:https://blog.csdn.net/qq_19313495/article/details/127357984

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_35574.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。