这里省略了深层神经网络的前向传播和反向传播,内容和之前相似,不做过多描述。若今后需要,可以再补习。

一、为什么使用深层表示

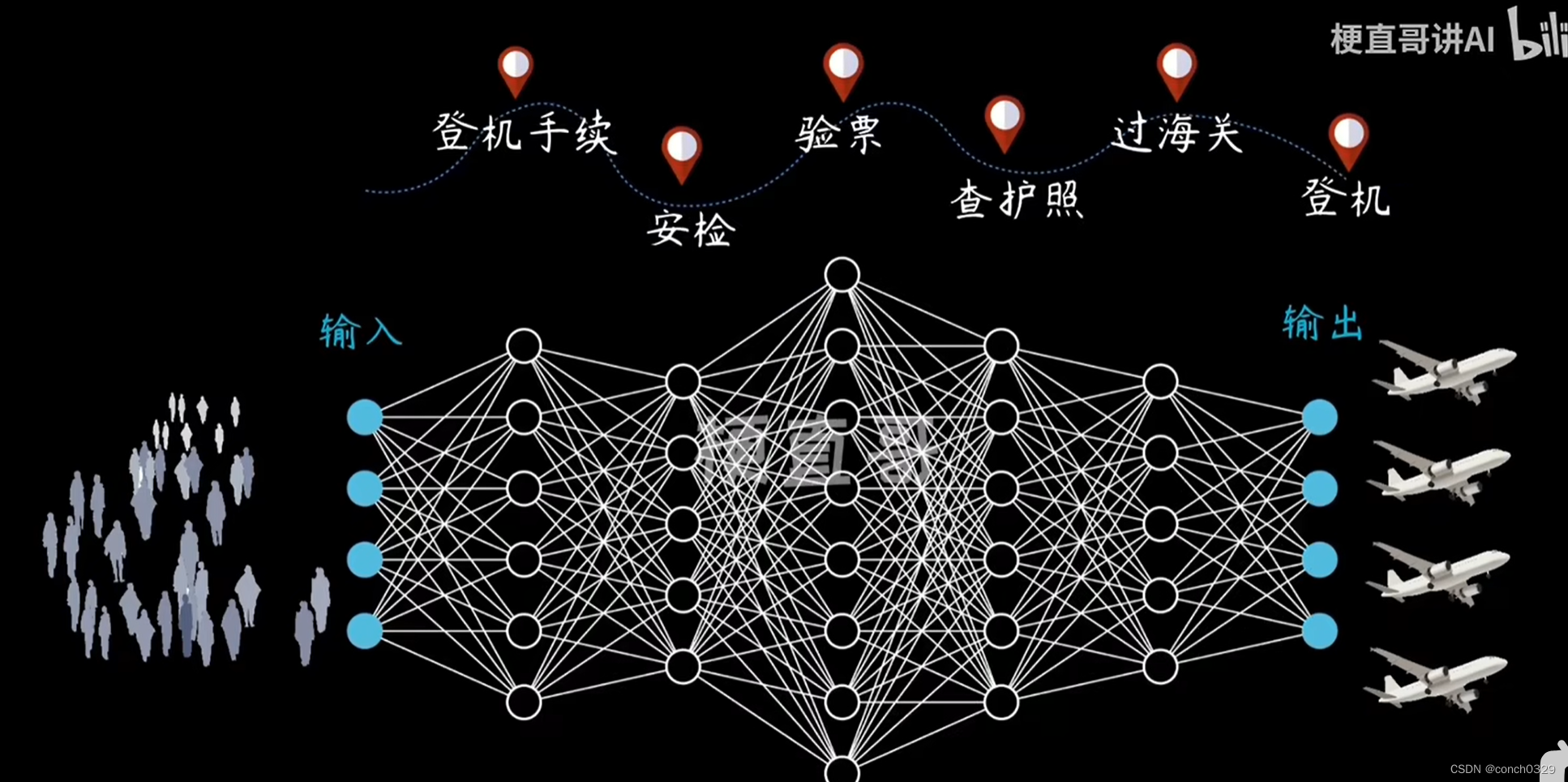

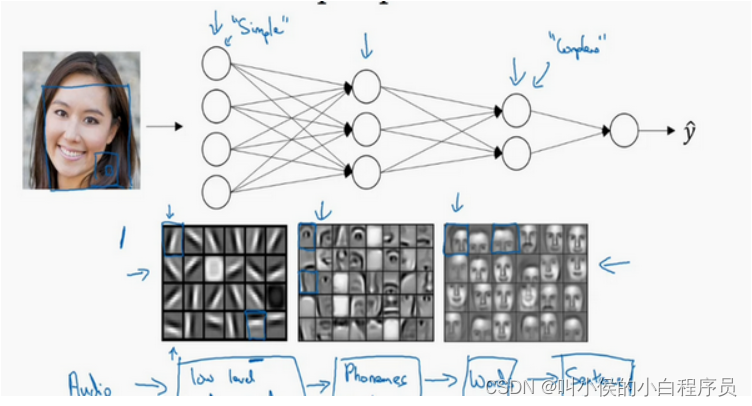

解决问题时其实并不需要很大的神经网络,但是得有深度,得有比较多的隐藏层。这是为什么呢?如下图,人脸识别神经网络所示:

当输入一张脸部的照片,你可以把深度神经网络的第一层,当成一个特征探测器或者边缘探测器。在这个例子里,我会在第一个隐藏层中建大概20个隐藏单元。隐藏单元就是这些图里这些小方块(第一个隐藏层可视化图),举个例子,这个小方块(第一行第一列)就是一个隐藏单元,它会去找这张照片里“|”边缘的方向。那么这个隐藏单元(第四行第四列),可能是在找(“—”)水平向的边缘。你可以先把神经网络的第一层当作看图,然后去找这张照片的各个边缘。我们可以把照片里组成边缘的像素放在一起看,然后它可以把被探测到的边缘组合成面部的不同部分(第二隐藏层可视图)。比如说,可能有一个神经元会去找眼睛的部分,另外还有别的在找鼻子的部分,然后把这许多的边缘结合在一起,就可以开始检测人脸的不同部分。最后再把这些部分放在一起,比如鼻子眼睛下巴,就可以识别或是探测不同的人脸(第三隐藏层的可视化图)。

你可以直觉上把这种神经网络的前几层当作探测简单的函数,比如边缘,之后把它们跟后几层结合在一起,那么总体上就能学习更多复杂的函数。这些图的意义,我们在学习卷积神经网络的时候再深入了解。还有一个技术性的细节需要理解的是,边缘探测器其实相对来说都是针对照片中非常小块的面积。面部探测器就会针对于大一些的区域。但是主要的概念是,一般你会从比较小的细节入手,比如边缘,然后再一步步到更大更复杂的区域,比如一只眼睛或是一个鼻子,再把眼睛鼻子装一块组成更复杂的部分。

1.1 深度神经网络的特点

1.2 深度神经网络的前向反向传播

二、参数和超参数

2.1 如何寻找超参数的最优值

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。