一、本文介绍

本篇文章给大家带来的是利用我个人编写的架构进行LSTM模型进行时间序列建模(专门为了时间序列领域新人编写的架构,简单且不同于市面上大家用GPT写的代码),包括结果可视化、支持单元预测、多元预测、模型拟合效果检测、预测未知数据、以及滚动长期预测功能。该结构是一个通用架构任何模型嵌入其中都可运行。在之前我已经将出过一个LSTM的讲解了,那个比较简单只能进行单元预测,所以在这里进行了一个补充这个模型框架可以满足所有的时间序列功能。

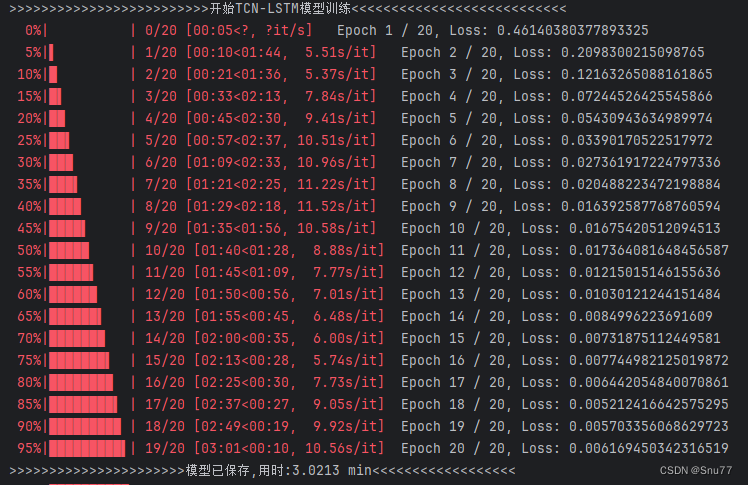

根据损失来看模型的拟合效果还是很好的,但后面还是做了检验模型拟合效果的功能让大家真正的评估模型的效果。

这里只展示了部分功能,代码中我还添加了许多可视化功能和结果生成功能。

二、LSTM的框架原理

LSTM(长短期记忆,Long Short-Term Memory)是一种用于处理序列数据的深度学习模型,属于循环神经网络(RNN)的一种变体,其使用一种类似于搭桥术结构的RNN单元。相对于普通的RNN,LSTM引入了门控机制,能够更有效地处理长期依赖和短期记忆问题,是RNN网络中最常使用的Cell之一。

2.1 LSTM的基础的结构

LSTM通过刻意的设计来实现学习序列关系的同时,又能够避免长期依赖的问题。它的结构示意图如下所示。

在LSTM的结构示意图中,每一条黑线传输着一整个向量,从一个节点的输出到其他节点的输入。其中“+”号代表着运算操作(如矢量的和),而矩形代表着学习到的神经网络层。汇合在一起的线表示向量的连接,分叉的线表示内容被复制,然后分发到不同的位置。

如果上面的LSTM结构图你看着很难理解,但是其实LSTM的本质就是一个带有tanh激活函数的简单RNN,如下图所示。

LSTM这种结构的原理是引入一个称为细胞状态的连接。这个状态细胞用来存放想要的记忆的东西(对应简单LSTM结构中的h,只不过这里面不再只保存上一次状态了,而是通过网络学习存放那些有用的状态),同时在加入三个门,分别是。

从字面上可以看出,由于三个门的操作,LSTM在状态的更新和状态是否要作为输入,全部交给了神经网络的训练机制来选择。

2.1.1 忘记门

下图所示为忘记门的操作,忘记门决定模型会从细胞状态中丢弃什么信息。

忘记门会读取前一序列模型的输出和当前模型的输入

来控制细胞状态中的每个数是否保留。

例如:在一个语言模型的例子中,假设细胞状态会包含当前主语的性别,于是根据这个状态便可以选择正确的代词。当我们看到新的主语时,应该把新的主语在记忆中更新。忘记们的功能就是先去记忆中找到一千那个旧的主语(并没有真正执行忘记的操作,只是找到而已。

在上图的LSTM的忘记门中,代表忘记门的输出, α代表激活函数,

代表忘记门的权重,

代表当前模型的输入,

代表前一个序列模型的输出,

代表忘记门的偏置。

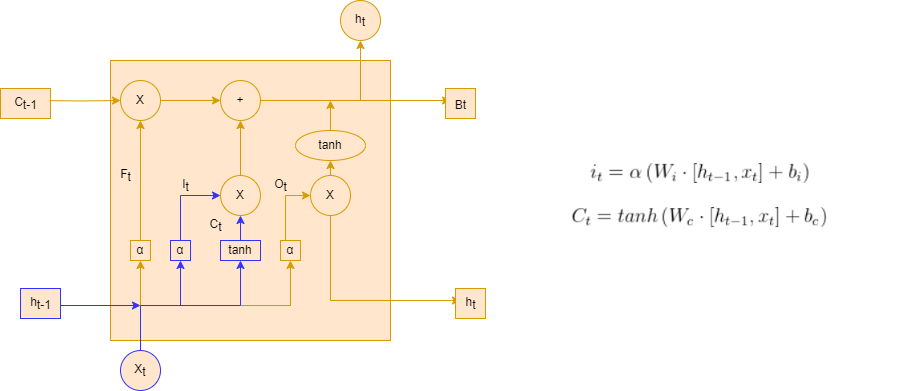

2.1.2 输入门

输入门可以分为两部分功能,一部分是找到那些需要更新的细胞状态。另一部分是把需要更新的信息更新到细胞状态里

在上面输入门的结构中,代表要更新的细胞状态,α代表激活函数,

代表当前模型的输入,

代表前一个序列模型的输出,

代表计算

的权重,

代表计算

的偏置,

代表使用tanh所创建的新细胞状态,

代表计算

的权重,

代表计算

的偏置。

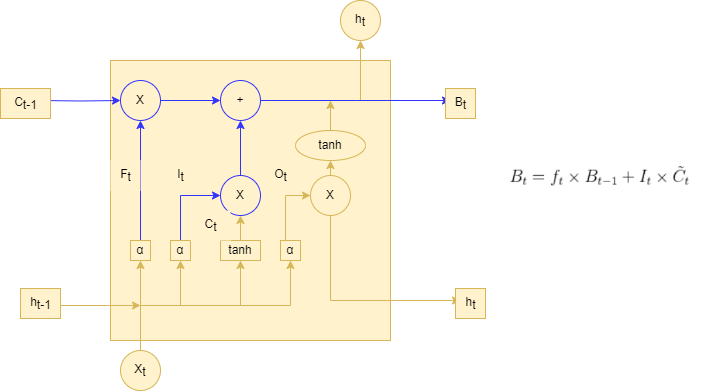

忘记门找到了需要忘掉的信息后,在将它与旧状态相乘,丢弃确定需要丢弃的信息。(如果需要丢弃对应位置权重设置为0),然后,将结果加上

*

使细胞状态获得新的信息。这样就完成了细胞状态的更新,如下图输入门的更新图所示。

再上图LSTM输入门的更新图中,代表忘记门的输出结果,

代表忘记门的输出结果,

代表前一个序列模型的细胞状态,

代表要更新的细胞状态,

代表使用tanh所创建的新细胞状态。

2.1.3 输出门

如下图LSTM的输出门结构图所示,在输出门中,通过一个激活函数层(实际使用的是Sigmoid激活函数)来确定哪个部分的信息将输出,接着把细胞状态通过tanh进行处理(得到一个在-1~1的值),并将它和Sigmoid门的输出相乘,得出最终想要输出的那个部分,例如,在语言模型中,假设已经输入了一个代词,便会计算出需要输出一个与该代词相关的信息(词向量)

在LSTM的输出门结构图中,代表要输出的信息,α代表激活函数,

代表计算

的权重,

代表计算

的偏置,

代表更新后的细胞状态,

代表当前序列模型的输出结果。

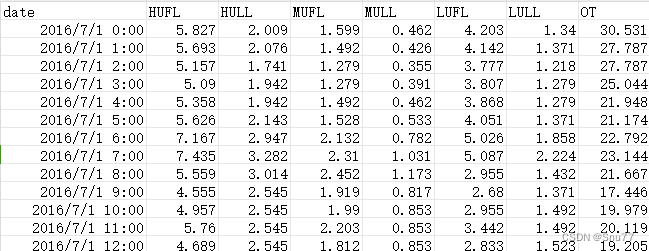

三、数据集介绍

本文是实战讲解文章,上面主要是简单讲解了一下网络结构比较具体的流程还是很复杂的涉及到很多的数学计算,下面我们来讲一讲模型的实战内容,第一部分是我利用的数据集。

本文我们用到的数据集是ETTh1.csv,该数据集是一个用于时间序列预测的电力负荷数据集,它是 ETTh 数据集系列中的一个。ETTh 数据集系列通常用于测试和评估时间序列预测模型。以下是 ETTh1.csv 数据集的一些内容:

数据内容:该数据集通常包含有关电力系统的多种变量,如电力负荷、价格、天气情况等。这些变量可以用于预测未来的电力需求或价格。

时间范围和分辨率:数据通常按小时或天记录,涵盖了数月或数年的时间跨度。具体的时间范围和分辨率可能会根据数据集的版本而异。

四、参数讲解

parser.add_argument('-model', type=str, default='TCN-LSTM', help="模型持续更新")

parser.add_argument('-window_size', type=int, default=126, help="时间窗口大小, window_size > pre_len")

parser.add_argument('-pre_len', type=int, default=24, help="预测未来数据长度")

# data

parser.add_argument('-shuffle', action='store_true', default=True, help="是否打乱数据加载器中的数据顺序")

parser.add_argument('-data_path', type=str, default='ETTh1-Test.csv', help="你的数据数据地址")

parser.add_argument('-target', type=str, default='OT', help='你需要预测的特征列,这个值会最后保存在csv文件里')

parser.add_argument('-input_size', type=int, default=7, help='你的特征个数不算时间那一列')

parser.add_argument('-feature', type=str, default='M', help='[M, S, MS],多元预测多元,单元预测单元,多元预测单元')

# learning

parser.add_argument('-lr', type=float, default=0.001, help="学习率")

parser.add_argument('-drop_out', type=float, default=0.05, help="随机丢弃概率,防止过拟合")

parser.add_argument('-epochs', type=int, default=20, help="训练轮次")

parser.add_argument('-batch_size', type=int, default=16, help="批次大小")

parser.add_argument('-save_path', type=str, default='models')

# model

parser.add_argument('-hidden_size', type=int, default=64, help="隐藏层单元数")

parser.add_argument('-kernel_sizes', type=int, default=3)

parser.add_argument('-laryer_num', type=int, default=2)

# device

parser.add_argument('-use_gpu', type=bool, default=True)

parser.add_argument('-device', type=int, default=0, help="只设置最多支持单个gpu训练")

# option

parser.add_argument('-train', type=bool, default=True)

parser.add_argument('-test', type=bool, default=True)

parser.add_argument('-predict', type=bool, default=True)

parser.add_argument('-inspect_fit', type=bool, default=True)

parser.add_argument('-lr-scheduler', type=bool, default=True)为了大家方便理解,文章中的参数设置我都用的中文,所以大家应该能够更好的理解。下面我在进行一遍讲解。

| 参数名称 | 参数类型 | 参数讲解 | |

|---|---|---|---|

| 1 | model | str | 模型名称 |

| 2 | window_size | int | 时间窗口大小,用多少条数据去预测未来的数据 |

|

3 |

pre_len | int | 预测多少条未来的数据 |

| 4 | shuffle | store_true | 是否打乱输入dataloader中的数据,不是数据的顺序 |

|

5 |

data_path | str | 你输入数据的地址 |

| 6 | target | str | 你想要预测的特征列 |

|

7 |

input_size | int | 输入的特征数不包含时间那一列!!! |

|

8 |

feature | str | [M, S, MS],多元预测多元,单元预测单元,多元预测单元 |

| 9 | lr | float | 学习率大小 |

|

10 |

float | 丢弃概率 | |

| 11 | epochs | int | 训练轮次 |

|

12 |

batch_size | int | 批次大小 |

| 13 | svae_path | str | 模型的保存路径 |

|

14 |

hidden_size | int | 隐藏层大小 |

| 15 | kernel_size | int | 卷积核大小 |

|

16 |

layer_num | int | lstm层数 |

| 17 | use_gpu | bool | 是否使用GPU |

|

18 |

device | int | GPU编号 |

| 19 | train | bool | 是否进行训练 |

|

20 |

predict | bool | 是否进行预测 |

|

21 |

inspect_fit | bool | 是否进行检验模型 |

| 22 | lr_schduler | bool | 是否使用学习率计划 |

五、完整运行代码

复制粘贴到一个文件下并且按照上面的从参数讲解配置好参数即可运行~(极其适合新手和刚入门的读者)

import argparse

import time

import numpy as np

import pandas as pd

from matplotlib import pyplot as plt

from sklearn.preprocessing import StandardScaler, MinMaxScaler

from torch.utils.data import DataLoader

from torch.utils.data import Dataset

from tqdm import tqdm

import torch

import torch.nn as nn

from torch.nn.utils import weight_norm

# 随机数种子

np.random.seed(0)

def plot_loss_data(data):

# 使用Matplotlib绘制线图

plt.figure()

plt.plot(data, marker='o')

# 添加标题

plt.title("loss results Plot")

# 显示图例

plt.legend(["Loss"])

plt.show()

class TimeSeriesDataset(Dataset):

def __init__(self, sequences):

self.sequences = sequences

def __len__(self):

return len(self.sequences)

def __getitem__(self, index):

sequence, label = self.sequences[index]

return torch.Tensor(sequence), torch.Tensor(label)

def create_inout_sequences(input_data, tw, pre_len, config):

# 创建时间序列数据专用的数据分割器

inout_seq = []

L = len(input_data)

for i in range(L - tw):

train_seq = input_data[i:i + tw]

if (i + tw + pre_len) > len(input_data):

break

if config.feature == 'MS':

train_label = input_data[:, -1:][i + tw:i + tw + pre_len]

else:

train_label = input_data[i + tw:i + tw + pre_len]

inout_seq.append((train_seq, train_label))

return inout_seq

def calculate_mae(y_true, y_pred):

# 平均绝对误差

mae = np.mean(np.abs(y_true - y_pred))

return mae

def create_dataloader(config, device):

print(">>>>>>>>>>>>>>>>>>>>>>>>>>>>创建数据加载器<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<")

df = pd.read_csv(config.data_path) # 填你自己的数据地址,自动选取你最后一列数据为特征列 # 添加你想要预测的特征列

pre_len = config.pre_len # 预测未来数据的长度

train_window = config.window_size # 观测窗口

# 将特征列移到末尾

target_data = df[[config.target]]

df = df.drop(config.target, axis=1)

df = pd.concat((df, target_data), axis=1)

cols_data = df.columns[1:]

df_data = df[cols_data]

# 这里加一些数据的预处理, 最后需要的格式是pd.series

true_data = df_data.values

# 定义标准化优化器

scaler_train = StandardScaler()

scaler_valid = StandardScaler()

scaler_test = StandardScaler()

train_data = true_data[:int(1 * len(true_data))]

valid_data = true_data[int(0.80 * len(true_data)):int(0.85 * len(true_data))]

test_data = true_data[int(0.85 * len(true_data)):]

print("训练集尺寸:", len(train_data), "测试集尺寸:", len(test_data), "验证集尺寸:", len(valid_data))

# 进行标准化处理

train_data_normalized = scaler_train.fit_transform(train_data)

test_data_normalized = scaler_test.fit_transform(test_data)

valid_data_normalized = scaler_valid.fit_transform(valid_data)

# 转化为深度学习模型需要的类型Tensor

train_data_normalized = torch.FloatTensor(train_data_normalized).to(device)

test_data_normalized = torch.FloatTensor(test_data_normalized).to(device)

valid_data_normalized = torch.FloatTensor(valid_data_normalized).to(device)

# 定义训练器的的输入

train_inout_seq = create_inout_sequences(train_data_normalized, train_window, pre_len, config)

test_inout_seq = create_inout_sequences(test_data_normalized, train_window, pre_len, config)

valid_inout_seq = create_inout_sequences(valid_data_normalized, train_window, pre_len, config)

# 创建数据集

train_dataset = TimeSeriesDataset(train_inout_seq)

test_dataset = TimeSeriesDataset(test_inout_seq)

valid_dataset = TimeSeriesDataset(valid_inout_seq)

# 创建 DataLoader

train_loader = DataLoader(train_dataset, batch_size=args.batch_size, shuffle=True, drop_last=True)

test_loader = DataLoader(test_dataset, batch_size=args.batch_size, shuffle=False, drop_last=True)

valid_loader = DataLoader(valid_dataset, batch_size=args.batch_size, shuffle=False, drop_last=True)

print("通过滑动窗口共有训练集数据:", len(train_inout_seq), "转化为批次数据:", len(train_loader))

print("通过滑动窗口共有测试集数据:", len(test_inout_seq), "转化为批次数据:", len(test_loader))

print("通过滑动窗口共有验证集数据:", len(valid_inout_seq), "转化为批次数据:", len(valid_loader))

print(">>>>>>>>>>>>>>>>>>>>>>>>>>>>创建数据加载器完成<<<<<<<<<<<<<<<<<<<<<<<<<<<")

return train_loader, test_loader, valid_loader, scaler_train, scaler_test, scaler_valid

class LSTM(nn.Module):

def __init__(self, input_size, output_size, pre_len, hidden_size, n_layers, dropout=0.05):

super(LSTM, self).__init__()

self.pre_len = pre_len

self.n_layers = n_layers

self.hidden_size = hidden_size

self.hidden = nn.Linear(input_size, self.hidden_size)

self.relu = nn.ReLU()

self.lstm = nn.LSTM(self.hidden_size, self.hidden_size, n_layers, bias=True, batch_first=True) # output (batch_size, obs_len, hidden_size)

self.linear = nn.Linear(self.hidden_size, output_size)

def forward(self, x):

batch_size, obs_len, features_size = x.shape # (batch_size, obs_len, features_size)

xconcat = self.hidden(x) # (batch_size, obs_len, hidden_size)

H = torch.zeros(batch_size, obs_len - 1, self.hidden_size).to(device) # (batch_size, obs_len-1, hidden_size)

ht = torch.zeros(self.n_layers, batch_size, self.hidden_size).to(

device) # (num_layers, batch_size, hidden_size)

ct = ht.clone()

for t in range(obs_len):

xt = xconcat[:, t, :].view(batch_size, 1, -1) # (batch_size, 1, hidden_size)

out, (ht, ct) = self.lstm(xt, (ht, ct)) # ht size (num_layers, batch_size, hidden_size)

htt = ht[-1, :, :] # (batch_size, hidden_size)

if t != obs_len - 1:

H[:, t, :] = htt

H = self.relu(H) # (batch_size, obs_len-1, hidden_size)

x = self.linear(H)

return x[:, -self.pre_len:, :]

def train(model, args, device):

start_time = time.time() # 计算起始时间

model = model

loss_function = nn.MSELoss()

optimizer = torch.optim.Adam(model.parameters(), lr=0.005)

epochs = args.epochs

model.train() # 训练模式

results_loss = []

for i in tqdm(range(epochs)):

losss = []

for seq, labels in train_loader:

optimizer.zero_grad()

y_pred = model(seq)

single_loss = loss_function(y_pred, labels)

single_loss.backward()

optimizer.step()

losss.append(single_loss.detach().cpu().numpy())

tqdm.write(f"t Epoch {i + 1} / {epochs}, Loss: {sum(losss) / len(losss)}")

results_loss.append(sum(losss) / len(losss))

save_loss = []

if save_loss:

valid_loss = valid(model, args, scaler_valid, valid_loader)

# 尚未引入学习率计划后期补上

torch.save(model.state_dict(), 'save_model.pth')

time.sleep(0.1)

# 保存模型

print(f">>>>>>>>>>>>>>>>>>>>>>模型已保存,用时:{(time.time() - start_time) / 60:.4f} min<<<<<<<<<<<<<<<<<<")

plot_loss_data(results_loss)

return scaler_train

def valid(model, args, scaler, valid_loader):

lstm_model = model

# 加载模型进行预测

lstm_model.load_state_dict(torch.load('save_model.pth'))

lstm_model.eval() # 评估模式

losss = []

for seq, labels in valid_loader:

pred = lstm_model(seq)

mae = calculate_mae(pred.detach().numpy().cpu(), np.array(labels.detach().cpu())) # MAE误差计算绝对值(预测值 - 真实值)

losss.append(mae)

# print("验证集误差MAE:", losss)

return sum(losss)/len(losss)

def test(model, args, scaler, test_loader):

# 加载模型进行预测

losss = []

df = pd.read_csv(args.data_path)

df_inverse = df[int(0.85 * len(df)):][[args.target]].reset_index(drop=True)

scaler_pre = StandardScaler().fit(df_inverse)

model = model

model.load_state_dict(torch.load('save_model.pth'))

model.eval() # 评估模式

results = []

labels = []

for seq, label in test_loader:

pred = model(seq)

mae = calculate_mae(pred.detach().cpu().numpy(),

np.array(label.detach().cpu())) # MAE误差计算绝对值(预测值 - 真实值)

losss.append(mae)

pred = pred[:, 0, :]

label = label[:, 0, :]

if args.feature == 'M' or args.feature == 'S':

pred = scaler_train.inverse_transform(pred.detach().cpu().numpy())

label = scaler_train.inverse_transform(label.detach().cpu().numpy())

else:

pred = scaler_pre.inverse_transform(pred.detach().cpu().numpy())

label = scaler_pre.inverse_transform(label.detach().cpu().numpy())

for i in range(len(pred)):

results.append(pred[i][-1])

labels.append(label[i][-1])

print("测试集误差MAE:", losss)

# 绘制历史数据

plt.plot(labels, label='TrueValue')

# 绘制预测数据

# 注意这里预测数据的起始x坐标是历史数据的最后一个点的x坐标

plt.plot(results, label='Prediction')

# 添加标题和图例

plt.title("test state")

plt.legend()

plt.show()

# 检验模型拟合情况

def inspect_model_fit(model, args, train_loader, scaler_train):

df = pd.read_csv(args.data_path)

df_inverse = df[:int(0.85 * len(df))][[args.target]].reset_index(drop=True)

scaler_pre = StandardScaler().fit(df_inverse)

model = model

model.load_state_dict(torch.load('save_model.pth'))

model.eval() # 评估模式

results = []

labels = []

for seq, label in train_loader:

pred = model(seq)[:, 0, :]

label = label[:, 0, :]

if args.feature == 'M' or args.feature == 'S':

pred = scaler_train.inverse_transform(pred.detach().cpu().numpy())

label = scaler_train.inverse_transform(label.detach().cpu().numpy())

else:

pred = scaler_pre.inverse_transform(pred.detach().cpu().numpy())

label = scaler_pre.inverse_transform(label.detach().cpu().numpy())

for i in range(len(pred)):

results.append(pred[i][-1])

labels.append(label[i][-1])

# 绘制历史数据

plt.plot(labels, label='History')

# 绘制预测数据

# 注意这里预测数据的起始x坐标是历史数据的最后一个点的x坐标

plt.plot(results, label='Prediction')

# 添加标题和图例

plt.title("inspect model fit state")

plt.legend()

plt.show()

def predict(model, args, device, scaler):

# 预测未知数据的功能

df = pd.read_csv(args.data_path)

scaler_data = df[[args.target]][int(0.3 * len(df)):]

scaler_pre = StandardScaler().fit(scaler_data)

df = df.iloc[:, 1:][-args.window_size:].values # 转换为nadarry

pre_data = scaler.transform(df)

tensor_pred = torch.FloatTensor(pre_data).to(device)

tensor_pred = tensor_pred.unsqueeze(0) # 单次预测 , 滚动预测功能暂未开发后期补上

model = model

model.load_state_dict(torch.load('save_model.pth'))

model.eval() # 评估模式

pred = model(tensor_pred)[0]

if args.feature == 'M' or args.feature == 'S':

pred = scaler.inverse_transform(pred.detach().cpu().numpy())

else:

pred = scaler_pre.inverse_transform(pred.detach().cpu().numpy())

# 假设 df 和 pred 是你的历史和预测数据

# 计算历史数据的长度

history_length = len(df[:, -1])

# 为历史数据生成x轴坐标

history_x = range(history_length)

# 为预测数据生成x轴坐标

# 开始于历史数据的最后一个点的x坐标

prediction_x = range(history_length - 1, history_length + len(pred[:, -1]) - 1)

# 绘制历史数据

plt.plot(history_x, df[:, -1], label='History')

# 绘制预测数据

# 注意这里预测数据的起始x坐标是历史数据的最后一个点的x坐标

plt.plot(prediction_x, pred[:, -1], label='Prediction')

plt.axvline(history_length - 1, color='red') # 在图像的x位置处画一条红色竖线

# 添加标题和图例

plt.title("History and Prediction")

plt.legend()

if __name__ == '__main__':

parser = argparse.ArgumentParser(description='Time Series forecast')

parser.add_argument('-model', type=str, default='TCN-LSTM', help="模型持续更新")

parser.add_argument('-window_size', type=int, default=126, help="时间窗口大小, window_size > pre_len")

parser.add_argument('-pre_len', type=int, default=24, help="预测未来数据长度")

# data

parser.add_argument('-shuffle', action='store_true', default=True, help="是否打乱数据加载器中的数据顺序")

parser.add_argument('-data_path', type=str, default='ETTh1-Test.csv', help="你的数据数据地址")

parser.add_argument('-target', type=str, default='OT', help='你需要预测的特征列,这个值会最后保存在csv文件里')

parser.add_argument('-input_size', type=int, default=7, help='你的特征个数不算时间那一列')

parser.add_argument('-feature', type=str, default='M', help='[M, S, MS],多元预测多元,单元预测单元,多元预测单元')

# learning

parser.add_argument('-lr', type=float, default=0.001, help="学习率")

parser.add_argument('-drop_out', type=float, default=0.05, help="随机丢弃概率,防止过拟合")

parser.add_argument('-epochs', type=int, default=20, help="训练轮次")

parser.add_argument('-batch_size', type=int, default=16, help="批次大小")

parser.add_argument('-save_path', type=str, default='models')

# model

parser.add_argument('-hidden_size', type=int, default=64, help="隐藏层单元数")

parser.add_argument('-kernel_sizes', type=int, default=3)

parser.add_argument('-laryer_num', type=int, default=2)

# device

parser.add_argument('-use_gpu', type=bool, default=True)

parser.add_argument('-device', type=int, default=0, help="只设置最多支持单个gpu训练")

# option

parser.add_argument('-train', type=bool, default=True)

parser.add_argument('-test', type=bool, default=True)

parser.add_argument('-predict', type=bool, default=True)

parser.add_argument('-inspect_fit', type=bool, default=True)

parser.add_argument('-lr-scheduler', type=bool, default=True)

args = parser.parse_args()

if isinstance(args.device, int) and args.use_gpu:

device = torch.device("cuda:" + f'{args.device}')

else:

device = torch.device("cpu")

print("使用设备:", device)

train_loader, test_loader, valid_loader, scaler_train, scaler_test, scaler_valid = create_dataloader(args, device)

if args.feature == 'MS' or args.feature == 'S':

args.output_size = 1

else:

args.output_size = args.input_size

# 实例化模型

try:

print(f">>>>>>>>>>>>>>>>>>>>>>>>>开始初始化{args.model}模型<<<<<<<<<<<<<<<<<<<<<<<<<<<")

model = LSTM(args.input_size, args.output_size, args.pre_len, args.hidden_size , args.laryer_num, args.drop_out).to(device)

print(f">>>>>>>>>>>>>>>>>>>>>>>>>开始初始化{args.model}模型成功<<<<<<<<<<<<<<<<<<<<<<<<<<<")

except:

print(f">>>>>>>>>>>>>>>>>>>>>>>>>开始初始化{args.model}模型失败<<<<<<<<<<<<<<<<<<<<<<<<<<<")

# 训练模型

if args.train:

print(f">>>>>>>>>>>>>>>>>>>>>>>>>开始{args.model}模型训练<<<<<<<<<<<<<<<<<<<<<<<<<<<")

train(model, args, device)

if args.test:

print(f">>>>>>>>>>>>>>>>>>>>>>>>>开始{args.model}模型测试<<<<<<<<<<<<<<<<<<<<<<<<<<<")

test(model, args, scaler_test, test_loader)

if args.inspect_fit:

print(f">>>>>>>>>>>>>>>>>>>>>>>>>开始检验{args.model}模型拟合情况<<<<<<<<<<<<<<<<<<<<<<<<<<<")

inspect_model_fit(model, args, train_loader, scaler_train)

if args.predict:

print(f">>>>>>>>>>>>>>>>>>>>>>>>>预测未来{args.pre_len}条数据<<<<<<<<<<<<<<<<<<<<<<<<<<<")

predict(model, args, device, scaler_train)

plt.show()六、训练模型

我们配置好所有参数之后就可以开始训练模型了,根据我前面讲解的参数部分进行配置,不懂得可以评论区留言。

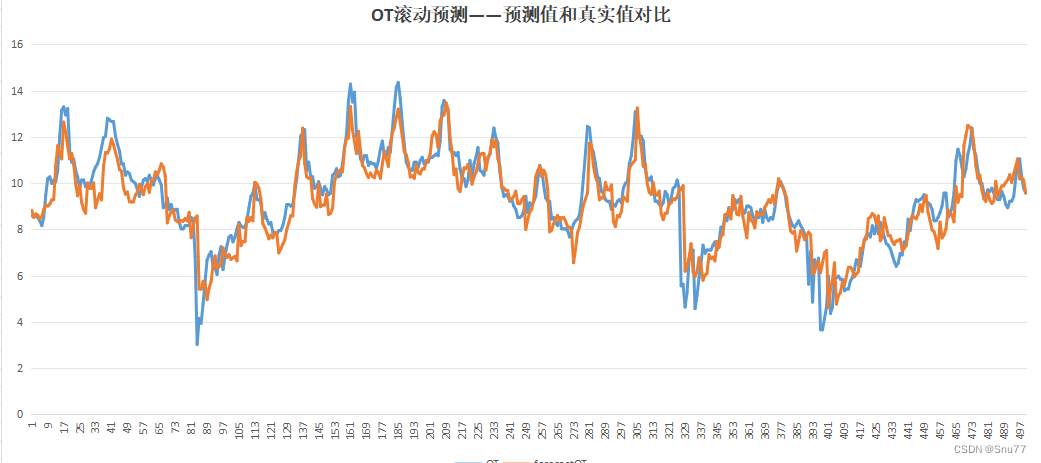

七、预测结果

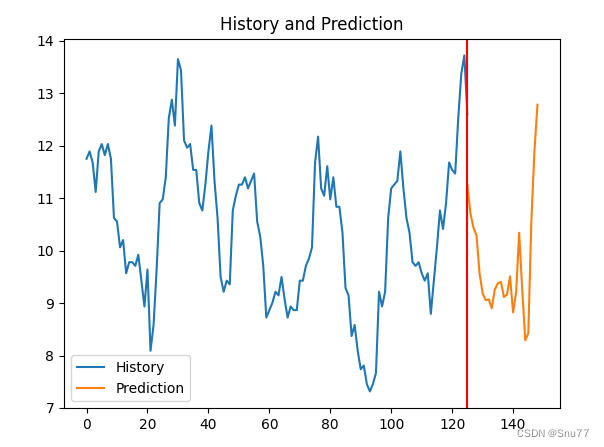

7.1 预测未知数据效果图

LSTM的预测效果图(这里我只预测了未来24个时间段的值为未来一天的预测值,个人觉得LSTM的极限就在20左右)->

7.2 测试集效果图

测试集上的表现->

可以看出测试集上的表现还可以,毕竟只有一个LSTM没有加入任何其它的机制,LSTM作为最经典的时间序列预测模型效果还是可圈可点的。

7.3 CSV文件生成效果图

同时我也可以将输出结果用csv文件保存,但是功能还没有做,我在另一篇informer的文章里实习了这个功能大家如果有需要可以评论区留言,有时间我会移植过来。

另一篇文章链接->时间序列预测实战(十九)魔改Informer模型进行滚动长期预测(科研版本,结果可视化)

7.4 检验模型拟合效果图

检验模型拟合情况->

(从下面的图片可以看出模型拟合的情况很好)

八、全文总结

到此本文的正式分享内容就结束了,在这里给大家推荐我的时间序列专栏,本专栏目前为新开的平均质量分98分,后期我会根据各种最新的前沿顶会进行论文复现,也会对一些老的模型进行补充,目前本专栏免费阅读(暂时,大家尽早关注不迷路~),如果大家觉得本文帮助到你了,订阅本专栏,关注后续更多的更新~

如果大家有不懂的也可以评论区留言一些报错什么的大家可以讨论讨论看到我也会给大家解答如何解决!最后希望大家工作顺利学业有成!

原文地址:https://blog.csdn.net/java1314777/article/details/134723886

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_39852.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!