目录

Part.01 关于HDP

Part.02 核心组件原理

Part.03 资源规划

Part.04 基础环境配置

Part.05 Yum源配置

Part.06 安装OracleJDK

Part.07 安装MySQL

Part.08 部署Ambari集群

Part.09 安装OpenLDAP

Part.10 创建集群

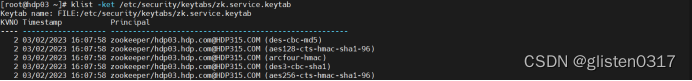

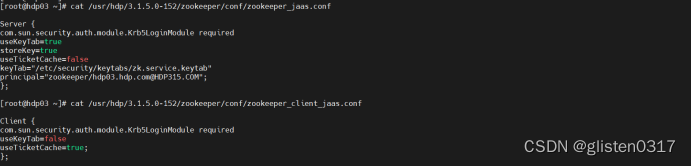

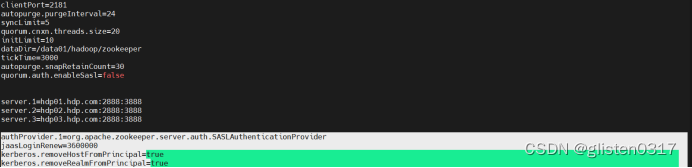

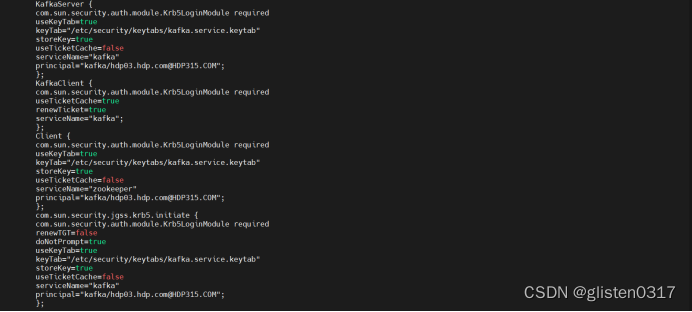

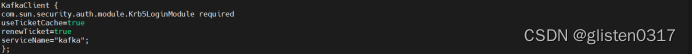

Part.11 安装Kerberos

Part.12 安装HDFS

Part.13 安装Ranger

Part.14 安装YARN+MR

Part.15 安装HIVE

Part.16 安装HBase

Part.17 安装Spark2

Part.18 安装Flink

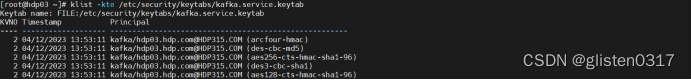

Part.19 安装Kafka

Part.20 安装Flume

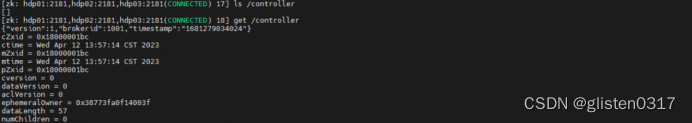

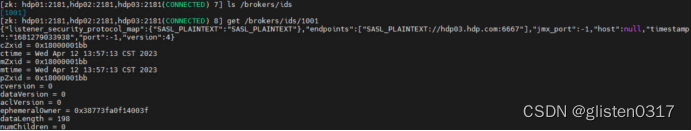

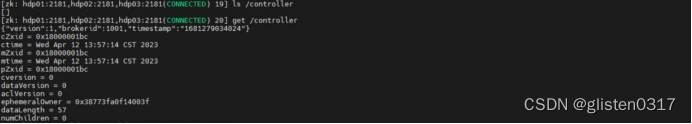

十九、安装Kafka

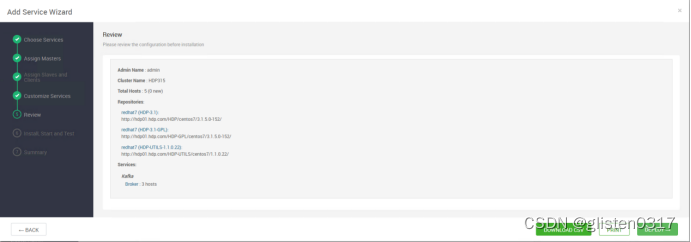

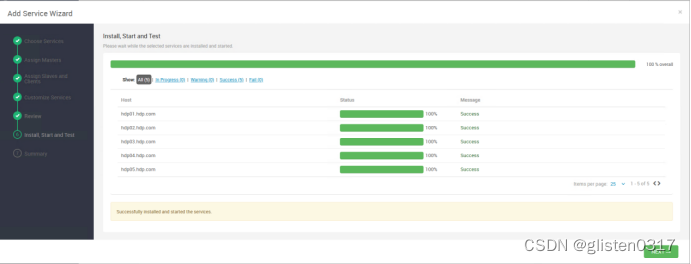

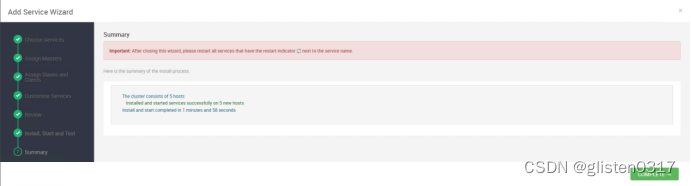

1.安装kafka

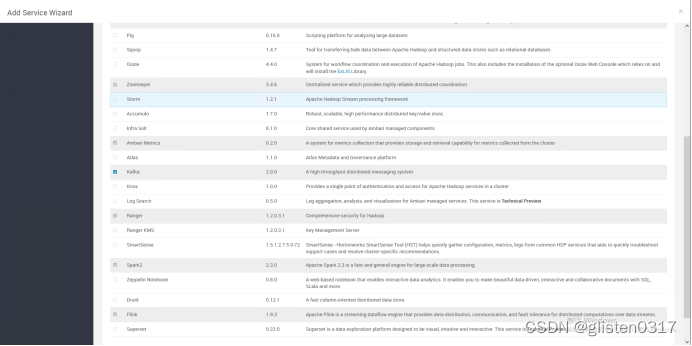

选择kafka进行安装

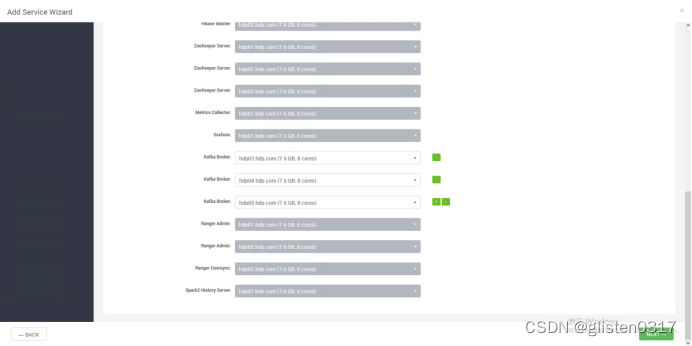

选择hdp03-05作为kafka的broker

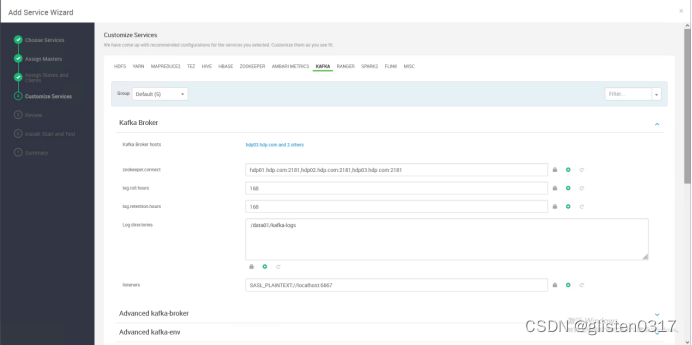

Log directories:/data01/kafka–logs

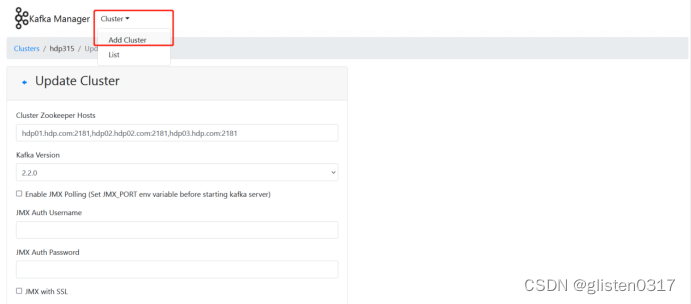

2.安装kafka manager

下载链接:

https://gitcode.net/mirrors/yahoo/kafka-manager/-/archive/master/kafka-manager-master.tar.gz

在具有sbt编译环境的服务器(需要外网环境)上,对kafka–manager进行编译

修改配置文件,/usr/local/kafka–manager-2.0.0.2/conf/application.conf

修改zookeeper连接地址

访问页面http://hdp01.hdp.com:9000

创建kafka集群

Cluster Name:hdp315,自定义名称

Cluster Zookeeper Hosts:hdp01.hdp.com:2181,hdp02.hdp02.com:2181,hdp03.hdp.com:2181