本文介绍: 开放词汇检测旨在检测那些未出现在预定词汇中的目标,类似的任务有视觉定位 Visual Grounding (VG)。然而当前的基础模型虽然在很多视觉语言任务上表现很好,但是在开放视觉定位 open–vocabulary visual grounding (OV-VG) 上还没有拿得出手的工作。

1j∈Oi+∑−log(∑k=0N−1exp(tiTok/τ)exp(tiToj/τ))其中

τ

tau

L

=

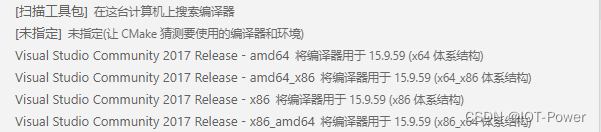

F、实施细节

六、实验

A、消融研究

B、数据泄露

C、数据集分析及错误案例

D、可视化实验

七、结论

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。

![C语言通过MSXML6.0读写XML文件(同时支持char[]和wchar_t[]字符数组)](https://img-blog.csdnimg.cn/direct/6962b989ee7f4a3f88eb0dc6a4905ffa.png)