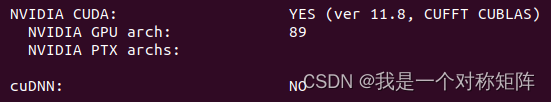

本文介绍: 在这个例子中,我们首先定义了神经网络模型,然后将其移动到可用的GPU设备上。在这个例子中,我们将损失函数torch.nn.CrossEntropyLoss移动到可用的CUDA设备上,方法是添加.to(device)。这样,当我们使用该损失函数计算损失值时,PyTorch会在GPU设备上执行相应的计算,从而进一步提高效率。CUDA可以用于在torch神经网络中进行GPU加速计算,包括模型的训练和推理过程。需要注意的是,在使用CUDA进行GPU加速时,我们需要将模型的所有参数和输入数据都移动到GPU设备上。

简言之,3部分:

1、数据data可以放在GPU上

2、网络net可以放在GPU上

3、损失函数loss可以放在GPU上

CUDA可以用于在torch神经网络中进行GPU加速计算,包括模型的训练和推理过程。具体来说,可以使用CUDA加速以下操作:

以下是一个简单的PyTorch神经网络示例,其中包括使用CUDA加速的代码:

在这个例子中,我们首先定义了神经网络模型,然后将其移动到可用的GPU设备上。接下来是训练过程,训练时我们从数据加载器中读取数据,并使用CUDA加速输入数据和标签张量的计算。最后,我们使用优化器来更新模型参数,并在每个epoch的末尾打印出损失值。

需要注意的是,在使用CUDA进行GPU加速时,我们需要将模型的所有参数和输入数据都移动到GPU设备上。

将损失函数也移动到CUDA设备上可以进一步提高计算效率。以下是修改后的代码示例:

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。