本文介绍: 然而,由于RLHF方法的一些局限性,制定一套人工标准准则来确保其安全、可靠和有效地应用变得至关重要。这些准则可以帮助研究人员和开发者更好地理解、改进和应用RLHF方法,以降低潜在的风险和负面影响。总之,大语言模型的评价涉及多个方面,需要综合考虑其在语言理解、生成、逻辑推理、常识应用、语言风格、情感表达、跨语言和跨领域等方面的表现,以及模型的大小、计算效率和伦理道德方面的问题。遵循这些人工标准准则,研究人员和开发者可以更安全、可靠地应用RLHF方法,以促进人工智能技术的发展和普及。

LLM

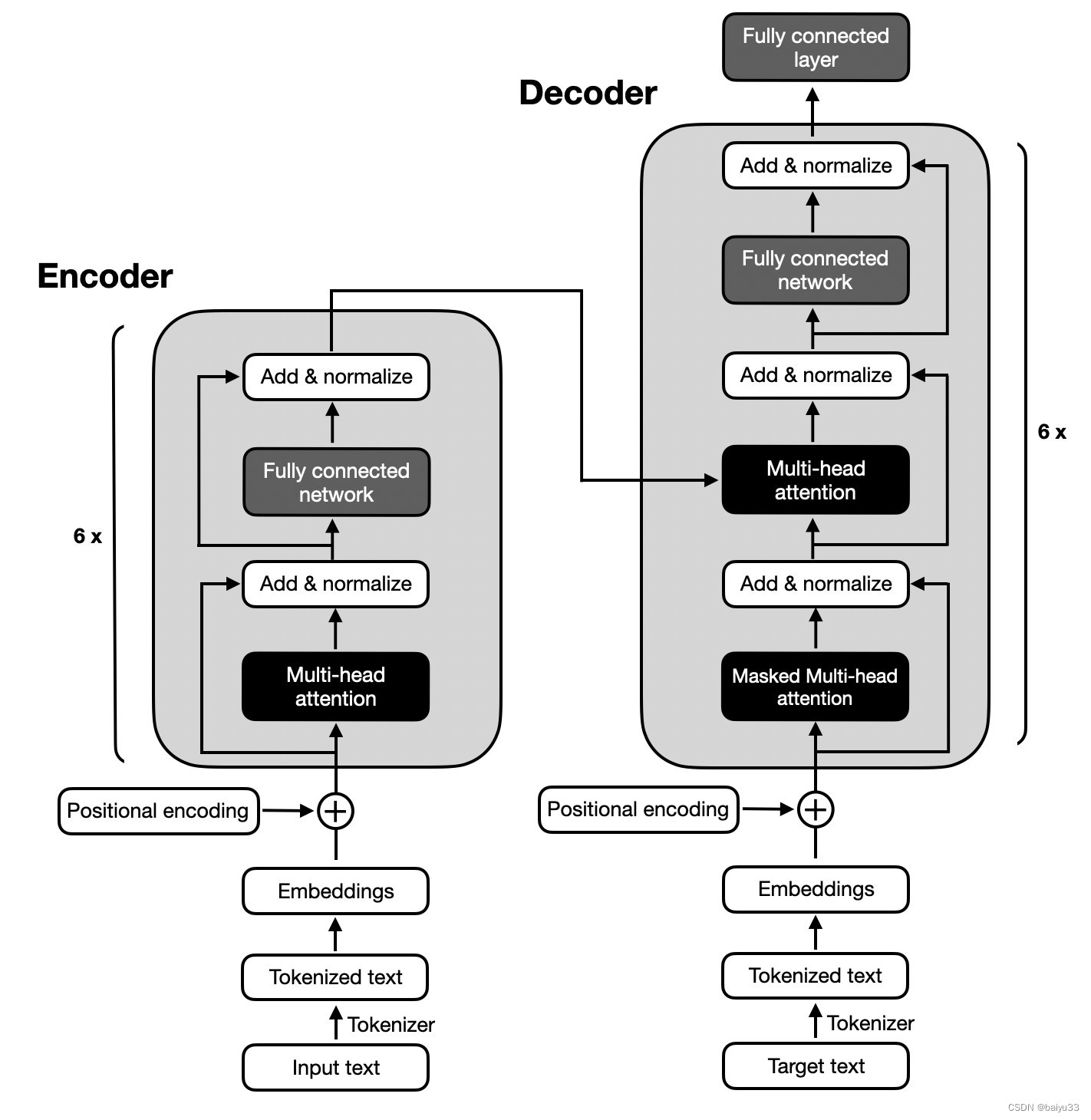

大语言模型(Large Language Model,LLM)是一种利用大量文本数据进行训练的自然语言处理模型,其评价可以从多个方面进行。

以下是一些主要的评价方面:

优点:

缺点:

总之,大语言模型的评价涉及多个方面,需要综合考虑其在语言理解、生成、逻辑推理、常识应用、语言风格、情感表达、跨语言和跨领域等方面的表现,以及模型的大小、计算效率和伦理道德方面的问题。通过综合评估这些方面,可以更好地了解大语言模型的性能和潜在应用价值。

RLHF

RLHF(Reinforcement Learning from Human Feedback)是一种通过人类反馈来训练人工智能模型的方法,旨在使模型与人类的价值观和对齐。然而,由于RLHF方法的一些局限性,制定一套人工标准准则来确保其安全、可靠和有效地应用变得至关重要。这些准则可以帮助研究人员和开发者更好地理解、改进和应用RLHF方法,以降低潜在的风险和负面影响。

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。