(一)ELK

1、elk:是一套完整的日志集中处理方案,由三个开源的软件简称组成

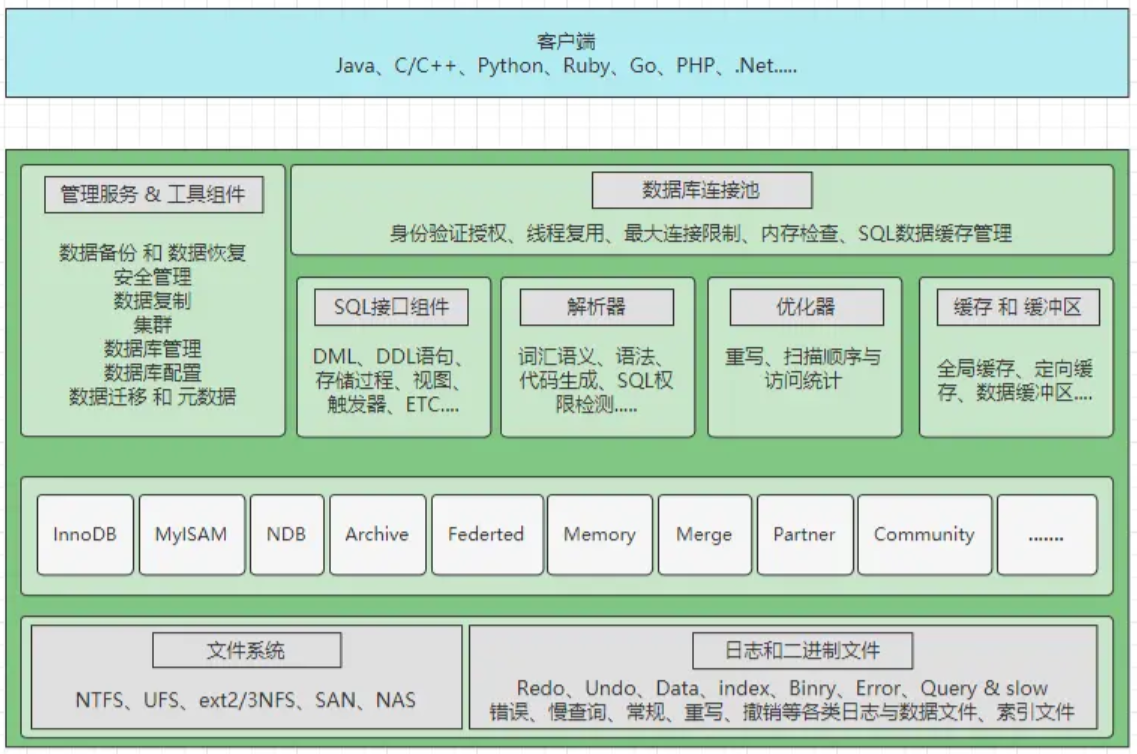

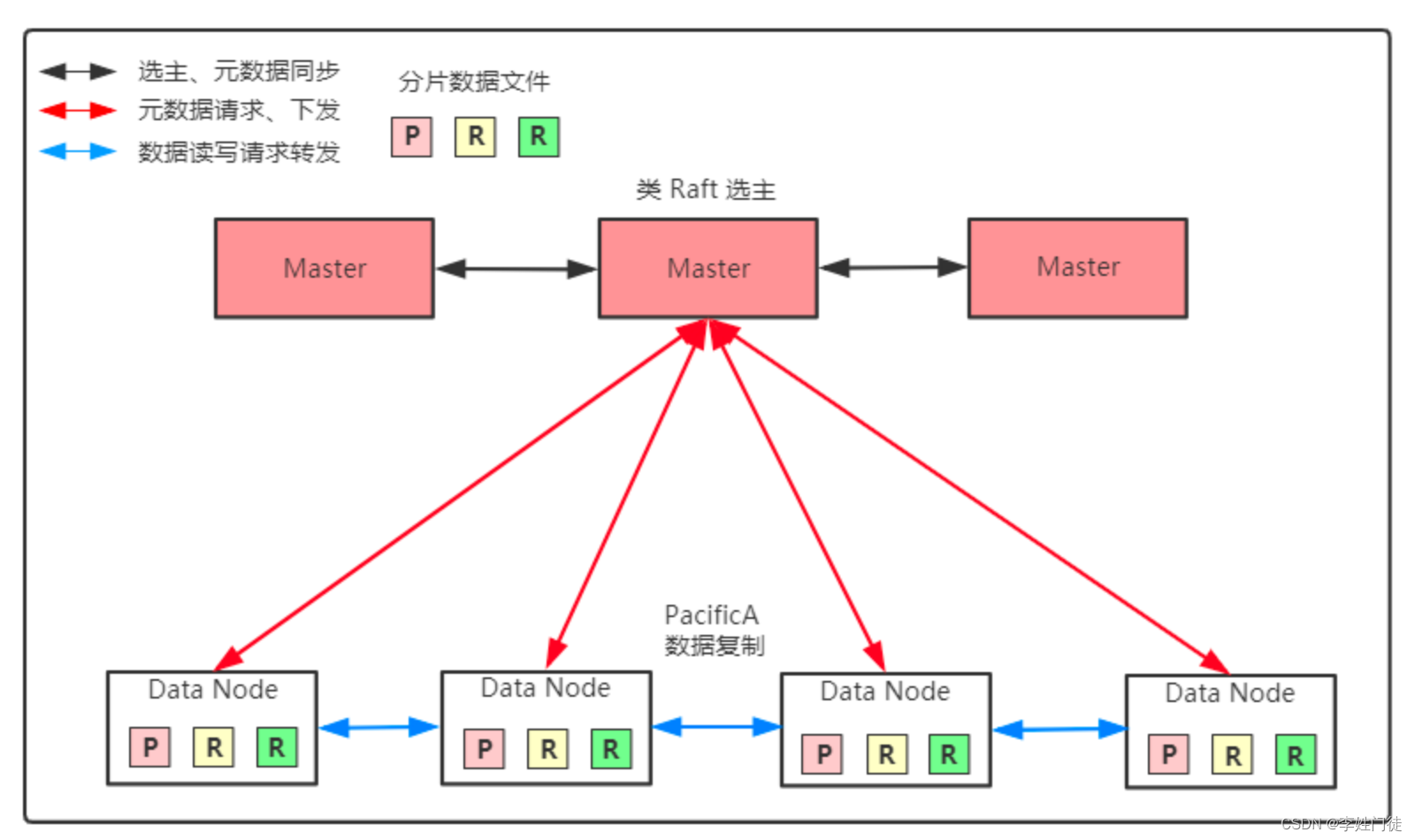

2、E:ElasticSearch(ES),是一个开源的,分布式的存储检索引擎(索引型的非关系型数据库),日志存储

(1)Java代码开发的,基于lucene结构开发的一套全文索引引擎,拥有一个web接口,用户可以通过浏览器的形式和ES组件进行通信

(2)作用:存储允许全文搜索,结构化搜索(索引点),索引点可支持大容量的日志数据,也可以搜索所有不同类型的文档

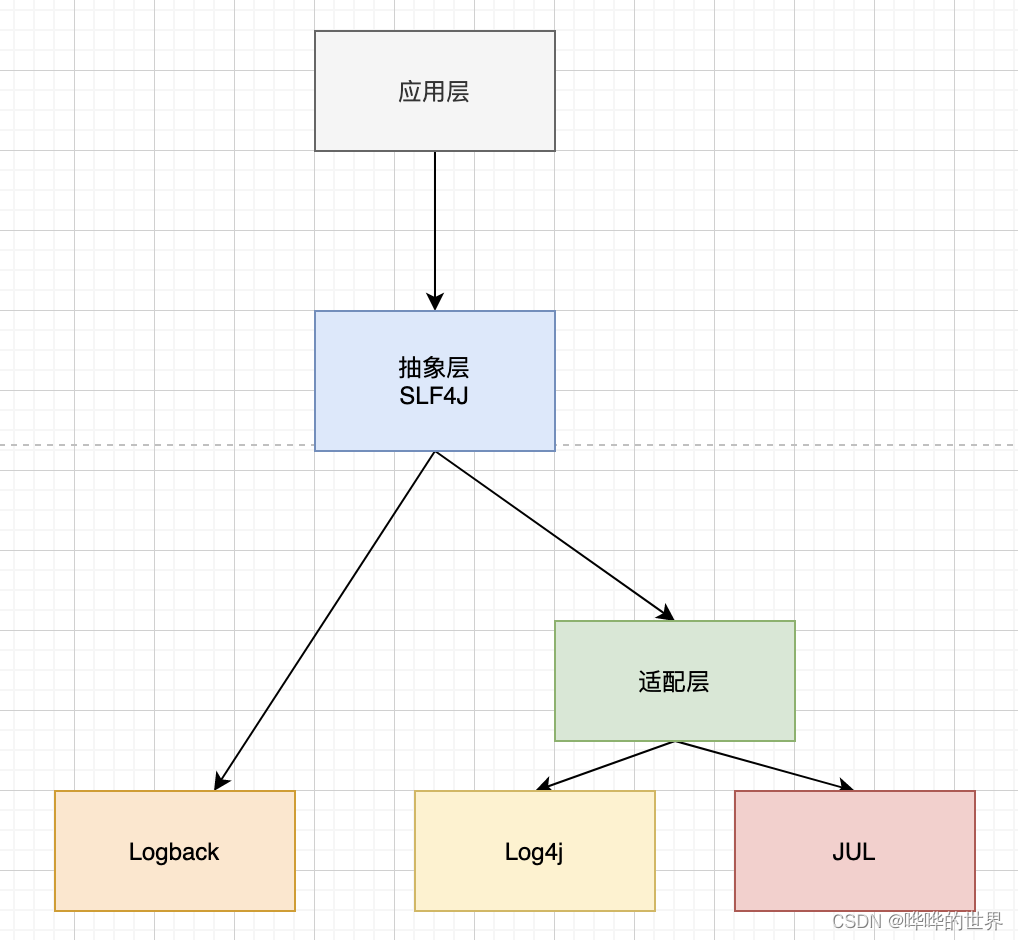

3、L:Logstash,数据搜索引擎,支持动态的(实时)从各种服务应用收集日志资源,还可以收集到日志数据进行过滤、分析、丰富、统一格式等等操作,然后把操作同步到ES存储引擎

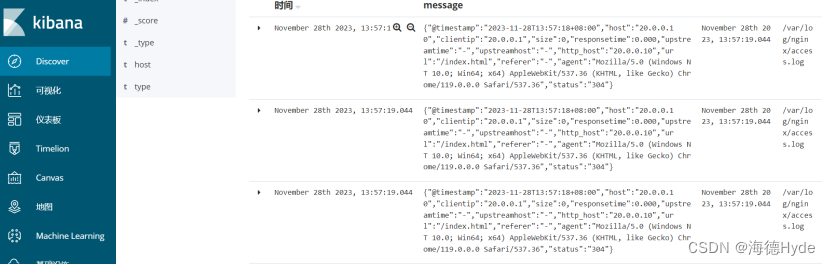

4、K:Kiabana,图形化界面,可以更好的分析存储在ES上的日志数据,提供了一个图形化的界面,来浏览ES上的日志数据,汇总、分析、搜索

5、工具

(1)RUBY语言编写的,运行在Java虚拟机上的一个强大的数据处理工具,数据传输,格式化处理,格式化输出,主要用来处理日志

(2)数据收集工具:

①filebeat:轻量级的开源的,日志收集统计、收集的速度比较快、但是没有数据分析和过滤的能力,但是一般结合logstash一块使用

②kafka:中间件消息列队

③RabbitMQ:中间件消息列队

(二)ELK的数据流向

(三)ELK的作用

1、当我们管理一个大集群时,需要分析和定位的日志就会很多,每一台服务器分别去分析,将会耗时耗力,所以应运而生了一个集中的日志管理和分析系统,极大的提高了定位问题的效率

(四)日志系统的特征

1、收集,可以收集基本市面上常用的软件日志

2、传输,收集到的日志需要发送到ES上

3、存储,ES负责存储数据

4、UI:图形化界面(kiabana)

(五)实验架构

1、三台主机:三台组件,最少2/4G

es1:20.0.0.10(2/4G)

es2:20.0.0.20(2/4G)

logstash kiabana:20.0.0.30(4/8G)

|

主机名 |

IP地址 |

(最少) |

||

|

test2 |

es1 |

20.0.0.20 |

2核4G |

|

|

test3 |

es2 |

20.0.0.30 |

2核4G |

|

|

test1 |

20.0.0.10 |

4核8G |

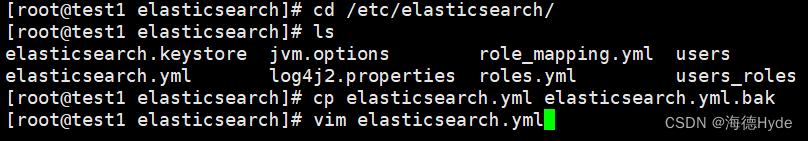

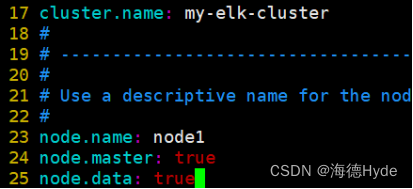

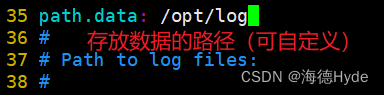

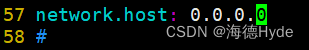

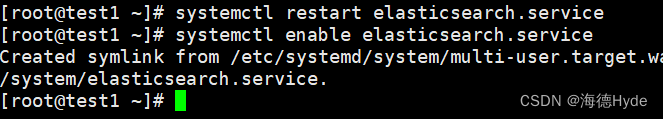

(六)部署ELK集群

![]()

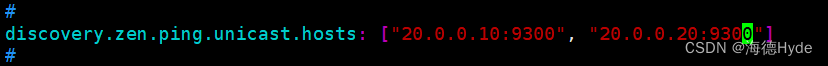

grep –v “^#” /etc/elasticsearch/elasticsearch.yml

2、es的性能调整

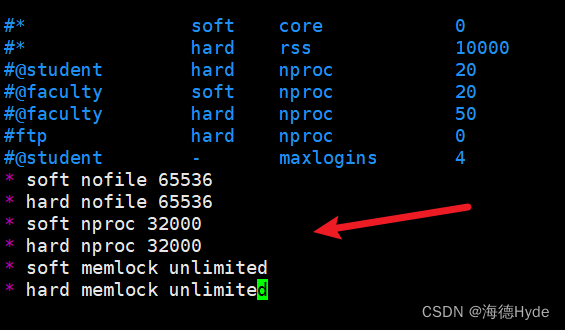

(1)修改打开的最大文件数:vim /etc/security/limits.conf(重启生效)

(2)优化内核文件:vim /etc/systemd/system.conf (重启生效)

|

DefaultLimitNOFILE=65536 |

|

|

DefaultLimitNPROC=32000 |

|

(3)内核优化:vim /etc/sysctl.conf

①ES是基于lucene架构,实现的一款索引型数据库,lucene可以利用操作系统的内存来缓存ES的索引数据,提供更快的查询速度,在工作中我们会把系统的一半内存留给lucene

②若机器内存小于64G,50%给es,50%给操作系统(lucene)

②若机器内存大于64G,es分配4-32G,其他都给操作系统(lucene)

|

内存映射:将文件或者其他设备映射进程地址空间的方法,允许进程直接读取或写入文件,无需常规的I/O方式。映射空间越大,ES和lucene的速度越快 |

|

|

2g/262144;4g/4194304;8g/8388608

|

|

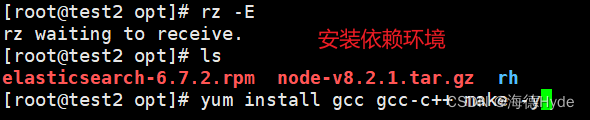

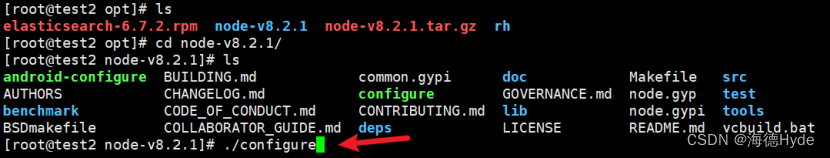

(七)部署node环境

yum install gcc gcc-c++ make -y

tar zxvf node–v8.2.1.tar.gz

./configure

make && make install make -j2 && make install

![]()

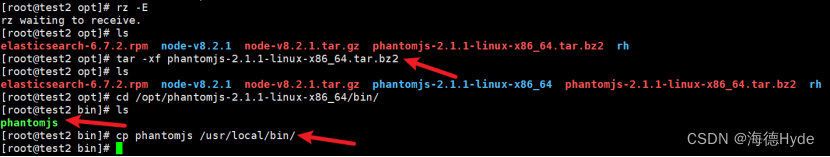

1、安装phantomjs组件

【WebKit插件。PhantomJS是一种没有图形用户界面的网络浏览器】

tar jxvf phantomjs-2.1.1-linux–x86_64.tar.bz2

cd /opt/phantomjs-2.1.1-linux–x86_64/bin

cp phantomjs /usr/local/bin

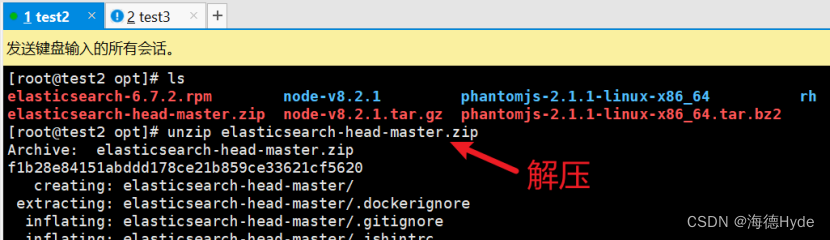

2、安装 Elasticsearch-head 数据可视化工具

unzip elasticsearch-head–master.zip

cd elasticsearch-head–master/

npm install:安装依赖包

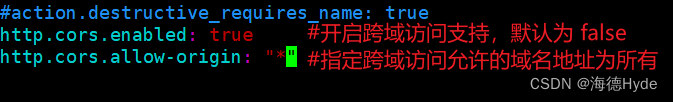

(1)修改Elasticsearch主配置文件:vim /etc/elasticsearch/elasticsearch.yml

(2)启动elasticsearch-head服务

cd /opt/elasticsearch-head–master

后台打开可视化界面服务npm run start &

3、通过Elasticsearch-head查看Elasticsearch 信息

|

9100 |

|

|

9200 |

|

|

9300 |

查询集群ES:http://20.0.0.20:9100

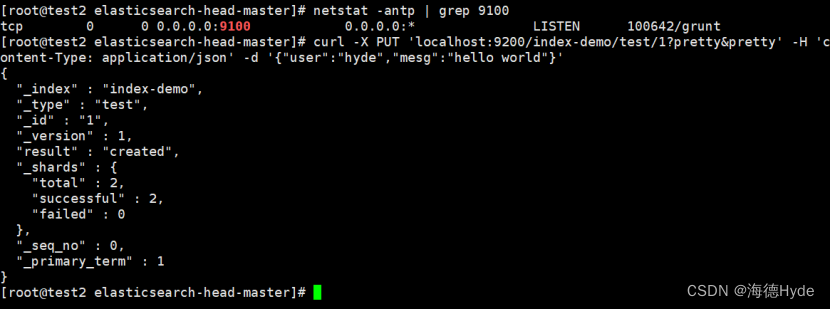

4、插入索引:通过命令插入一个测试索引,索引为 index–demo,类型为 test。

curl -X PUT ‘localhost:9200/index–demo/test/1?pretty&pretty’ -H ‘content-Type: application/json‘ –d ‘{“user“:”hyde“,”mesg“:”hello world“}’

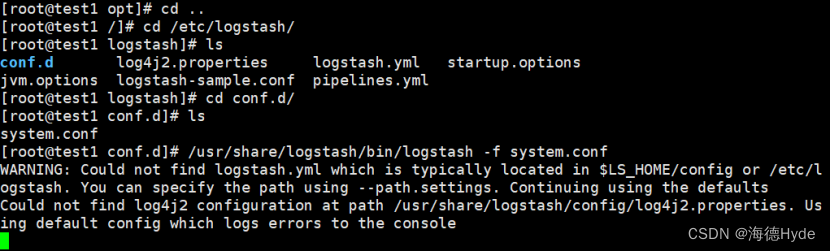

(七)另一台服务器上部署Logstash组件:(用于收集服务器的日志信息并发送到ES)

1、logstash:一般部署在需要监控其日志的服务器上。

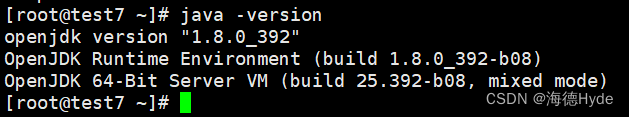

2、安装Java环境

yum -y install java

java -version

3、安装logstash

rpm -ivh logstash-6.7.2.rpm

systemctl start logstash.service

systemctl enable logstash.service

ln -s /usr/share/logstash/bin/logstash /usr/local/bin/

4、Logstash的命名常用选项

|

-f

|

|

|

-e |

测试,从命令行中获取,输入、输出后面跟着字符串,该字符串可以被当作 Logstash 的配置(如果是空,则默认使用 stdin 作为输入,stdout 作为输出)。 |

|

-t |

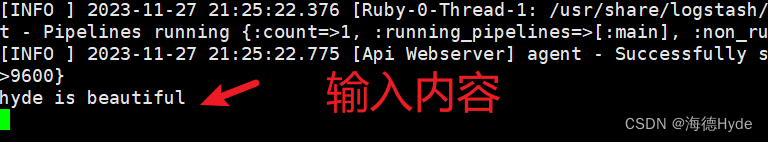

5、测试logsstash

logstash -e ‘input { stdin{} } output { stdout{} }’

|

input从哪里来 stdin从键盘来 output到哪里去 |

|

所有的键盘命令行输出转化成标准输出(rubydebug模式),6.0后,logstash的默认输出格式就是rubydebug格式的标准输出

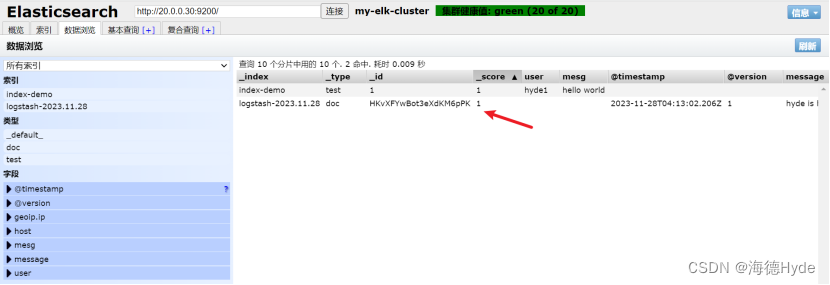

6、使用 Logstash 将信息写入Elasticsearch中

logstash -e ‘input { stdin{} } output { elasticsearch { hosts=>[“20.0.0.20:9200″,”20.0.0.30:9200”] } }’ —path.data /opt/test

/opt/test:指定工作时数据运行的文件

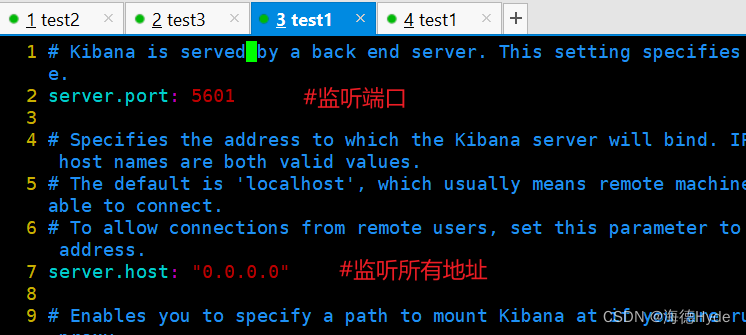

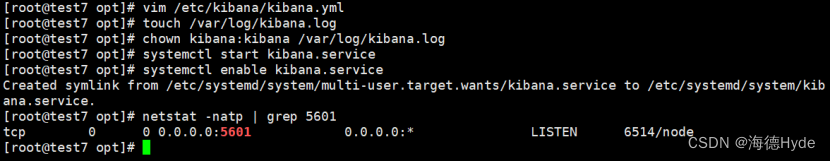

7、安装kibana组件(图形化界面)

rpm -ivh kibana-6.7.2-x86_64.rpm

(2)创建日志文件,启动 Kibana 服务

touch /var/log/kibana.log

赋权:chown kibana:kibana /var/log/kibana.log

systemctl start kibana.service

(3)测试Kibana:浏览器访问 http://20.0.0.10:5601

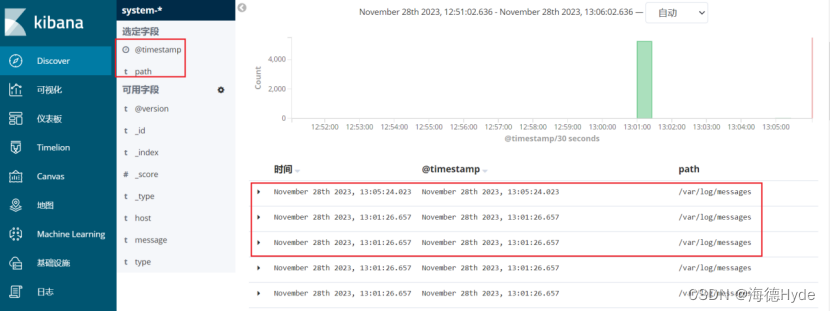

7、测试发送数据到ES服务器上

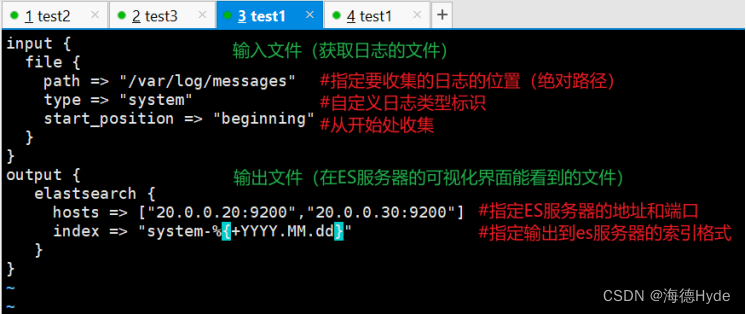

(1)将message收集的日志文件发送到system.conf中

创建vim system.conf

![]()

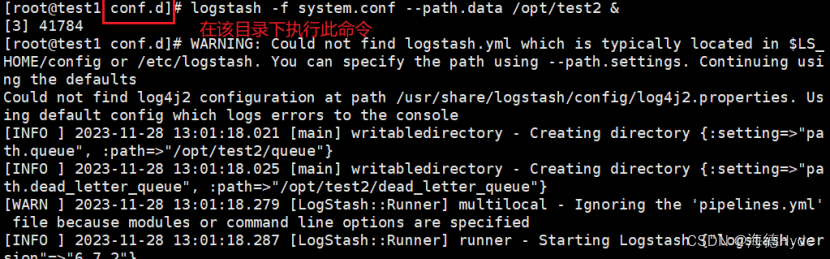

logstash -f system.conf —path.data /opt/test1 &

重启elasticsearch.service,测试test1是否收到test2的日志数据

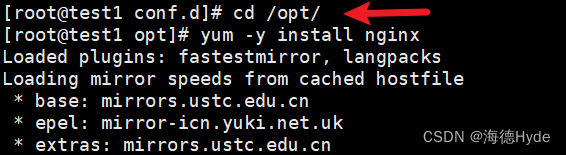

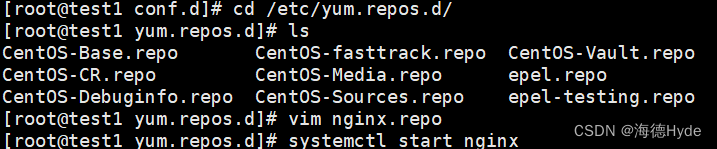

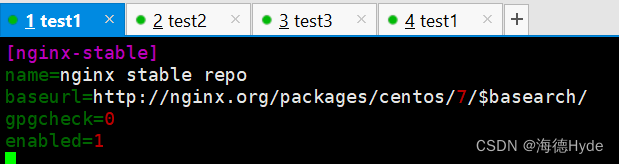

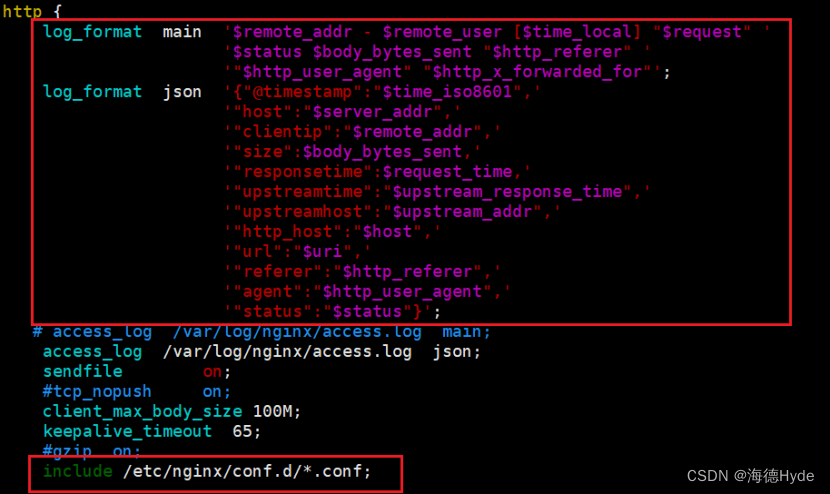

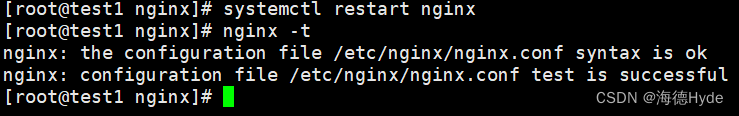

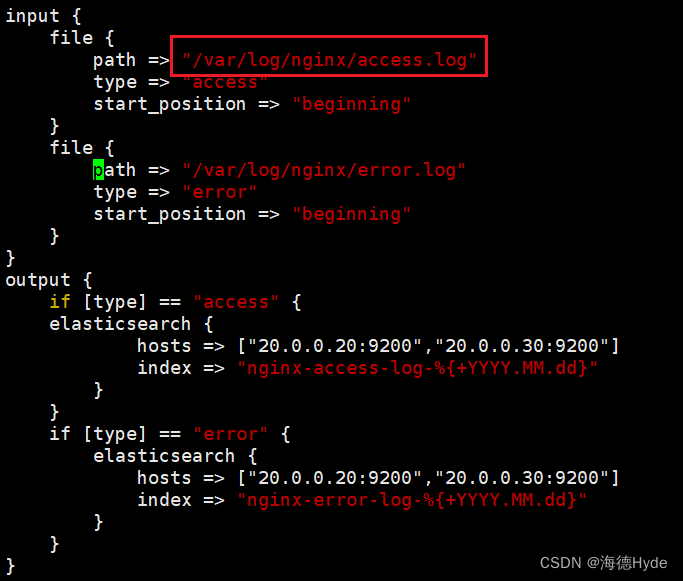

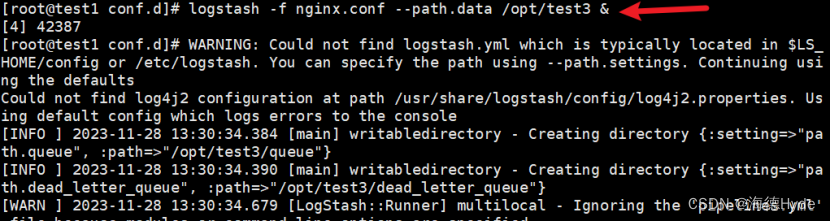

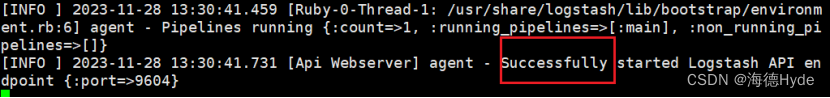

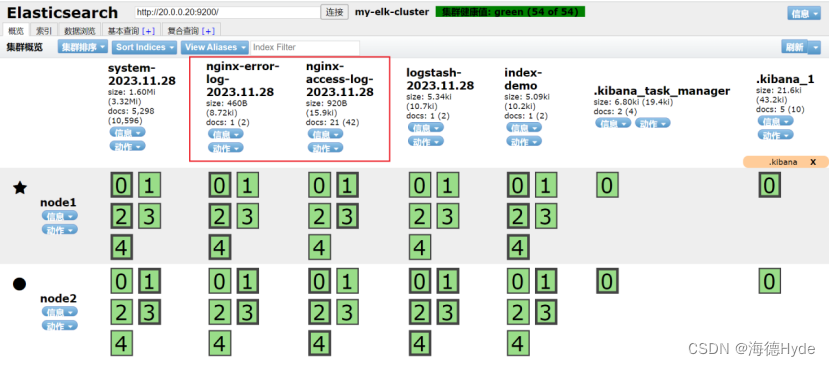

8、ELK收集nginx的json格式日志

logstash -f nginx.conf –path.data /opt/test3 &

访问nginx,收集日志

原文地址:https://blog.csdn.net/weixin_48145965/article/details/134674101

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_4963.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。