本文介绍: 之前都是*nix环境使用pytorch,这次尝试了一下windows。我们来部署下流行性高的stable diffusion和我觉得实用性比stable diffusion高多了的NeRF。

之前都是 *nix 环境使用 pytorch,这次尝试了一下windows。

我们来部署下流行性高的stable diffusion和我觉得实用性比stable diffusion高多了的NeRF

Stable Diffusion

其实,我也不知道要写啥,都是按照步骤做就好了,后面等有时间了我们来写写如何训练模型吧……

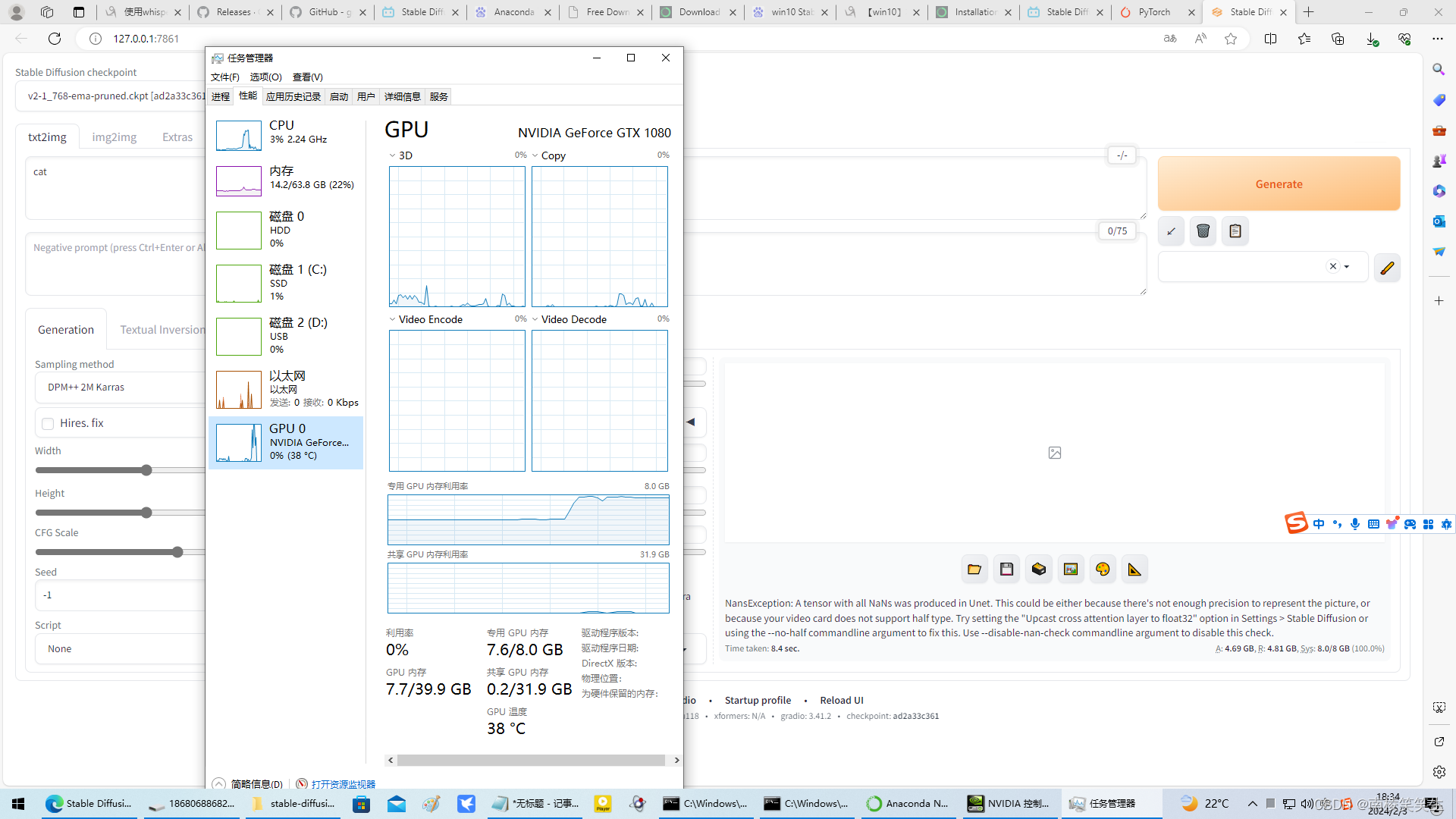

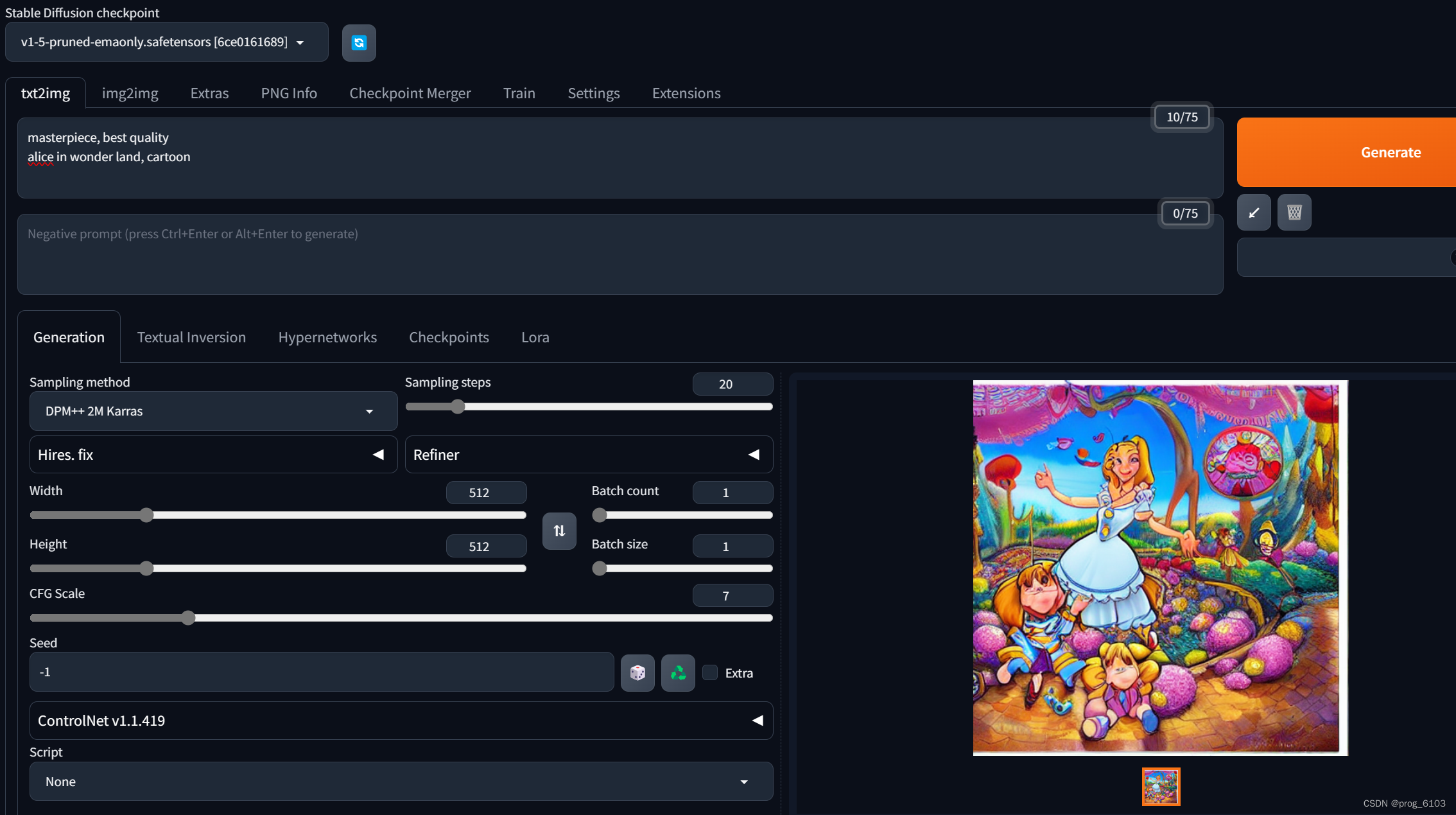

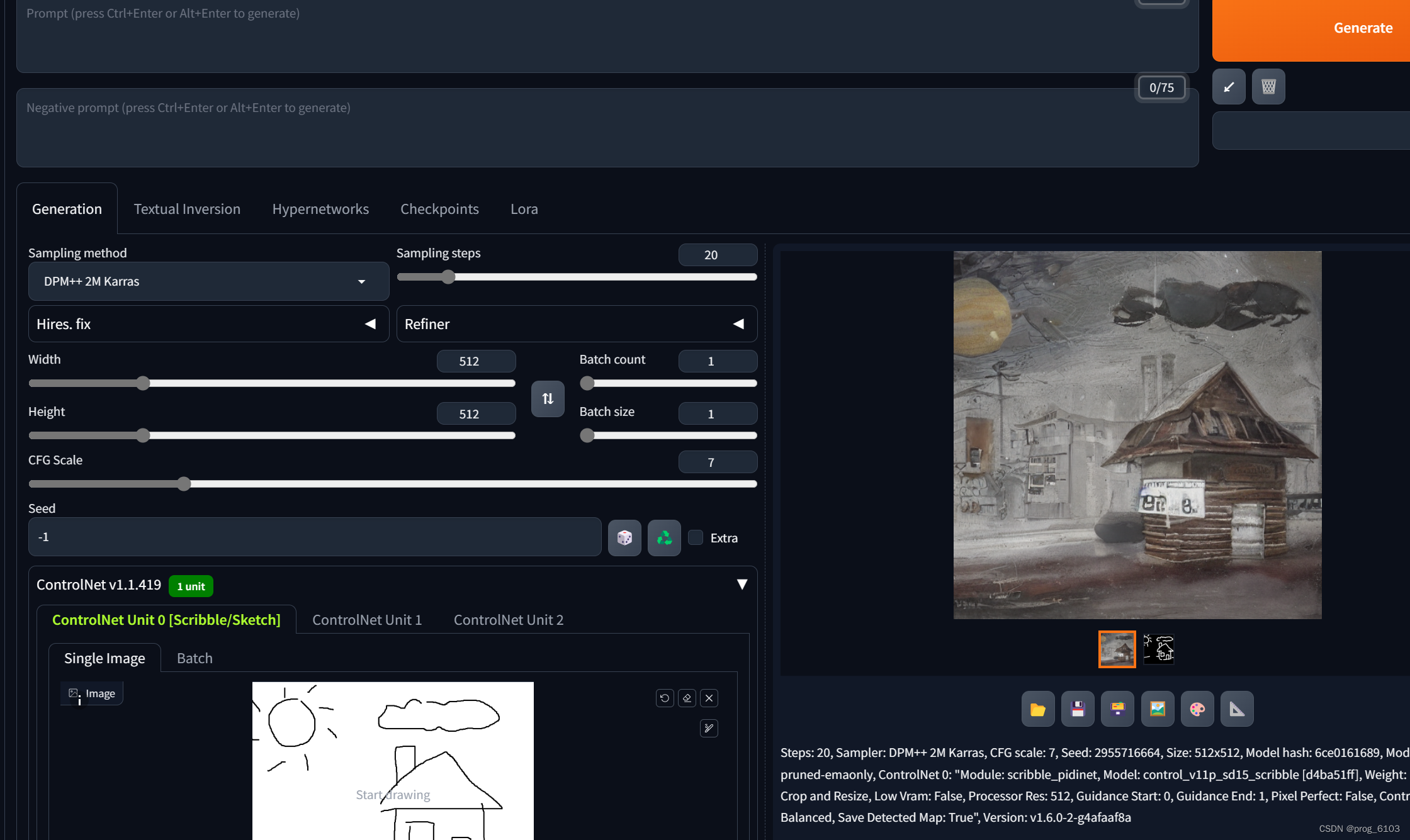

一般,我们不用直接去捣鼓这个模型和一堆脚本,人家有webui,可以启动网页版啊…所以国内有很多就是基于这个网页版,然后再把最重要的一步Hugging Face上的模型搬运过来…我估计在国内架一个Hugging Face CDN最近会很吃香啊,随便搜索了下,bing上还是有的…

是的,最近都不怎么用Google了,Bing已经不错了…有事就问搭载GPT-4的Coplit…

扯了这么多,用得比较多得webui的github:

看了一下,github上发布目前最新的已经只有source code了;

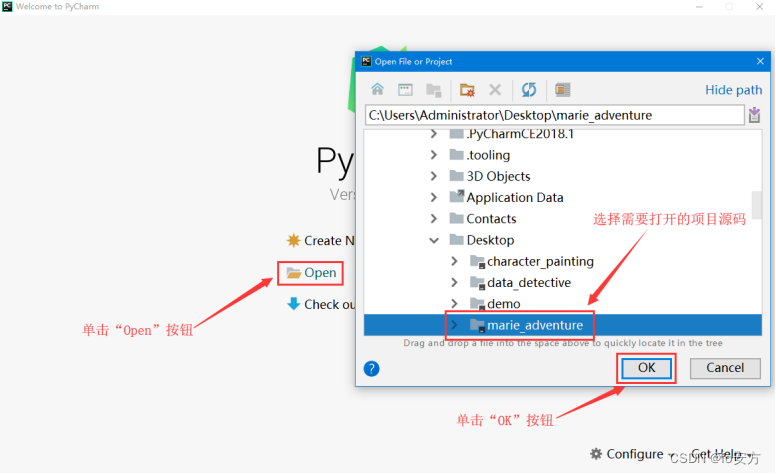

然而,如果你不想费周折去在windows上配置python+git,那么就直接

把 sd.webui.zip 下载下来,解压,运行 update.bat 再 run.bat 其实就可以用了…

btw,我得windows机器是Nvida 3070,所以先去官网安装Cuda驱动,3GB,啊既然提到了GB,准备好30GB再来运行stable diffusion哦…

NeRF

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。

补充下,

补充下,