本文介绍: Scrapy的社区非常活跃,提供了丰富的资源和文档,帮助开发人员更好地使用这个框架。Scrapy提供了许多内置的功能,如请求处理、数据提取、爬虫管理等,以及易于使用的API,使开发人员能够轻松地编写高效的爬虫。Python提供了多种库和框架,例如unittest、pytest和Selenium WebDriver等,这些库和框架可以帮助您编写高效、可维护的测试脚本。灵活的导航、搜索和修改:BeautifulSoup 提供了强大的导航、搜索和修改功能,使你能够轻松地在文档树中移动并提取信息。

目录

一:requests

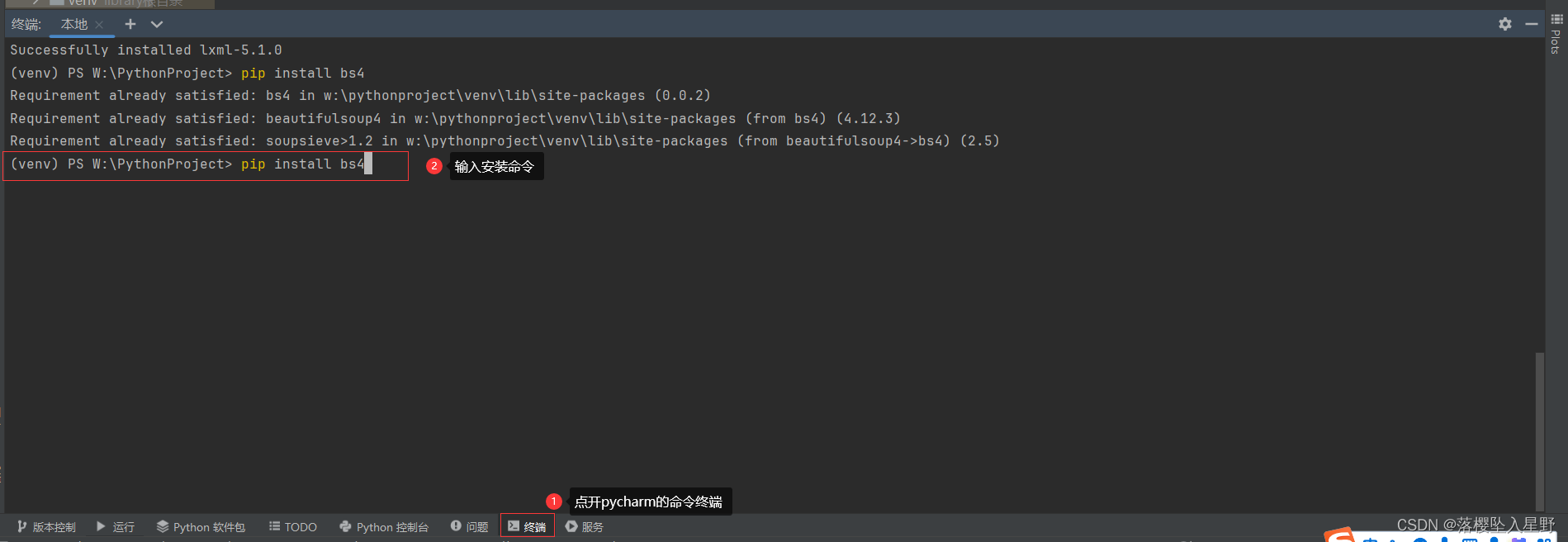

二:BeautifulSoup

三:Scrapy

四:Selenium

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。