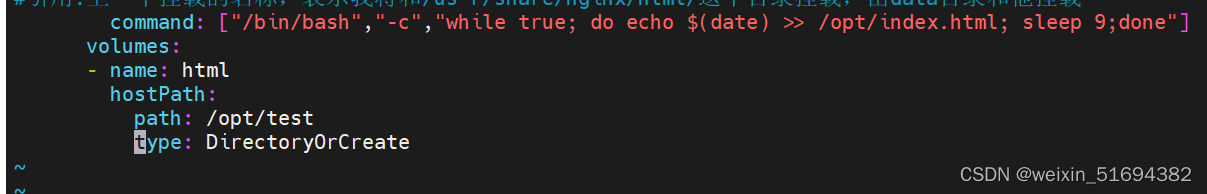

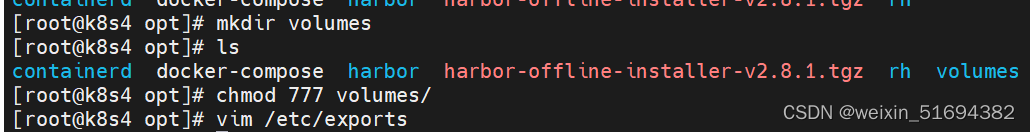

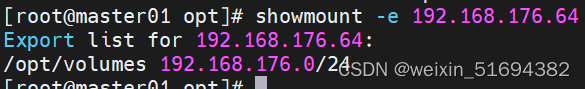

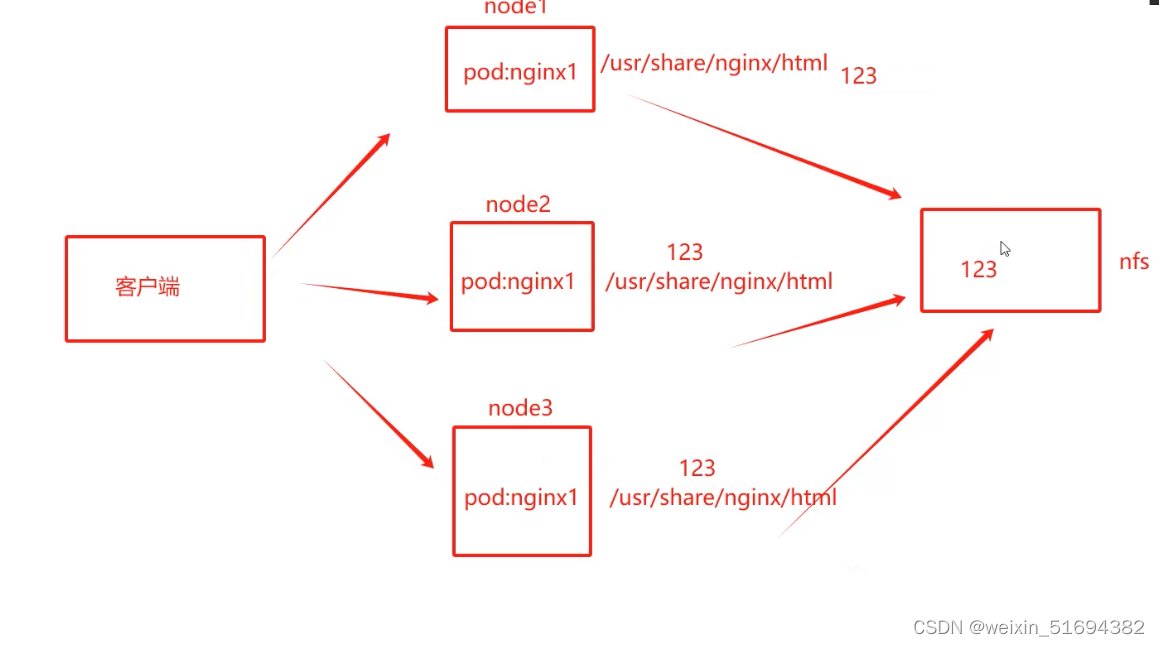

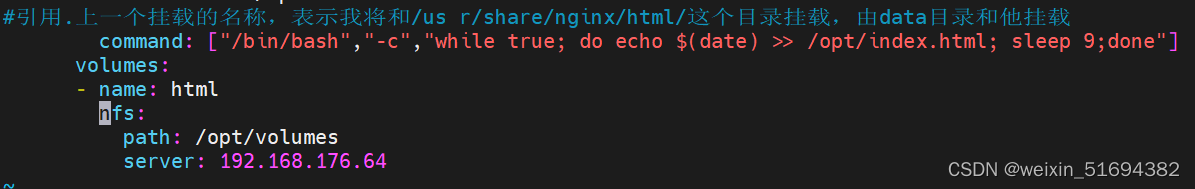

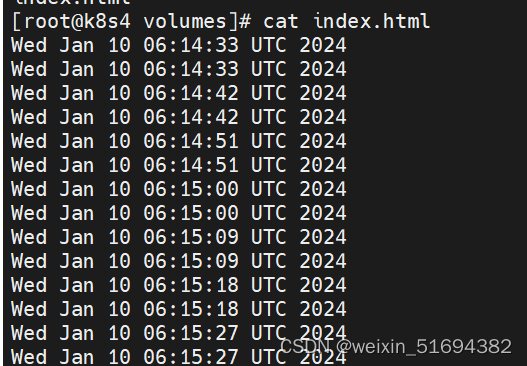

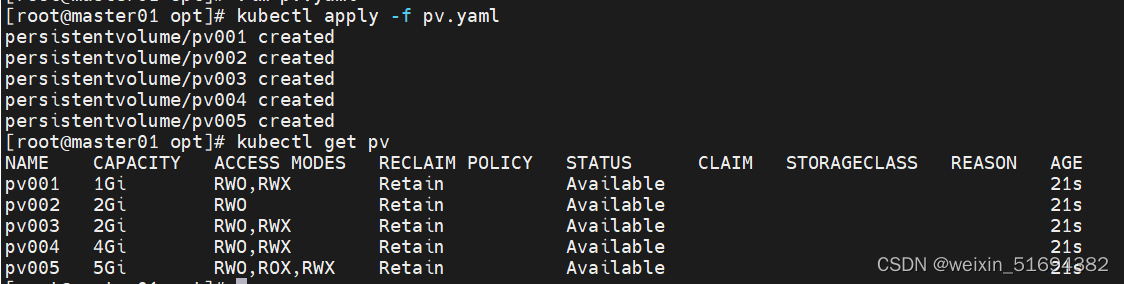

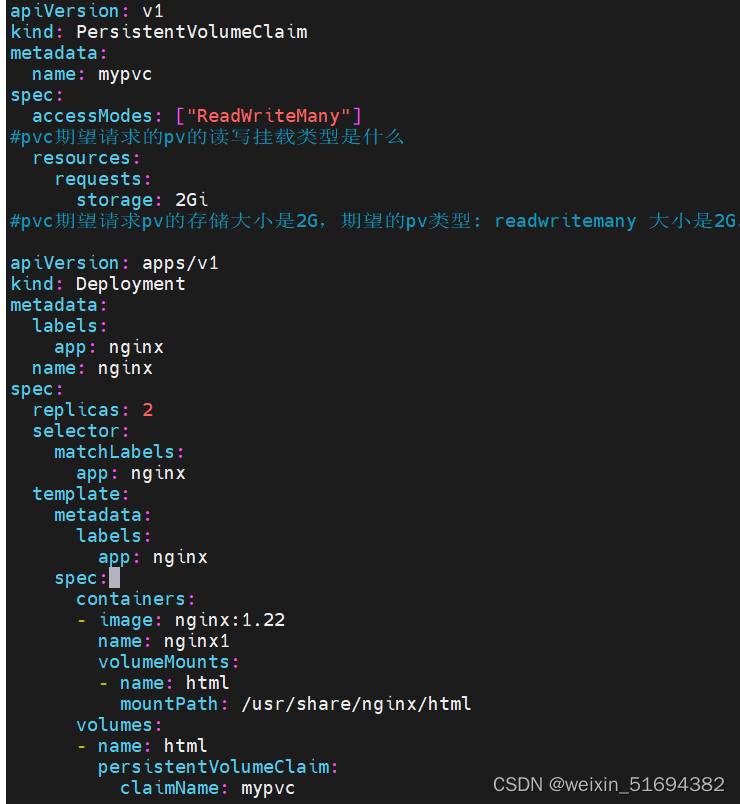

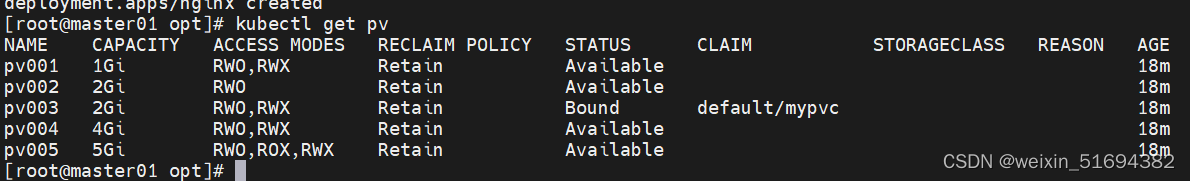

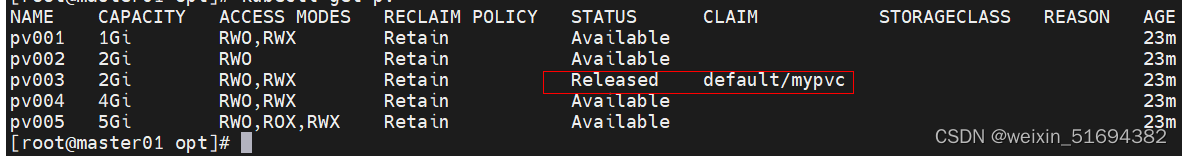

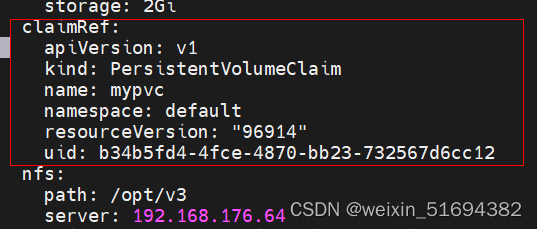

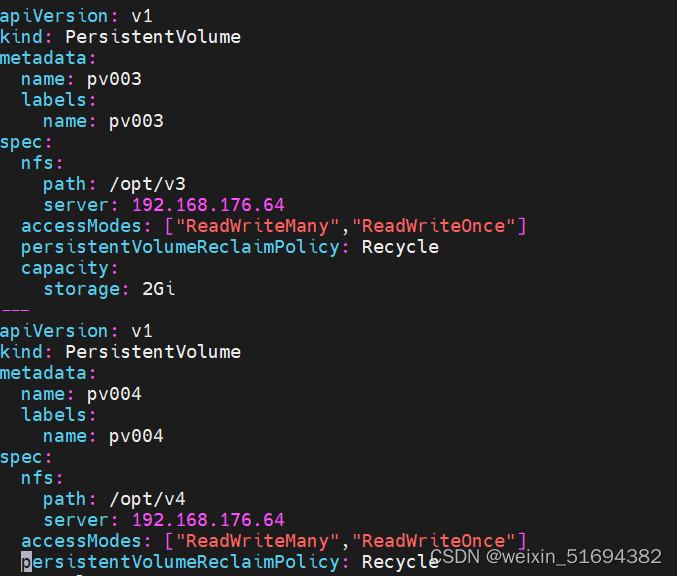

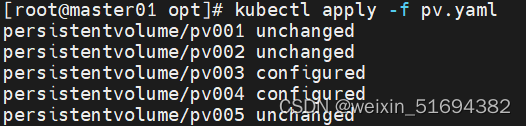

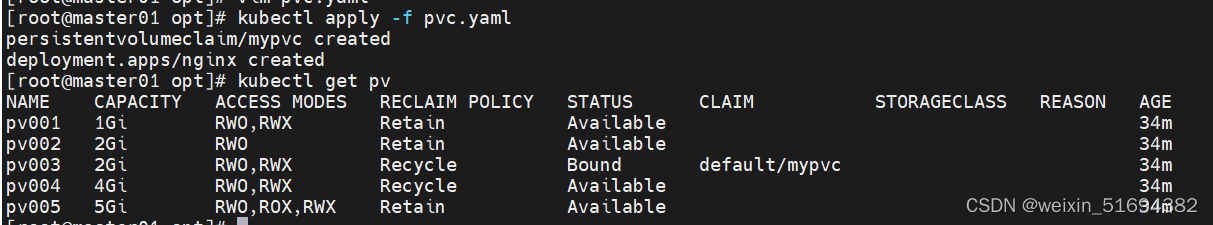

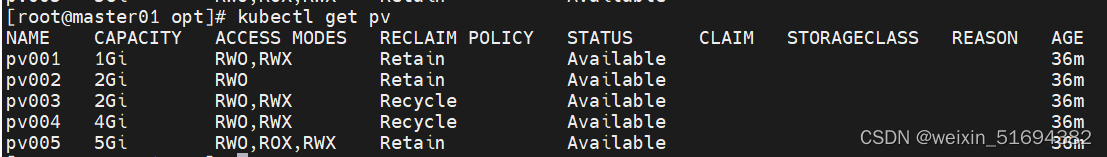

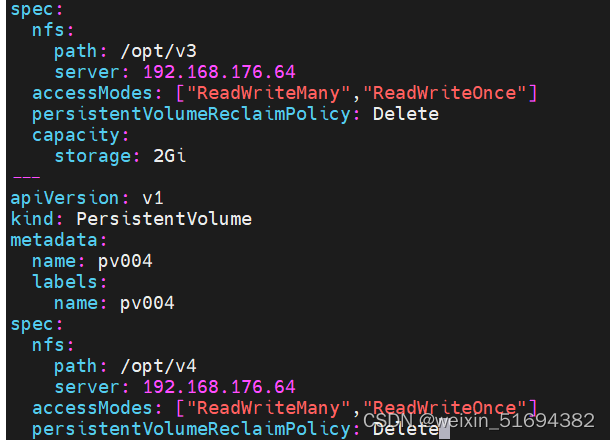

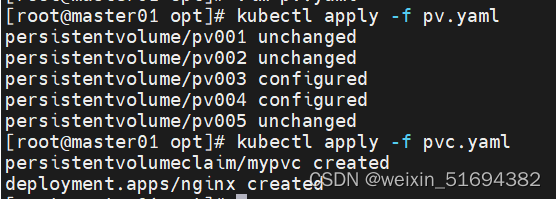

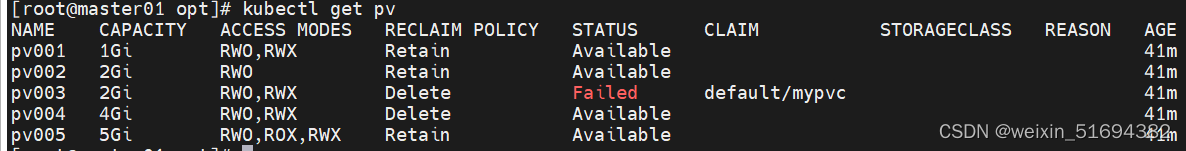

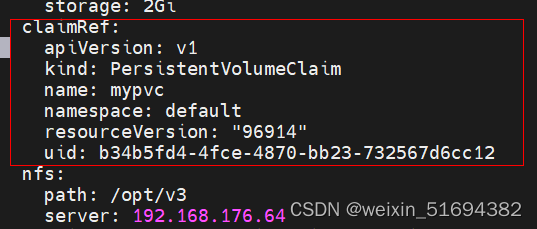

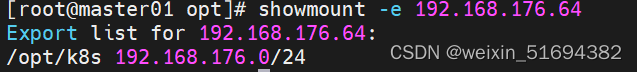

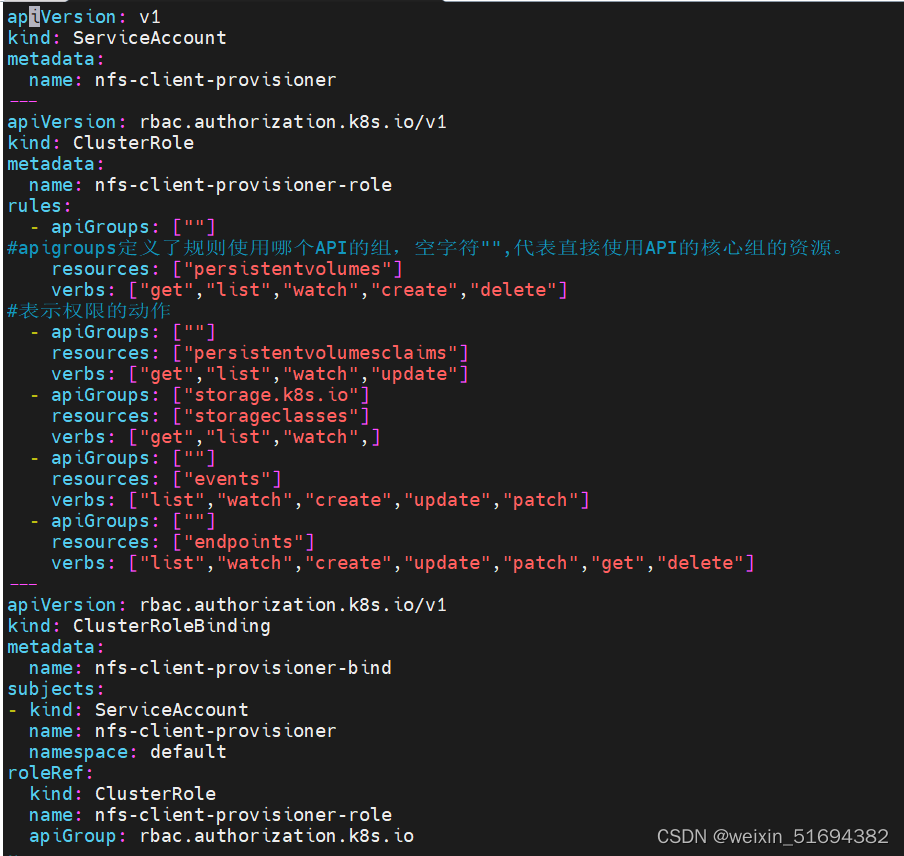

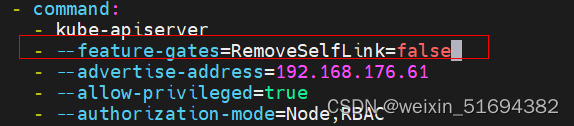

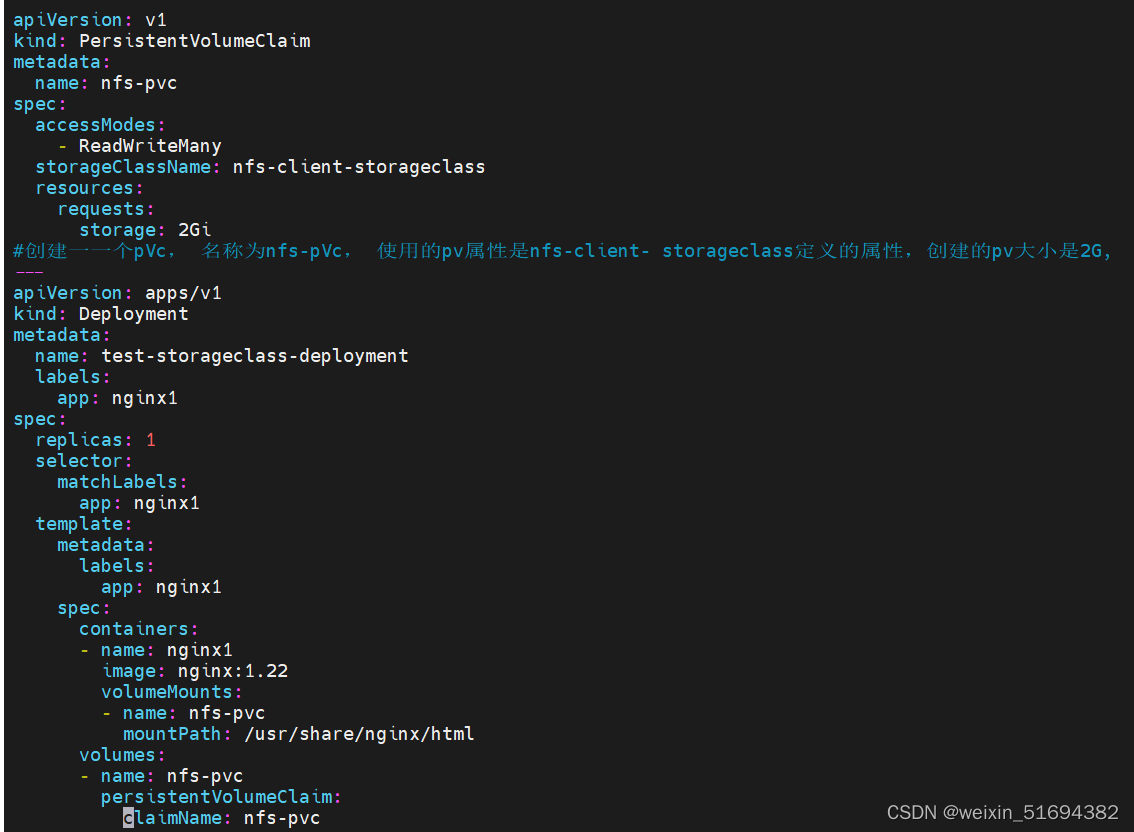

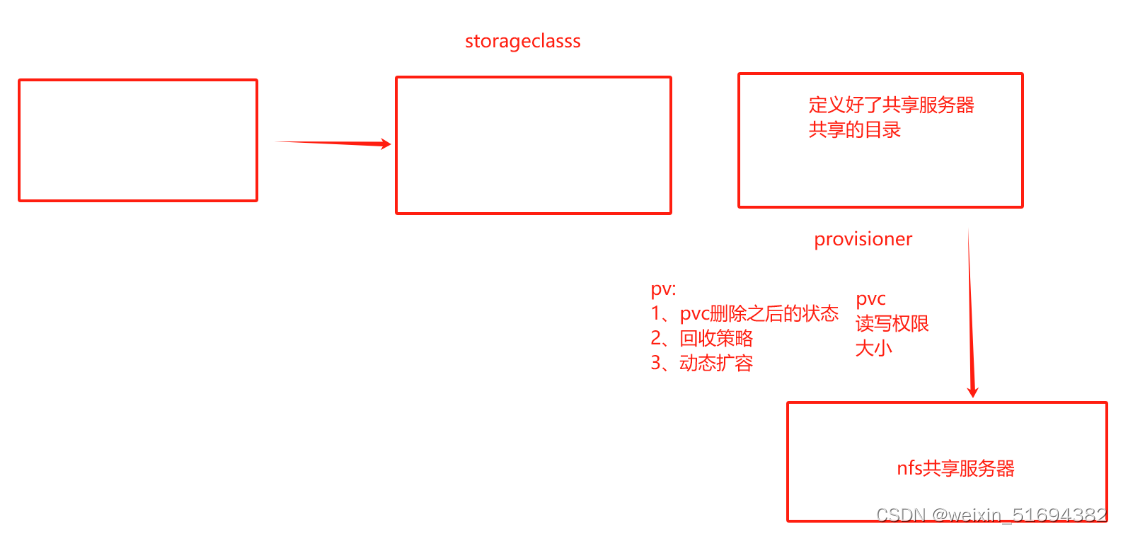

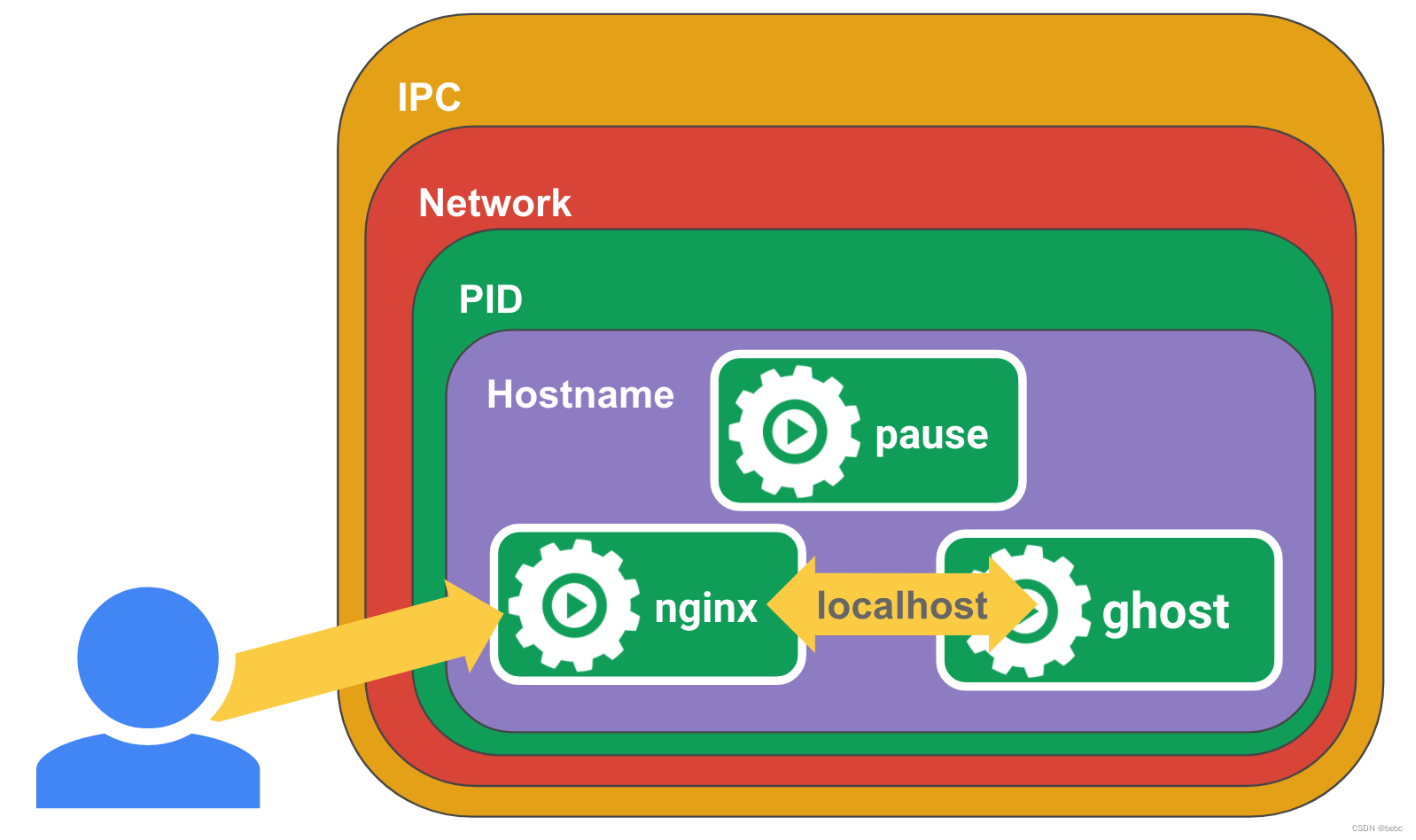

本文介绍: 1,provisioing(配置)—-pvc请求request—-检索(找一个合适的pv)—pvc和pv(binding 绑定)—-使用—–pod被删除——pv的releasing(释放)—-recycling(回收)pod内的挂载点声明一个请求pvc请求,pvc会找一个最合适的pv来作为pod的存储卷,pv和关系目录在一一映射,最终由nfs来提供最终的关系存储空间。2,hostPath:将容器内的挂载点,和节点上的目录进行挂载,hostPath可以失效数据的持久。

存储卷—数据卷

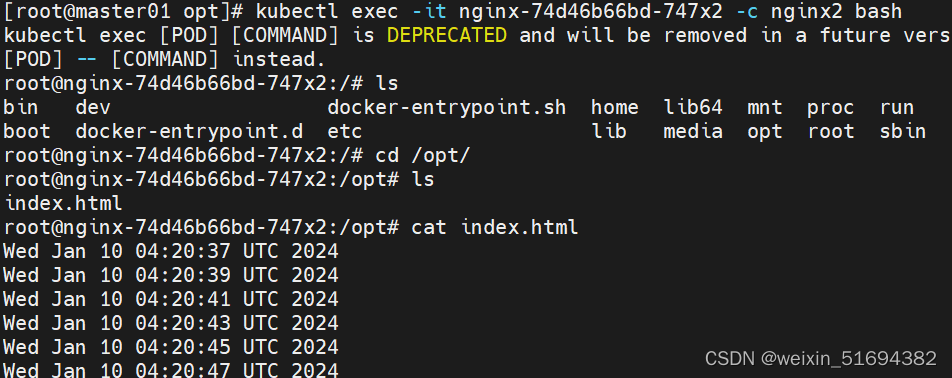

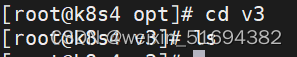

容器内的目录和宿主机的目录进行挂载。

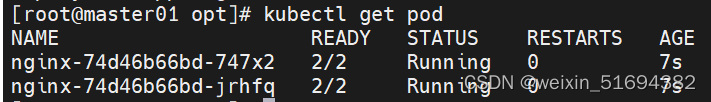

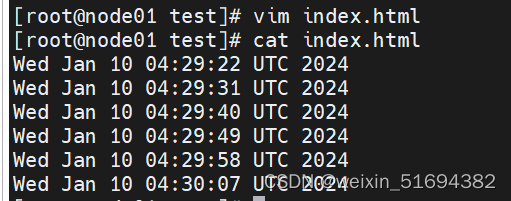

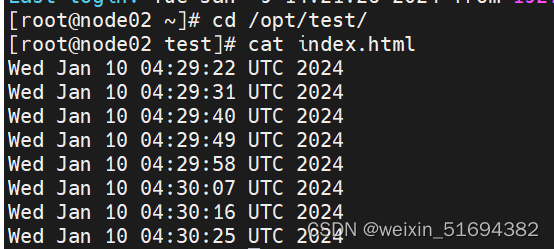

容器在系统上的生命周期是短暂的,deletek8s用控制器创建的pod,delete相当于重启,容器的状态也会回复到初始状态。

一旦回到初始状态,所有的后天编辑的文件的都会消失。

容器容器和节点之间创建一个可以持久化保存容器内文件的存储卷。即使容器被销毁,删除,重启,节点上的存储卷的数据依然存在,后续也可以继续使用。可以继续将容器内目录和宿主机挂载,保存的数据继续使用。

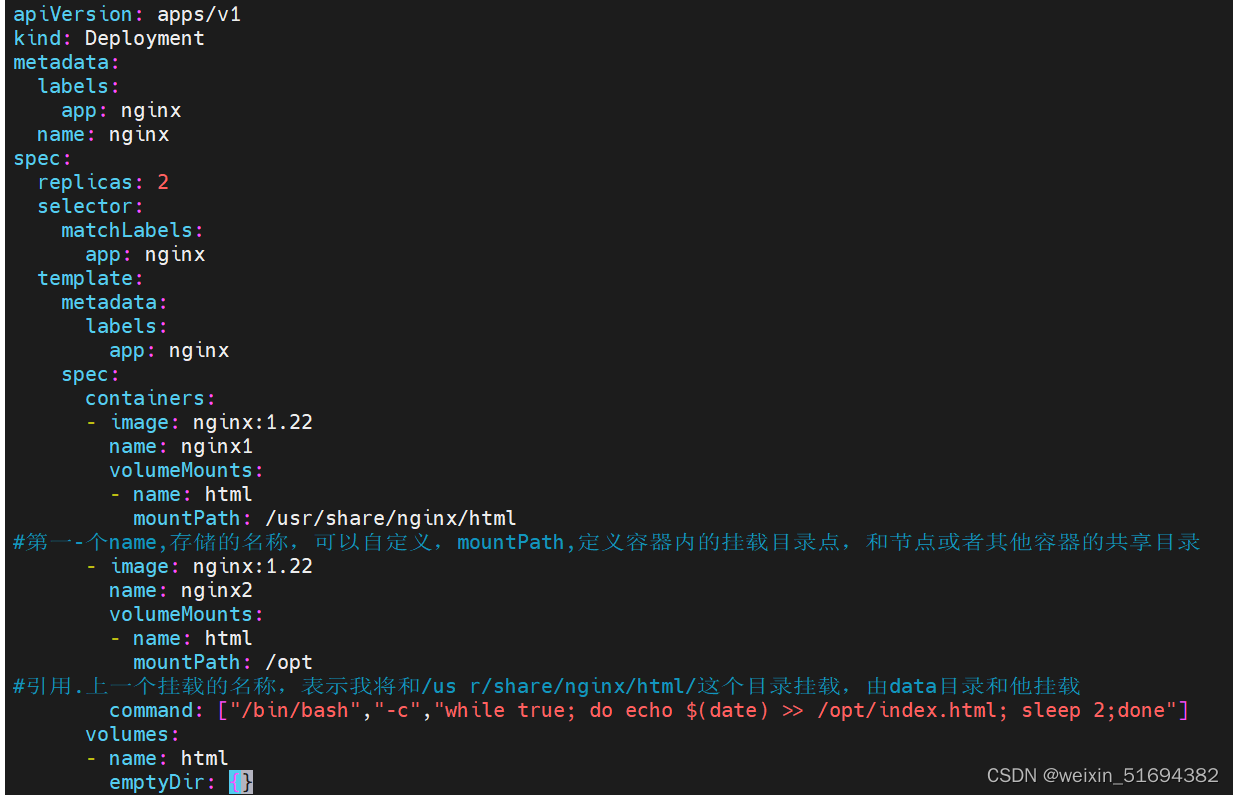

1,emptyDir

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。