Channel-separation-based Network for Object Detection under Foggy Conditions

Abstract

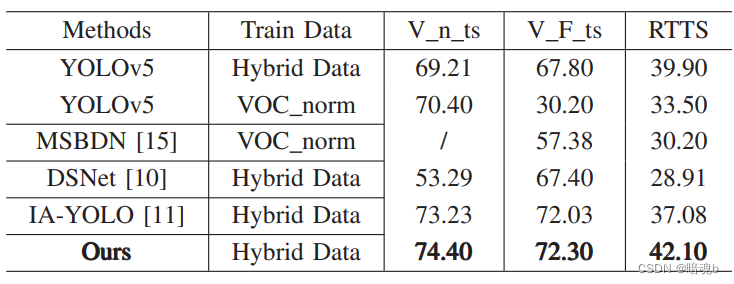

现存的一些方法尝试恢复高质量图像,但这会增加网络复杂性并且丢失图像的潜在信息。在这项研究中,一个基于通道分离的检测网络被提出用来保存潜在信息。特别地,雾过滤器用于在图像处理期间执行修剪,以保持图像的潜在信息。通过把深层特征提取替换为一个即插即用模块(MBConvBlock)和使用一个新的CSPBottleNeck和CrossConv联合,我们的模型克服了卷积神经网络固有的缺点,并具有全局感受野和专注于更关键的特征。这个模型使用端到端的方法和混合数据进行训练,因此课题提高模型网络的泛化能力。

Introduction

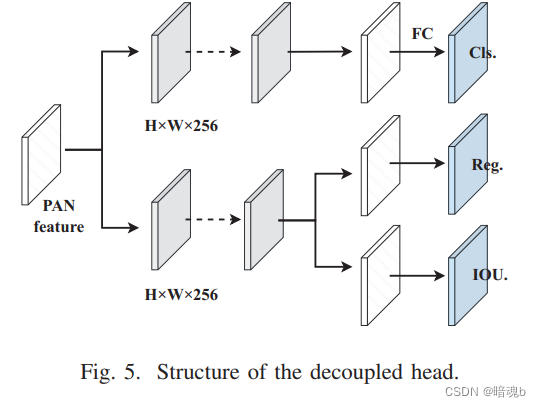

提出了一种基于通道分离的检测网络包含四个部分来保留额外的潜在信息。

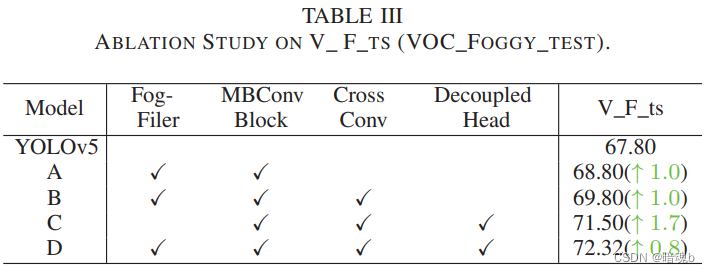

1、首先,使用雾过滤器,对图像预处理进行修建保留了正常图像信息。雾过滤器被用来过滤和增强有雾图片。

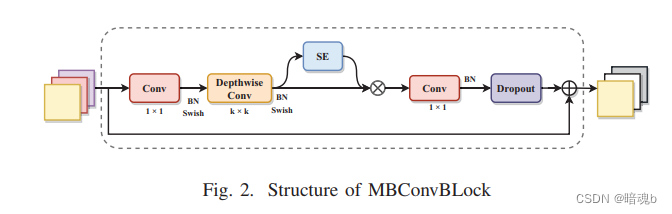

2、在网络主干引入了MBConvBlock(包括深度卷积和SE)。这可以改善深度特征图对空间信息的低敏感性并且克服雾天条件下全局特征的不完整性。

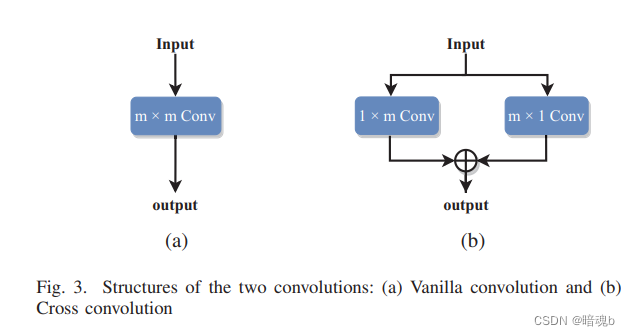

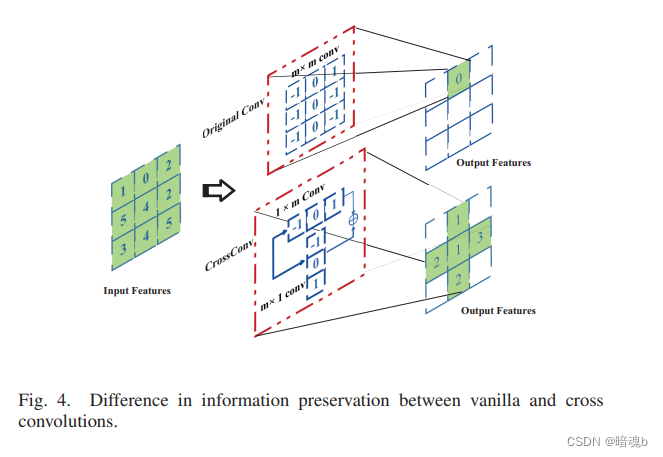

3、将改进的CSPBottleNeck和CrossConv结合用于特征金字塔。它可以缓解原始卷积在特征聚合中的信息丢失并且挖掘边缘信息。

4、为了提高网络的性能将正常图片和有雾图片混合用于训练。

本文主要贡献如下:

1、提出了一种基于通道分离的端到端检测网络,因此可以达到更高的准确率并且不需要复杂的结构或者图像处理方法

2、提出了一种雾过滤器

3、由于原始卷积提取特征的局限性,MBConvBlock被引入提取复杂的语义和空间信息。设计了一种与CrossConv相结合的改进的CSPBottleNeck,以在特征聚合过程中保留额外的潜在信息。它们增强了特征的表达能力,从而提高了被雾遮挡物体的检测能力。

Method

A. Fog Filter

Fog Detector

去雾方法可以得到无雾的图片;但是也许会造成图像曝光过度并且损害正常场景的信息。这牺牲了对正常场景的检测精度。为了解决上述问题,提出了一个fog detector来保证正常场景中的所有信息,为了确保我们的模型可以适应有雾环境和正常环境,其中输入图像的方差被用作检测器的标准。如果方差低于某个值我们就认为有雾,在朦胧条件,雾会使图片变灰,这会使得有雾图片的方差比清晰的图片小很多。这证明了使用方差作为检测器标准的可行性。

Fog Removal

为了保留更多的图片信息,我们的模型在图片处理过程中只通过增强图片对比度来进行修剪。在fog filter引入了自动色彩增强(ACE)算法。它通过计算目标像素和周围像素之间的关系以及它们的光照和在图像中的变形程度来校正像素值,以调整图像的对比度。

ACE算法具体步骤如下:

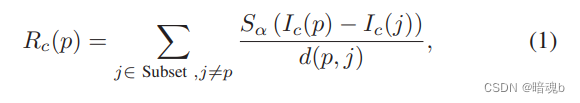

1、计算对单通道图像I中的所有点p进行自适应滤波,以获得色差校正和空间重建后的中间结果,如下所示:

代表p和j像素之间的灰度差,d(p,j)是控制点j对p的影响权重并映射滤波的区域适应性的两点之间的欧几里得距离。

代表p和j像素之间的灰度差,d(p,j)是控制点j对p的影响权重并映射滤波的区域适应性的两点之间的欧几里得距离。

S(x)是亮度性能函数

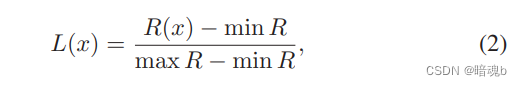

2、在公式1获得的中间值被拉伸映射到【0,255】,占据8位灰度

总体而言,通过雾过滤器,仅对雾图像进行去雾增强,保留了正常环境中的图像信息,并且在雾条件下损失较小。