目录

基础客户端

引入依赖

<dependency>

<groupId>org.apache.kafka</groupId>

<artifactId>kafka_2.13</artifactId>

<version>3.4.0</version>

</dependency>消息发送者主流程

public class MyProducer {

private static final String BOOTSTRAP_SERVERS = "127.0.0.1:9092";

private static final String TOPIC = "disTopic";

public static void main(String[] args) throws ExecutionException, InterruptedException {

//PART1:设置发送者相关属性

Properties props = new Properties();

// 此处配置的是kafka的端口

props.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, BOOTSTRAP_SERVERS);

// 配置key的序列化类

props.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG,"org.apache.kafka.common.serialization.StringSerializer");

// 配置value的序列化类

props.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG,"org.apache.kafka.common.serialization.StringSerializer");

Producer<String,String> producer = new KafkaProducer<>(props);

CountDownLatch latch = new CountDownLatch(5);

for(int i = 0; i < 5; i++) {

//Part2:构建消息

ProducerRecord<String, String> record = new ProducerRecord<>(TOPIC, Integer.toString(i), "MyProducer" + i);

//Part3:发送消息

//单向发送:不关心服务端的应答。

producer.send(record);

System.out.println("message "+i+" sended");

//同步发送:获取服务端应答消息前,会阻塞当前线程。

RecordMetadata recordMetadata = producer.send(record).get();

String topic = recordMetadata.topic();

int partition = recordMetadata.partition();

long offset = recordMetadata.offset();

String message = recordMetadata.toString();

System.out.println("message:["+ message+"] sended with topic:"+topic+"; partition:"+partition+ ";offset:"+offset);

//异步发送:消息发送后不阻塞,服务端有应答后会触发回调函数

producer.send(record, new Callback() {

@Override

public void onCompletion(RecordMetadata recordMetadata, Exception e) {

if(null != e){

System.out.println("消息发送失败,"+e.getMessage());

e.printStackTrace();

}else{

String topic = recordMetadata.topic();

long offset = recordMetadata.offset();

String message = recordMetadata.toString();

System.out.println("message:["+ message+"] sended with topic:"+topic+";offset:"+offset);

}

latch.countDown();

}

});

}

//消息处理完才停止发送者。

latch.await();

producer.close();

}

}构建Producer分为三个步骤:

1. 设置Producer核心属性 :Producer可选的属性都可以由ProducerConfig类管理。比如ProducerConfig.BOOTSTRAP_SERVERS_CONFIG属性,显然就是指发送者要将消息发到哪个Kafka集群上(目前用的非集群)。这是每个Producer必选的属性。

2. 构建消息:Kafka的消息是一个Key-Value结构的消息。其中,key和value都可以是任意对象类型。其中,key主要是用来进行Partition分区的,业务上更关心的是value。

3. 使用Producer发送消息。:通常用到的就是单向发送、同步发送和异步发送者三种发送方式。

消息消费者主流程

public class MyConsumer {

private static final String BOOTSTRAP_SERVERS = "127.0.0.1:9092";

private static final String TOPIC = "disTopic";

public static void main(String[] args) {

//PART1:设置发送者相关属性

Properties props = new Properties();

//kafka地址

props.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG, BOOTSTRAP_SERVERS);

//每个消费者要指定一个group

props.put(ConsumerConfig.GROUP_ID_CONFIG, "test");

//key序列化类

props.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");

//value序列化类

props.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, "org.apache.kafka.common.serialization.StringDeserializer");

Consumer<String, String> consumer = new KafkaConsumer<>(props);

consumer.subscribe(Arrays.asList(TOPIC));

while (true) {

//PART2:拉取消息

// 100毫秒超时时间

ConsumerRecords<String, String> records = consumer.poll(Duration.ofNanos(100));

//PART3:处理消息

for (ConsumerRecord<String, String> record : records) {

System.out.println("offset = " + record.offset() + ";key = " + record.key() + "; value= " + record.value());

}

//提交offset,消息就不会重复推送。

consumer.commitSync(); //同步提交,表示必须等到offset提交完毕,再去消费下一批数据。

// consumer.commitAsync(); //异步提交,表示发送完提交offset请求后,就开始消费下一批数据了。不用等到Broker的确认。

}

}

}构建Consumer三个步骤

1. 设置Consumer核心属性 :可选的属性都可以由ConsumerConfig类管理。在这个类中,同样对于大部分比较重要的属性,都配置了对应的DOC属性进行描述。同样BOOTSTRAP_SERVERS_CONFIG是必须设置的属性。

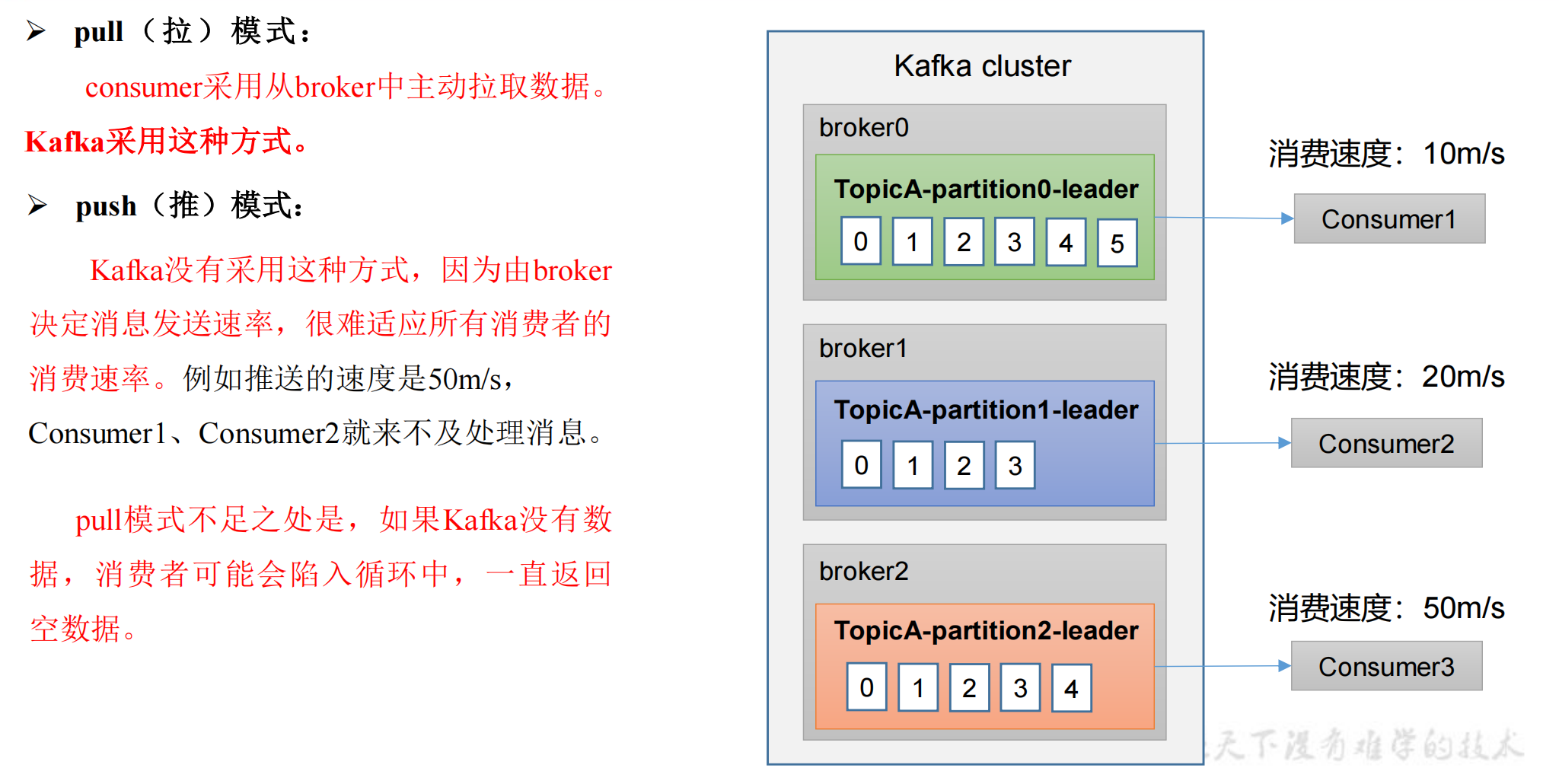

2. 拉取消息:Kafka采用Consumer主动拉取消息的Pull模式。consumer主动从Broker上拉取一批感兴趣的消息。

3. 处理消息,提交位点:消费者将消息拉取完成后,就可以交由业务自行处理对应的这一批消息了。只是消费者需要向Broker提交偏移量offset。如果不提交Offset,Broker会认为消费者端消息处理失败了,还会重复进行推送。

Kafka的客户端基本就是固定的按照这三个大的步骤运行。在使用过程中,最大的变数基本上就是给生产者和消费者的设定合适的属性。

SpringBoot集成Kafka

引入Maven依赖

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka</artifactId>

</dependency>application.properties配置文件

###########【Kafka单机/集群】###########

spring.kafka.bootstrap-servers=127.0.0.1:9092

###########【初始化生产者配置】###########

# 重试次数

spring.kafka.producer.retries=0

# 应答级别:多少个分区副本备份完成时向生产者发送ack确认(可选0、1、all/-1)

spring.kafka.producer.acks=1

# 批量大小

spring.kafka.producer.batch-size=16384

# 提交延时

spring.kafka.producer.properties.linger.ms=0

# 生产端缓冲区大小

spring.kafka.producer.buffer-memory = 33554432

# Kafka提供的序列化和反序列化类

spring.kafka.producer.key-serializer=org.apache.kafka.common.serialization.StringSerializer

spring.kafka.producer.value-serializer=org.apache.kafka.common.serialization.StringSerializer

###########【初始化消费者配置】###########

# 默认的消费组ID

spring.kafka.consumer.properties.group.id=defaultConsumerGroup

# 是否自动提交offset

spring.kafka.consumer.enable-auto-commit=true

# 提交offset延时(接收到消息后多久提交offset)

spring.kafka.consumer.auto.commit.interval.ms=1000

# 当kafka中没有初始offset或offset超出范围时将自动重置offset

# earliest:重置为分区中最小的offset;

# latest:重置为分区中最新的offset(消费分区中新产生的数据);

# none:只要有一个分区不存在已提交的offset,就抛出异常;

spring.kafka.consumer.auto-offset-reset=latest

# 消费会话超时时间(超过这个时间consumer没有发送心跳,就会触发rebalance操作)

spring.kafka.consumer.properties.session.timeout.ms=120000

# 消费请求超时时间

spring.kafka.consumer.properties.request.timeout.ms=180000通过KafkaTemplate发送消息

@RestController

public class KafkaProducer {

@Autowired

private KafkaTemplate<String, Object> kafkaTemplate;

// 发送消息

@GetMapping("/kafka/normal/{message}")

public void sendMessage1(@PathVariable("message") String normalMessage) {

kafkaTemplate.send("topic1", normalMessage);

}

}通过@KafkaListener消费消息

@Component

public class KafkaConsumer {

// 消费监听

@KafkaListener(topics = {"topic1"})

public void onMessage1(ConsumerRecord<?, ?> record){

// 消费的哪个topic、partition的消息,打印出消息内容

System.out.println("简单消费:"+record.topic()+"-"+record.partition()+"-"+record.value());

}

}原文地址:https://blog.csdn.net/m0_61853556/article/details/135975540

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_64605.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!