本文介绍: 最后,在数据消费端,需要确保消费者能够支持“事务性”提交,比如使用支持事务的数据库(如 MySQL)进行数据写入。这样,在发生故障时,Flink 可以回滚未完成的事务,并重新执行已提交的事务,从而保证数据的一致性和准确性。尽管在程序正常运行、资源充足的情况下实现 Exactly-Once 语义并不难,但实际生产环境中存在各种复杂情况和突发状况,因此为了可靠地实现 Exactly-Once,需要以下容错机制。这样,如果程序重启,可以准确地从未被消费的第一条数据开始读取,既不会多读也不会少读。

一步一个脚印,一天一道大数据面试题。

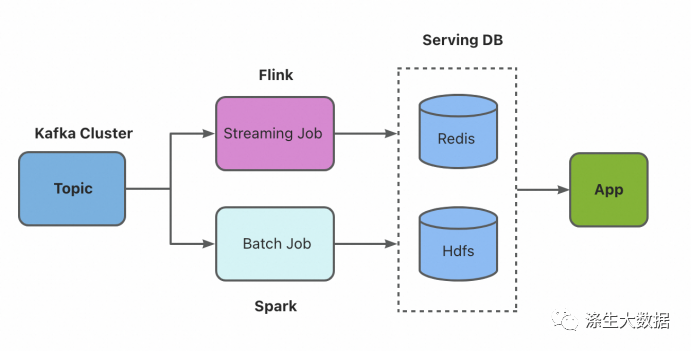

在流式大数据处理框架中,Exactly-Once 语义对于确保每条数据精确地只被消费一次(避免重复读取和丢失读取)非常重要。下面将介绍 Flink 是如何实现 Exactly-Once 语义的。

尽管在程序正常运行、资源充足的情况下实现 Exactly-Once 语义并不难,但实际生产环境中存在各种复杂情况和突发状况,因此为了可靠地实现 Exactly-Once,需要以下容错机制。

数据源(Source)

首先,数据源需要记录“偏移量”,即标记已读取的位置。这样,如果程序重启,可以准确地从未被消费的第一条数据开始读取,既不会多读也不会少读。

Flink 检查点(Checkpoint)

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。