以前想要获取一些网站数据的时候,都是通过人工手动复制粘贴,这样的效率及其低下。数据少无所谓,如果需要采集大量数据,手动就显得乏力了。半夜睡不着,爬起来写一段有关游戏商品数据的爬虫通用模板,希望能帮助大家更快的批量获取数据。

以下是一个简单的示例,展示了如何使用 Scala 和爬虫ip信息来爬取网页:

import java.net.URL

import java.io.BufferedReader

import java.io.InputStreamReader

object WebScraper {

def main(args: Array[String]): Unit = {

val proxyHost = "www.duoip.cn"

val proxyPort = 8000

// 创建 URL 对象

val url = new URL("目标网站")

// 创建 URLConnection 对象,使用爬虫ip信息

val conn = url.openConnection(new URLConnection reveiveProxy(proxyHost, proxyPort))

// 创建 BufferedReader 对象,用于读取网页内容

val in = new BufferedReader(new InputStreamReader(conn.getInputStream()))

// 打印网页内容

var line: String = in.readLine()

while (line != null) {

println(line)

line = in.readLine()

}

// 关闭 BufferedReader 对象

in.close()

}

def reveiveProxy(proxyHost: String, proxyPort: Int): URLConnection = {

val proxy = new URL("http://" + proxyHost + ":" + proxyPort)

val proxyAuth = new java.net.Authenticator() {

override def getPasswordAuthentication(url: java.net.URL, auth: java.net.PasswordAuthentication): java.net.PasswordAuthentication = {

auth

}

}

val conn = new URL("http://example.com").openConnection()

conn.setProxy(new java.net.Proxy(java.net.Proxy.Type.HTTP, proxy))

conn.setProxyAuthenticationHandler(proxyAuth)

conn

}

}

在这个示例中,我们首先创建了一个 URL 对象,然后使用爬虫ip信息创建了一个 URLConnection 对象。然后,我们创建了一个 BufferedReader 对象,用于读取网页内容。最后,我们打印出网页内容并关闭了 BufferedReader 对象。注意,我们使用了一个名为 reveiveProxy 的函数来处理爬虫ip信息,这个函数返回一个 URLConnection 对象,可以用于访问目标网站。请注意,这只是一个基本的示例,实际的爬虫程序可能会更复杂,需要处理更复杂的情况,例如处理网页中的 JavaScript 和 CSS,处理登录和会话,处理错误和异常等。如果您需要帮助编写更复杂的爬虫程序,请查阅相关文档或寻求专业人员的帮助。

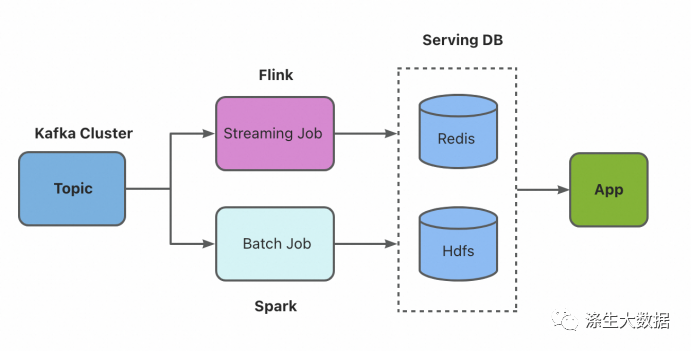

分布式:在实现一个强大的爬虫时,分布式是必不可少的。Scala的杀手级应用Akka可以用于实现分布式爬虫。

反爬手段:规避验证码等反爬手段需要使用爬虫ip池来解决。可以考虑使用第三方库或服务来获取可用的爬虫ip。

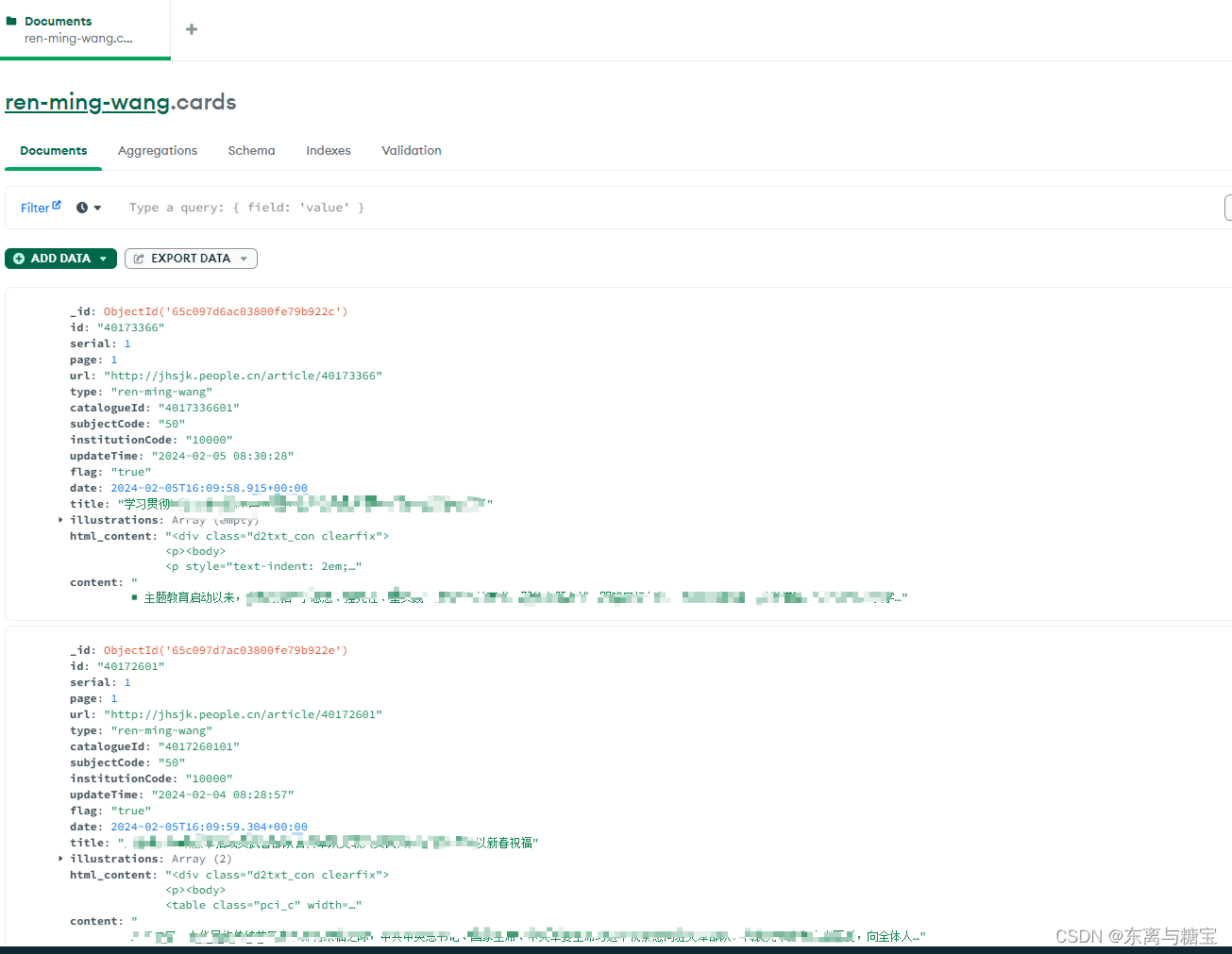

网页解析:Scala有一些强大的库可以用于网页解析,例如Jsoup和Scala Scraper。这些库可以帮助你从网页中提取所需的数据。

并发处理:Scala的并发处理能力非常强大,可以使用Scala的并发库来实现高效的并发爬取。

高效存储:在爬取大规模数据时,需要考虑如何高效地存储数据。可以使用数据库或者分布式存储系统来存储爬取到的数据。

上面的代码示例是通过Scala爬虫代码配合爬虫IP用来批量多线程获取数据的,爬虫程序和爬虫IP是缺一不可的。任何的网站都会有反爬虫机制,用好爬虫IP能事半功倍,如果有更好解决方案可以一起探讨。

原文地址:https://blog.csdn.net/weixin_44617651/article/details/134547326

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。

如若转载,请注明出处:http://www.7code.cn/show_7611.html

如若内容造成侵权/违法违规/事实不符,请联系代码007邮箱:suwngjj01@126.com进行投诉反馈,一经查实,立即删除!