本文介绍: 大家好,我是微学AI,今天给大家介绍一下计算机视觉的应用20-图像生成模型:Stable Diffusion模型的原理详解与相关项目介绍。大家知道现在各个平台发的各种漂亮的女生,这些漂亮的图片是怎么生成的吗,其实它们底层原理就是用到了Stable Diffusion模型。Stable Diffusion是一种基于深度学习的图像生成方法,旨在生成高质量、逼真的图像。该项目利用稳定扩散过程,通过逐渐模糊和清晰化图像来实现图像生成的过程。这种方法在图像生成领域具有广泛的应用,包括艺术创作、虚拟场景生成、数据增强

1−αt).

2.3 网络结构和训练目标

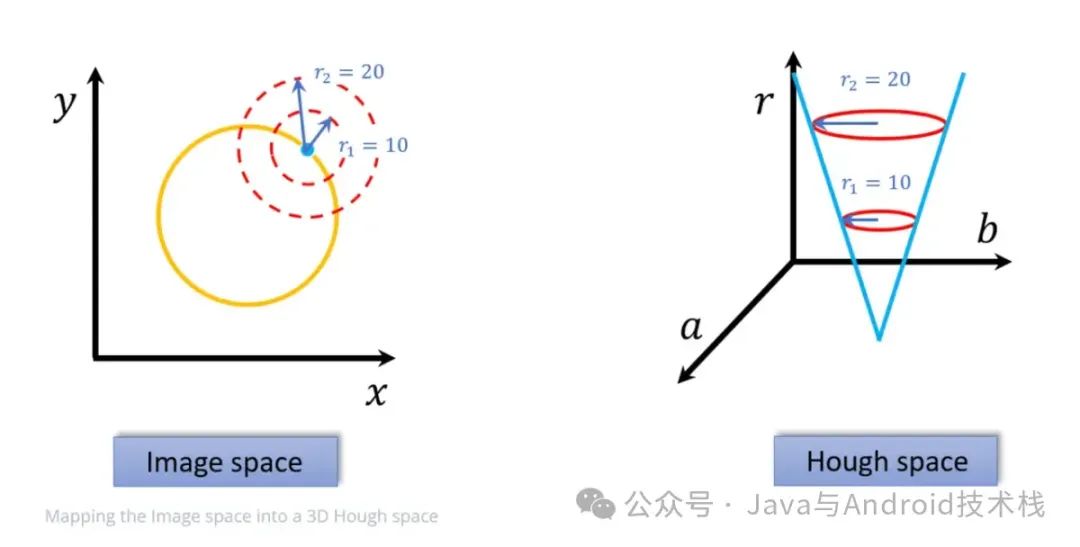

在 Stable Diffusion 中,我们使用一个神经网络

q

θ

(

ϵ

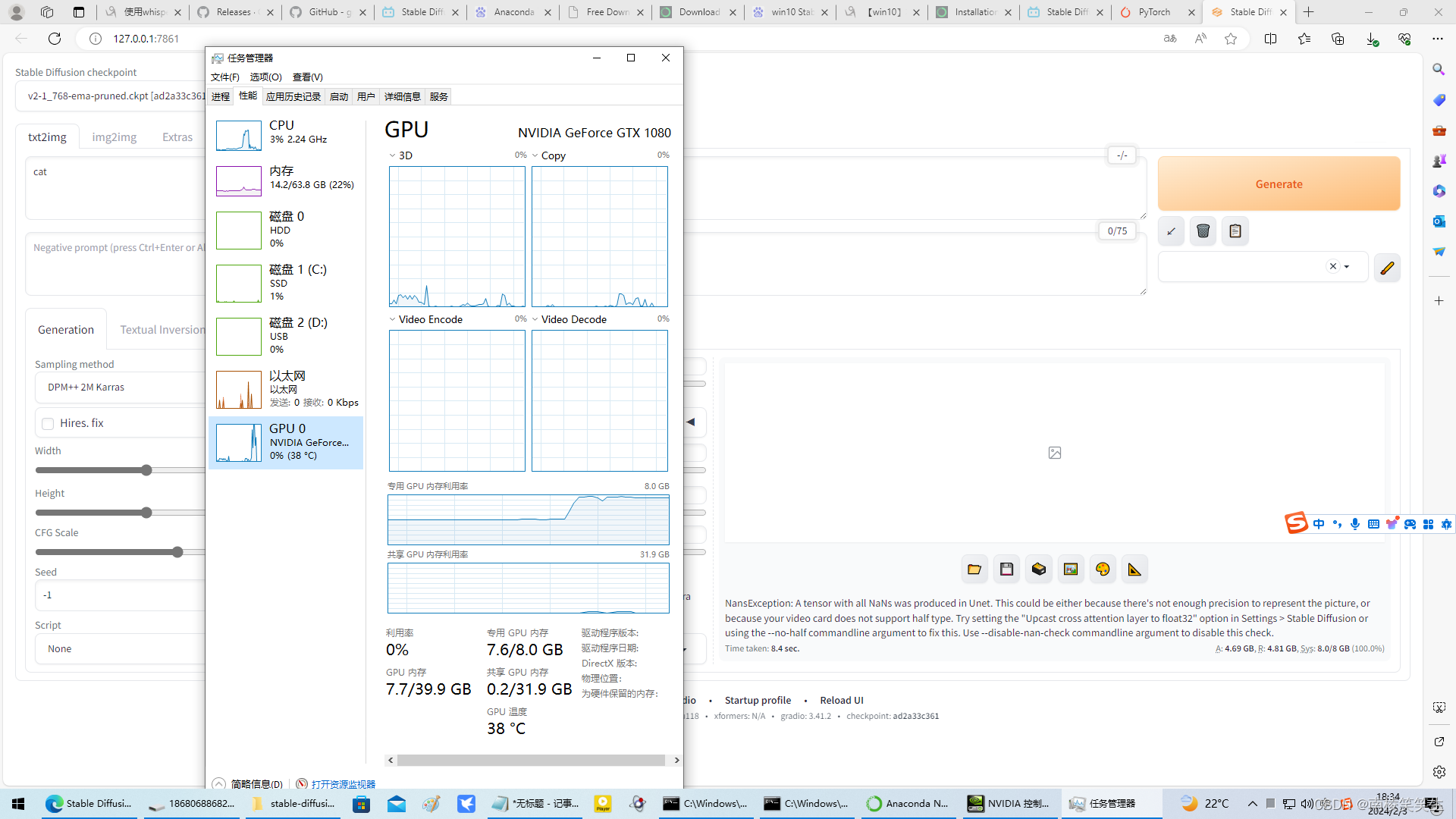

三、代码实现及运行结果

四、总结

声明:本站所有文章,如无特殊说明或标注,均为本站原创发布。任何个人或组织,在未征得本站同意时,禁止复制、盗用、采集、发布本站内容到任何网站、书籍等各类媒体平台。如若本站内容侵犯了原著者的合法权益,可联系我们进行处理。